Language Models are Few-Shot Learners/paper/es

| Research Paper | |

|---|---|

| Authors | Tom B. Brown; Benjamin Mann; Nick Ryder; Melanie Subbiah; Jared Kaplan; Prafulla Dhariwal; Arvind Neelakantan; Pranav Shyam; Girish Sastry; Amanda Askell; Sandhini Agarwal; Ariel Herbert-Voss; Gretchen Krueger; Tom Henighan; Rewon Child; Aditya Ramesh; Daniel M. Ziegler; Jeffrey Wu; Clemens Winter; Christopher Hesse; Mark Chen; Eric Sigler; Mateusz Litwin; Scott Gray; Benjamin Chess; Jack Clark; Christopher Berner; Sam McCandlish; Alec Radford; Ilya Sutskever; Dario Amodei |

| Year | 2020 |

| Topic area | NLP |

| Difficulty | Research |

| arXiv | 2005.14165 |

| Download PDF | |

Language Models are Few-Shot Learners

Tom B. Brown Benjamin Mann11footnotemark: 1 Nick Ryder11footnotemark: 1 Melanie Subbiah11footnotemark: 1 Jared Kaplan Prafulla Dhariwal Arvind Neelakantan Pranav Shyam Girish Sastry Amanda Askell Sandhini Agarwal Ariel Herbert-Voss Gretchen Krueger Tom Henighan Rewon Child Aditya Ramesh Daniel M. Ziegler Jeffrey Wu Clemens Winter Christopher Hesse Mark Chen Eric Sigler Mateusz Litwin Scott Gray Benjamin Chess Jack Clark Christopher Berner Sam McCandlish Alec Radford Ilya Sutskever Dario Amodei

OpenAI Aporte equivalenteJohns Hopkins University, OpenAI

Aportes de los autores listados al final del artículo. (2020)

Resumen

Trabajos recientes han demostrado avances sustanciales en muchas tareas y benchmarks de PLN mediante preentrenamiento en un gran corpus de texto seguido de ajuste fino en una tarea específica. Aunque esta metodología suele ser agnóstica de tarea en cuanto a arquitectura, todavía requiere conjuntos de datos de ajuste fino específicos de la tarea con miles o decenas de miles de ejemplos. Por contraste, los humanos generalmente pueden realizar una nueva tarea lingüística a partir de solo unos pocos ejemplos o instrucciones simples — algo con lo que los sistemas actuales de PLN aún tienen serias dificultades. Aquí mostramos que escalar los modelos de lenguaje mejora enormemente el rendimiento few-shot agnóstico de tarea, llegando a veces incluso a ser competitivo con los métodos previos de ajuste fino de última generación. Específicamente, entrenamos GPT-3, un modelo de lenguaje autorregresivo con 175 mil millones de parámetros, 10 veces más que cualquier modelo de lenguaje no disperso anterior, y evaluamos su rendimiento en el régimen few-shot. Para todas las tareas, GPT-3 se aplica sin actualizaciones de gradiente ni ajuste fino, con las tareas y demostraciones few-shot especificadas puramente mediante interacción de texto con el modelo. GPT-3 alcanza un rendimiento sólido en muchos conjuntos de datos de PLN, incluidos traducción, respuesta a preguntas y tareas de tipo cloze, así como diversas tareas que requieren razonamiento sobre la marcha o adaptación de dominio, como descifrar palabras, usar una palabra novedosa en una oración o efectuar aritmética de tres dígitos. Al mismo tiempo, también identificamos algunos conjuntos de datos donde el aprendizaje few-shot de GPT-3 aún tiene dificultades, así como algunos conjuntos de datos donde GPT-3 enfrenta problemas metodológicos relacionados con el entrenamiento sobre grandes corpus web. Finalmente, encontramos que GPT-3 puede generar muestras de artículos de noticias que los evaluadores humanos tienen dificultad para distinguir de artículos escritos por humanos. Discutimos los impactos sociales más amplios de este hallazgo y de GPT-3 en general.

Índice

- 1 Introducción

- 2 Enfoque

- 3 Resultados

- 4 Medición y prevención de la memorización de benchmarks

- 5 Limitaciones

- 6 Impactos más amplios

- 7 Trabajo relacionado

- 8 Conclusión

- A Detalles del filtrado de Common Crawl

- B Detalles del entrenamiento del modelo

- C Detalles de los estudios de contaminación del conjunto de prueba

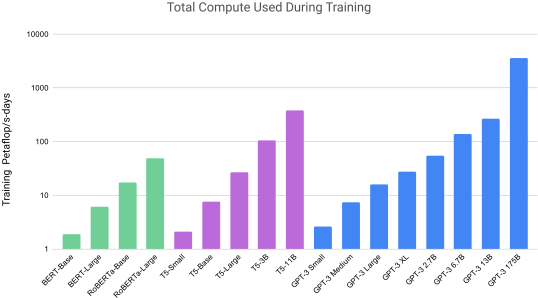

- D Cómputo total empleado para entrenar los modelos de lenguaje

- E Evaluación humana de la calidad de los artículos sintéticos de noticias

- F Muestras adicionales de GPT-3

- G Detalles del enunciado y especificación de las tareas

- H Resultados en todas las tareas para todos los tamaños de modelo

1 Introducción

En los últimos años se ha consolidado una tendencia hacia las representaciones de lenguaje preentrenadas en sistemas de PLN, aplicadas de formas cada vez más flexibles y agnósticas de tarea para la transferencia downstream. Primero se aprendieron representaciones de una sola capa mediante vectores de palabra [82, 102] y se alimentaron a arquitecturas específicas de tarea; después se utilizaron RNN con múltiples capas de representaciones y estado contextual para formar representaciones más fuertes [24, 81, 100] (aunque seguían aplicándose a arquitecturas específicas de tarea); y más recientemente los modelos de lenguaje recurrentes preentrenados o de tipo transformer [134] se han ajustado finamente de manera directa, eliminando por completo la necesidad de arquitecturas específicas de tarea [112, 20, 43].

Este último paradigma ha permitido un progreso sustancial en muchas tareas desafiantes de PLN como comprensión lectora, respuesta a preguntas, implicación textual y muchas otras, y ha continuado avanzando con base en nuevas arquitecturas y algoritmos [116, 74, 139, 62]. Sin embargo, una limitación importante de este enfoque es que, aunque la arquitectura sea agnóstica de tarea, sigue habiendo necesidad de conjuntos de datos específicos de tarea y de ajuste fino específico de tarea: alcanzar un rendimiento sólido en una tarea deseada normalmente requiere ajuste fino sobre un conjunto de datos con miles a cientos de miles de ejemplos específicos de esa tarea. Eliminar esta limitación sería deseable por varias razones.

Primero, desde una perspectiva práctica, la necesidad de un gran conjunto de datos etiquetados para cada nueva tarea limita la aplicabilidad de los modelos de lenguaje. Existe una gama muy amplia de posibles tareas lingüísticas útiles, desde corregir gramática hasta generar ejemplos de un concepto abstracto o criticar un cuento corto. Para muchas de estas tareas resulta difícil reunir un gran conjunto de datos de entrenamiento supervisado, especialmente cuando el proceso debe repetirse para cada nueva tarea.

Segundo, el potencial para explotar correlaciones espurias en los datos de entrenamiento crece fundamentalmente con la expresividad del modelo y la estrechez de la distribución de entrenamiento. Esto puede generar problemas para el paradigma de preentrenamiento más ajuste fino, donde los modelos se diseñan grandes para absorber información durante el preentrenamiento, pero luego se ajustan finamente sobre distribuciones de tarea muy estrechas. Por ejemplo, [41] observa que los modelos más grandes no necesariamente generalizan mejor fuera de la distribución. Hay evidencia que sugiere que la generalización lograda bajo este paradigma puede ser pobre porque el modelo se especializa demasiado en la distribución de entrenamiento y no generaliza bien fuera de ella [138, 88]. Así, el rendimiento de los modelos ajustados finamente en benchmarks específicos, aun cuando nominalmente alcance nivel humano, podría sobreestimar el rendimiento real en la tarea subyacente [36, 91].

Tercero, los humanos no requieren grandes conjuntos de datos supervisados para aprender la mayoría de tareas lingüísticas — una breve indicación en lenguaje natural (p. ej. «por favor, dime si esta oración describe algo alegre o algo triste») o, a lo sumo, un número muy pequeño de demostraciones (p. ej. «aquí tienes dos ejemplos de personas actuando con valentía; por favor, dame un tercer ejemplo de valentía») suele bastar para que un humano realice una nueva tarea con al menos un grado razonable de competencia. Más allá de señalar una limitación conceptual de nuestras técnicas actuales de PLN, esta adaptabilidad ofrece ventajas prácticas: permite a los humanos mezclar o alternar sin esfuerzo entre muchas tareas y habilidades, por ejemplo realizar sumas durante un diálogo prolongado. Para ser ampliamente útiles, algún día querríamos que nuestros sistemas de PLN tuvieran esta misma fluidez y generalidad.

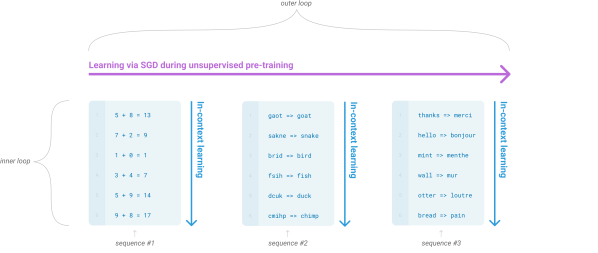

Una posible vía para abordar estos problemas es el meta-aprendizaje111En el contexto de los modelos de lenguaje a esto a veces se le ha llamado «transferencia zero-shot», pero este término es potencialmente ambiguo: el método es «zero-shot» en el sentido de que no se realizan actualizaciones de gradiente, pero a menudo implica proporcionar demostraciones al modelo en tiempo de inferencia, por lo que no está realmente aprendiendo desde cero ejemplos. Para evitar esta confusión, usamos el término «meta-aprendizaje» para capturar la estructura de bucle interno / bucle externo del método general, y el término «aprendizaje en contexto» (in-context learning) para referirnos al bucle interno del meta-aprendizaje. Especializamos además la descripción a «zero-shot», «one-shot» o «few-shot» según cuántas demostraciones se proporcionen en tiempo de inferencia. Estos términos pretenden permanecer agnósticos respecto a la cuestión de si el modelo aprende nuevas tareas desde cero en tiempo de inferencia o simplemente reconoce patrones vistos durante el entrenamiento — un asunto importante que discutimos más adelante en el artículo, pero «meta-aprendizaje» pretende abarcar ambas posibilidades y se limita a describir la estructura de bucle interno-externo. — que en el contexto de los modelos de lenguaje significa que el modelo desarrolla un amplio repertorio de habilidades y capacidades de reconocimiento de patrones durante el entrenamiento, y luego utiliza esas habilidades en tiempo de inferencia para adaptarse rápidamente a la tarea deseada o reconocerla (ilustrado en la Figura 1.1). Trabajos recientes [117] intentan hacer esto mediante lo que llamamos «aprendizaje en contexto» (in-context learning), usando la entrada de texto de un modelo de lenguaje preentrenado como una forma de especificación de tarea: el modelo se condiciona con una instrucción en lenguaje natural y/o unas pocas demostraciones de la tarea, y luego se espera que complete instancias adicionales de la tarea simplemente prediciendo lo que viene a continuación.

Aunque ha mostrado una promesa inicial, este enfoque aún arroja resultados muy inferiores al ajuste fino — por ejemplo, [117] alcanza solo el 4% en Natural Questions, e incluso su resultado de 55 F1 en CoQa queda hoy a más de 35 puntos del estado del arte. El meta-aprendizaje requiere claramente una mejora sustancial para resultar viable como método práctico para resolver tareas lingüísticas.

Otra tendencia reciente en el modelado de lenguaje puede ofrecer una vía a seguir. En los últimos años, la capacidad de los modelos de lenguaje basados en transformer ha crecido sustancialmente, desde 100 millones de parámetros [112], a 300 millones de parámetros [20], a 1.500 millones de parámetros [117], a 8 mil millones de parámetros [125], 11 mil millones de parámetros [116], y finalmente 17 mil millones de parámetros [132]. Cada incremento ha traído mejoras en la síntesis de texto y/o en tareas de PLN downstream, y existe evidencia que sugiere que la log loss, que correlaciona bien con muchas tareas downstream, sigue una tendencia suave de mejora con la escala [57]. Dado que el aprendizaje en contexto implica absorber muchas habilidades y tareas dentro de los parámetros del modelo, es plausible que las capacidades de aprendizaje en contexto muestren ganancias similarmente fuertes con la escala.

En este artículo, ponemos a prueba esta hipótesis entrenando un modelo de lenguaje autorregresivo de 175 mil millones de parámetros, al que llamamos GPT-3, y midiendo sus capacidades de aprendizaje en contexto. Específicamente, evaluamos GPT-3 en más de dos docenas de conjuntos de datos de PLN, así como en varias tareas novedosas diseñadas para evaluar la adaptación rápida a tareas que es poco probable que estén directamente contenidas en el conjunto de entrenamiento. Para cada tarea, evaluamos GPT-3 bajo 3 condiciones: (a) «few-shot learning», o aprendizaje en contexto donde permitimos tantas demostraciones como quepan en la ventana de contexto del modelo (típicamente entre 10 y 100), (b) «one-shot learning», donde permitimos solo una demostración, y (c) aprendizaje «zero-shot», donde no se permiten demostraciones y solo se le da al modelo una instrucción en lenguaje natural. En principio, GPT-3 también podría evaluarse en el régimen tradicional de ajuste fino, pero esto lo dejamos para trabajos futuros.

La Figura 1.2 ilustra las condiciones que estudiamos y muestra el aprendizaje few-shot de una tarea sencilla que requiere que el modelo elimine símbolos extraños de una palabra. El rendimiento del modelo mejora con la adición de una descripción de la tarea en lenguaje natural y con el número de ejemplos en el contexto del modelo, $ {\textstyle K} $. El aprendizaje few-shot también mejora drásticamente con el tamaño del modelo. Aunque los resultados en este caso son particularmente llamativos, las tendencias generales tanto con el tamaño del modelo como con el número de ejemplos en contexto se mantienen para la mayoría de las tareas que estudiamos. Subrayamos que estas curvas de «aprendizaje» no implican actualizaciones de gradiente ni ajuste fino, sino solo un número creciente de demostraciones provistas como condicionamiento.

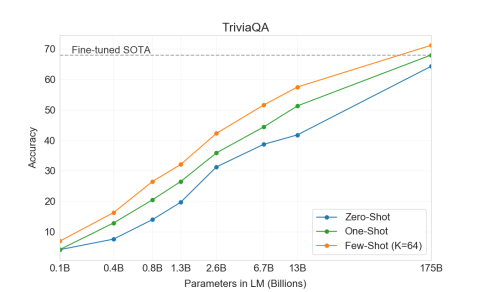

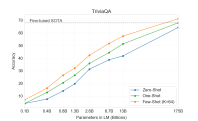

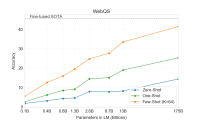

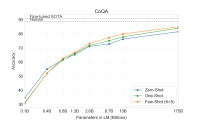

En términos generales, en tareas de PLN GPT-3 obtiene resultados prometedores en los regímenes zero-shot y one-shot, y en el régimen few-shot a veces es competitivo con el estado del arte e incluso lo supera ocasionalmente (a pesar de que el estado del arte está en manos de modelos ajustados finamente). Por ejemplo, GPT-3 alcanza 81,5 F1 en CoQA en el régimen zero-shot, 84,0 F1 en CoQA en el régimen one-shot y 85,0 F1 en el régimen few-shot. De manera similar, GPT-3 alcanza 64,3 % de exactitud en TriviaQA en el régimen zero-shot, 68,0 % en el one-shot y 71,2 % en el few-shot, siendo este último el estado del arte respecto a los modelos ajustados finamente que operan en la misma configuración a libro cerrado.

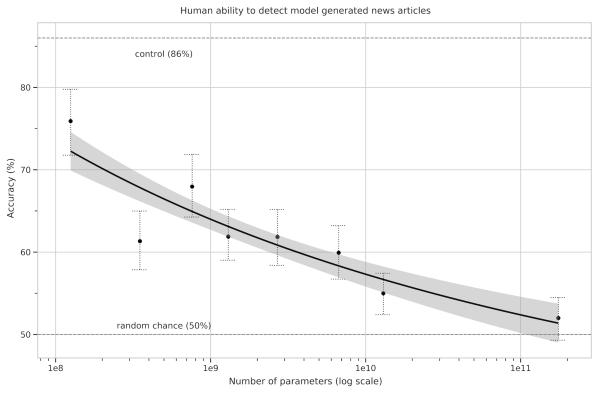

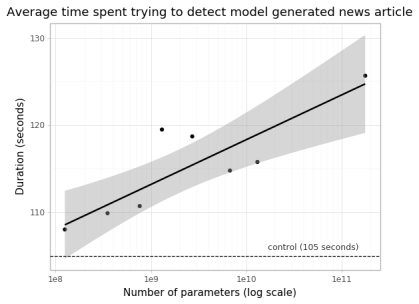

GPT-3 también muestra competencia one-shot y few-shot en tareas diseñadas para evaluar la adaptación rápida o el razonamiento sobre la marcha, lo que incluye descifrar palabras, realizar aritmética y usar palabras novedosas en una oración tras verlas definidas una sola vez. También mostramos que, en el régimen few-shot, GPT-3 puede generar artículos sintéticos de noticias que los evaluadores humanos tienen dificultad para distinguir de artículos generados por humanos.

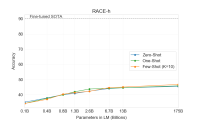

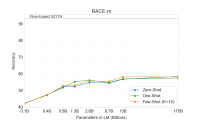

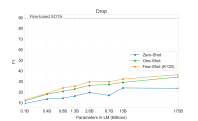

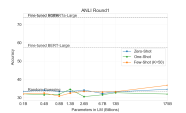

Al mismo tiempo, también encontramos algunas tareas en las que el rendimiento few-shot tiene dificultades, incluso a la escala de GPT-3. Esto incluye tareas de inferencia de lenguaje natural como el conjunto de datos ANLI, y algunos conjuntos de datos de comprensión lectora como RACE o QuAC. Al presentar una caracterización amplia de las fortalezas y debilidades de GPT-3, incluidas estas limitaciones, esperamos estimular el estudio del aprendizaje few-shot en modelos de lenguaje y atraer Lua error: Internal error: The interpreter exited with status 1. hacia los puntos donde el progreso es más necesario.

Una visión heurística de los resultados generales puede verse en la Figura 1.3, que agrega las distintas tareas (aunque no debe considerarse en sí misma como un benchmark riguroso o significativo).

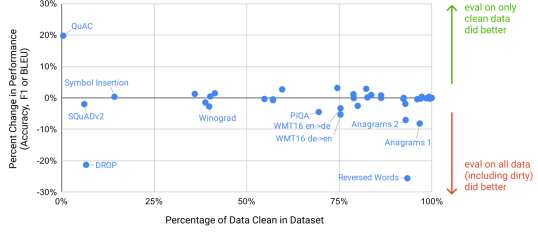

También emprendemos un estudio sistemático de la «contaminación de datos», un problema creciente al entrenar modelos de alta capacidad sobre conjuntos de datos como Common Crawl, los cuales pueden incluir potencialmente contenido proveniente de conjuntos de prueba simplemente porque dicho contenido suele existir en la web. En este artículo desarrollamos herramientas sistemáticas para medir la contaminación de datos y cuantificar sus efectos distorsionantes. Aunque encontramos que la contaminación de datos tiene un efecto mínimo sobre el rendimiento de GPT-3 en la mayoría de los conjuntos de datos, sí identificamos algunos conjuntos en los que podría estar inflando los resultados, y o bien no informamos resultados sobre estos conjuntos o los marcamos con un asterisco, según la gravedad.

Además de todo lo anterior, también entrenamos una serie de modelos más pequeños (con tamaños desde 125 millones de parámetros hasta 13 mil millones de parámetros) para comparar su rendimiento con el de GPT-3 en los regímenes zero-, one- y few-shot. En términos generales, para la mayoría de las tareas encontramos un escalado relativamente suave con la capacidad del modelo en los tres regímenes; un patrón notable es que la brecha entre el rendimiento zero-, one- y few-shot a menudo crece con la capacidad del modelo, lo que quizás sugiera que los modelos más grandes son meta-aprendices más competentes.

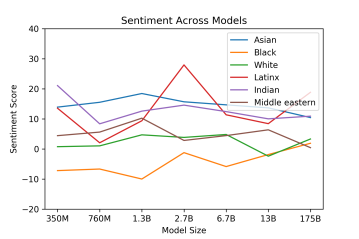

Por último, dado el amplio espectro de capacidades exhibido por GPT-3, discutimos preocupaciones sobre sesgo, equidad e impactos sociales más amplios, e intentamos un análisis preliminar de las características de GPT-3 a este respecto.

El resto del artículo se organiza de la siguiente manera. En la Sección 2 describimos nuestro enfoque y los métodos para entrenar GPT-3 y evaluarlo. La Sección 3 presenta resultados sobre toda la gama de tareas en los regímenes zero-, one- y few-shot. La Sección 4.1 aborda cuestiones de contaminación de datos (solapamiento entre entrenamiento y prueba). La Sección 5 discute las limitaciones de GPT-3. La Sección 6 discute los impactos más amplios. La Sección 7 revisa el trabajo relacionado y la Sección 8 concluye.

2 Enfoque

Nuestro enfoque básico de Lua error: Internal error: The interpreter exited with status 1., incluidos modelo, datos y entrenamiento, es similar al proceso descrito en [117], con un escalado relativamente directo del tamaño del modelo, del tamaño y diversidad del conjunto de datos y de la duración del entrenamiento. Nuestro uso del aprendizaje en contexto también es similar a [117], pero en este trabajo exploramos sistemáticamente diferentes configuraciones para el aprendizaje dentro del contexto. Por lo tanto, comenzamos esta sección definiendo y contrastando explícitamente las distintas configuraciones bajo las cuales evaluaremos GPT-3 o las que en principio podríamos evaluar. Estas configuraciones pueden verse como ubicadas en un espectro según cuánto dato específico de tarea tienden a requerir. En concreto, podemos identificar al menos cuatro puntos en este espectro (véase la Figura 2.1 para una ilustración):

•

Fine-Tuning (FT) ha sido el enfoque más común en los últimos años, y consiste en actualizar los pesos de un modelo preentrenado entrenándolo sobre un conjunto de datos supervisado específico de la tarea deseada. Típicamente se usan miles a cientos de miles de ejemplos etiquetados. La principal ventaja del Lua error: Internal error: The interpreter exited with status 1. es un rendimiento sólido en muchos benchmarks. Las principales desventajas son la necesidad de un nuevo conjunto de datos grande para cada tarea, el potencial de mala generalización fuera de distribución [88] y el potencial de explotar características espurias de los datos de entrenamiento [36, 91], lo que podría resultar en una comparación injusta con el rendimiento humano. En este trabajo no hacemos Lua error: Internal error: The interpreter exited with status 1. sobre GPT-3 porque nos enfocamos en el rendimiento agnóstico de tarea, pero GPT-3 puede en principio ser ajustado finamente y esta es una dirección prometedora para trabajos futuros.

•

Few-Shot (FS) es el término que usaremos en este trabajo para referirnos al régimen en el que al modelo se le dan unas pocas demostraciones de la tarea en tiempo de inferencia como condicionamiento [117], pero no se permiten actualizaciones de pesos. Como se muestra en la Figura 2.1, para un conjunto de datos típico un ejemplo tiene un contexto y una compleción deseada (por ejemplo, una oración en inglés y la traducción al francés), y el few-shot funciona dando $ {\textstyle K} $ ejemplos de contexto y compleción, y luego un ejemplo final de solo contexto, esperándose que el modelo proporcione la compleción. Normalmente fijamos $ {\textstyle K} $ en el rango de 10 a 100, ya que es la cantidad de ejemplos que caben en la ventana de contexto del modelo ($ {\textstyle n_{ctx} = 2048} $). Las principales ventajas del few-shot son una gran reducción de la necesidad de datos específicos de tarea y una menor probabilidad de aprender una distribución demasiado estrecha a partir de un conjunto de Lua error: Internal error: The interpreter exited with status 1. grande pero estrecho. La principal desventaja es que los resultados de este método han sido hasta ahora muy inferiores a los de los modelos ajustados finamente de última generación. Además, todavía se requiere una pequeña cantidad de datos específicos de tarea. Como su nombre indica, el aprendizaje few-shot tal como aquí se describe para modelos de lenguaje está relacionado con el aprendizaje few-shot tal como se utiliza en otros contextos de ML [45, 133] — ambos implican aprender con base en una distribución amplia de tareas (en este caso implícita en los datos de Lua error: Internal error: The interpreter exited with status 1.) y luego adaptarse rápidamente a una nueva tarea.

•

One-Shot (1S) es lo mismo que few-shot salvo que solo se permite una demostración, además de una descripción en lenguaje natural de la tarea, como se muestra en la Figura 1. La razón para distinguir one-shot de few-shot y zero-shot (más abajo) es que coincide más estrechamente con la forma en que algunas tareas se comunican a humanos. Por ejemplo, al pedir a humanos que generen un conjunto de datos en un servicio de trabajadores humanos (por ejemplo Mechanical Turk), es habitual dar una demostración de la tarea. En contraste, a veces es difícil comunicar el contenido o el formato de una tarea si no se dan ejemplos.

•

Zero-Shot (0S) es lo mismo que one-shot, salvo que no se permiten demostraciones y al modelo solo se le da una instrucción en lenguaje natural que describe la tarea. Este método ofrece máxima conveniencia, potencial de robustez y evita correlaciones espurias (a menos que ocurran de manera muy generalizada en el gran corpus de datos de Lua error: Internal error: The interpreter exited with status 1.), pero también es el régimen más desafiante. En algunos casos puede incluso ser difícil para los humanos entender el formato de la tarea sin ejemplos previos, por lo que este régimen es en algunos casos «injustamente difícil». Por ejemplo, si se le pide a alguien que «haga una tabla de récords mundiales para los 200 m planos», la solicitud puede ser ambigua, ya que no necesariamente queda claro qué formato debe tener la tabla o qué debe incluir (e incluso con una aclaración cuidadosa, comprender con precisión lo que se desea puede ser difícil). No obstante, al menos en algunas configuraciones, zero-shot es lo más cercano a cómo los humanos realizan tareas — por ejemplo, en el ejemplo de traducción de la Figura 2.1, un humano probablemente sabría qué hacer solo con la instrucción en texto.

La Figura 2.1 muestra los cuatro métodos usando el ejemplo de traducción de inglés a francés. En este artículo nos centramos en zero-shot, one-shot y few-shot, con el objetivo de compararlos no como alternativas en competencia, sino como diferentes regímenes de problema que ofrecen un compromiso variable entre el rendimiento en benchmarks específicos y la eficiencia muestral. En particular destacamos los resultados few-shot, ya que muchos están solo ligeramente por detrás de los modelos ajustados finamente de última generación. En última instancia, sin embargo, one-shot, o incluso a veces zero-shot, parecen ser las comparaciones más justas con el rendimiento humano y son objetivos importantes para trabajos futuros.

Las Secciones 2.1-2.3 a continuación detallan, respectivamente, nuestros modelos, los datos de entrenamiento y el proceso de entrenamiento. La Sección 2.4 discute los detalles de cómo realizamos las evaluaciones few-shot, one-shot y zero-shot.

2.1 Modelo y Arquitecturas

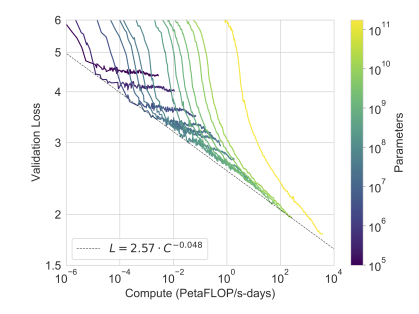

Usamos el mismo modelo y arquitectura que GPT-2 [117], incluyendo la inicialización modificada, la pre-normalización y la Lua error: Internal error: The interpreter exited with status 1. reversible descritas allí, con la excepción de que utilizamos patrones de Lua error: Internal error: The interpreter exited with status 1. alternantes densos y dispersos en bandas locales en las capas del Lua error: Internal error: The interpreter exited with status 1., similar al Sparse Lua error: Internal error: The interpreter exited with status 1. [15]. Para estudiar la dependencia del rendimiento de ML respecto al tamaño del modelo, entrenamos 8 tamaños diferentes de modelo, abarcando tres órdenes de magnitud desde 125 millones de parámetros hasta 175 mil millones de parámetros, siendo el último el modelo que llamamos GPT-3. Trabajos previos [57] sugieren que con suficientes datos de entrenamiento, el escalado de la pérdida de validación debería ser aproximadamente una ley de potencia suave en función del tamaño; entrenar modelos de muchos tamaños distintos nos permite contrastar esta hipótesis tanto para la pérdida de validación como para tareas de lenguaje downstream.

| Nombre del Modelo | $ {\textstyle n_{params}} $ | $ {\textstyle n_{layers}} $ | $ {\textstyle d_{model}} $ | $ {\textstyle n_{heads}} $ | $ {\textstyle d_{head}} $ | Tamaño de Lote | Tasa de Aprendizaje |

|---|---|---|---|---|---|---|---|

| GPT-3 Small | 125M | 12 | 768 | 12 | 64 | 0.5M | $ {\textstyle 6.0 \times 10^{- 4}} $ |

| GPT-3 Medium | 350M | 24 | 1024 | 16 | 64 | 0.5M | $ {\textstyle 3.0 \times 10^{- 4}} $ |

| GPT-3 Large | 760M | 24 | 1536 | 16 | 96 | 0.5M | $ {\textstyle 2.5 \times 10^{- 4}} $ |

| GPT-3 XL | 1.3B | 24 | 2048 | 24 | 128 | 1M | $ {\textstyle 2.0 \times 10^{- 4}} $ |

| GPT-3 2.7B | 2.7B | 32 | 2560 | 32 | 80 | 1M | $ {\textstyle 1.6 \times 10^{- 4}} $ |

| GPT-3 6.7B | 6.7B | 32 | 4096 | 32 | 128 | 2M | $ {\textstyle 1.2 \times 10^{- 4}} $ |

| GPT-3 13B | 13.0B | 40 | 5140 | 40 | 128 | 2M | $ {\textstyle 1.0 \times 10^{- 4}} $ |

| GPT-3 175B or “GPT-3” | 175.0B | 96 | 12288 | 96 | 128 | 3.2M | $ {\textstyle 0.6 \times 10^{- 4}} $ |

La Tabla 2.1 muestra los tamaños y arquitecturas de nuestros 8 modelos. Aquí $ {\textstyle n_{params}} $ es el número total de parámetros entrenables, $ {\textstyle n_{layers}} $ es el número total de capas, $ {\textstyle d_{model}} $ es el número de unidades en cada capa de cuello de botella (siempre tenemos la capa feedforward cuatro veces más grande que la capa de cuello de botella, $ {\textstyle d_{ff}} $ $ {\textstyle = {4 \ast d_{model}}} $), y $ {\textstyle d_{head}} $ es la dimensión de cada cabeza de Lua error: Internal error: The interpreter exited with status 1.. Todos los modelos usan una ventana de contexto de $ {\textstyle n_{ctx} = 2048} $ tokens. Particionamos el modelo a través de las GPU tanto en la dimensión de profundidad como en la de anchura para minimizar la transferencia de datos entre nodos. Los parámetros arquitectónicos precisos para cada modelo se eligen con base en la eficiencia computacional y el balance de carga en la disposición de los modelos a través de las GPU. Trabajos previos [57] sugieren que la pérdida de validación no es muy sensible a estos parámetros dentro de un rango razonablemente amplio.

2.2 Conjunto de Datos de Entrenamiento

Los conjuntos de datos para modelos de lenguaje se han expandido rápidamente, culminando en el conjunto de datos Common Crawl222https://commoncrawl.org/the-data/ [116], que constituye casi un billón de palabras. Este tamaño de conjunto de datos es suficiente para entrenar nuestros modelos más grandes sin actualizar nunca dos veces sobre la misma secuencia. Sin embargo, hemos encontrado que las versiones sin filtrar o ligeramente filtradas de Common Crawl tienden a tener menor calidad que conjuntos de datos más curados. Por ello, tomamos 3 pasos para mejorar la calidad media de nuestros conjuntos de datos: (1) descargamos y filtramos una versión de CommonCrawl con base en la similitud con una serie de corpus de referencia de alta calidad, (2) realizamos deduplicación difusa a nivel de documento, dentro y entre conjuntos de datos, para evitar la redundancia y preservar la integridad de nuestro conjunto de validación reservado como medida precisa del Lua error: Internal error: The interpreter exited with status 1., y (3) también añadimos corpus de referencia conocidos de alta calidad a la mezcla de entrenamiento para complementar CommonCrawl y aumentar su diversidad.

Los detalles de los dos primeros puntos (procesamiento de Common Crawl) se describen en el Apéndice A. Para el tercero, añadimos varios conjuntos de datos curados de alta calidad, incluyendo una versión expandida del conjunto de datos WebText [117], recopilada raspando enlaces durante un período de tiempo más largo y descrita por primera vez en [57], dos corpus de libros basados en internet (Books1 y Books2) y la Wikipedia en inglés.

La Tabla 2.2 muestra la mezcla final de conjuntos de datos que usamos en el entrenamiento. Los datos de CommonCrawl se descargaron de 41 shards de CommonCrawl mensual cubriendo de 2016 a 2019, constituyendo 45TB de texto plano comprimido antes del filtrado y 570GB después del filtrado, aproximadamente equivalente a 400 mil millones de tokens codificados con byte-pair-encoding. Nótese que durante el entrenamiento los conjuntos de datos no se muestrean en proporción a su tamaño, sino que los conjuntos que consideramos de mayor calidad se muestrean con más frecuencia, de forma que CommonCrawl y Books2 se muestrean menos de una vez durante el entrenamiento, mientras que los demás se muestrean de 2 a 3 veces. Esto en esencia acepta una pequeña cantidad de Lua error: Internal error: The interpreter exited with status 1. a cambio de datos de entrenamiento de mayor calidad.

| Conjunto de Datos | Cantidad (tokens) | Peso en la mezcla de entrenamiento | Lua error: Internal error: The interpreter exited with status 1. elapsed when training for 300B tokens |

|---|---|---|---|

| Common Crawl (filtered) | 410 billion | 60% | 0.44 |

| WebText2 | 19 billion | 22% | 2.9 |

| Books1 | 12 billion | 8% | 1.9 |

| Books2 | 55 billion | 8% | 0.43 |

| Wikipedia | 3 billion | 3% | 3.4 |

Una preocupación metodológica importante con los modelos de lenguaje preentrenados sobre una amplia franja de datos de internet, particularmente los modelos grandes con la capacidad de memorizar grandes cantidades de contenido, es la posible contaminación de las tareas downstream al haber visto inadvertidamente sus conjuntos de prueba o desarrollo durante el Lua error: Internal error: The interpreter exited with status 1.. Para reducir tal contaminación, buscamos e intentamos eliminar cualquier solapamiento con los conjuntos de desarrollo y prueba de todos los benchmarks estudiados en este artículo. Desafortunadamente, un error en el filtrado nos llevó a ignorar algunos solapamientos, y debido al coste del entrenamiento no fue factible reentrenar el modelo. En la Sección 4.1 caracterizamos el impacto de los solapamientos restantes, y en trabajos futuros eliminaremos la contaminación de datos de manera más agresiva.

2.3 Proceso de Entrenamiento

Como se encontró en [57, 85], los modelos más grandes pueden típicamente usar un batch size mayor, pero requieren una Lua error: Internal error: The interpreter exited with status 1. menor. Medimos la escala de ruido del gradiente durante el entrenamiento y la usamos para guiar nuestra elección del batch size [85]. La Tabla 2.1 muestra la configuración de parámetros que usamos. Para entrenar los modelos más grandes sin quedarnos sin memoria, usamos una mezcla de paralelismo de modelo dentro de cada multiplicación de matrices y paralelismo de modelo a través de las capas de la red. Todos los modelos se entrenaron en GPU V100, en parte de un clúster de alto ancho de banda proporcionado por Microsoft. Los detalles del proceso de entrenamiento y los ajustes de Lua error: Internal error: The interpreter exited with status 1. se describen en el Apéndice B.

2.4 Evaluación

Para el aprendizaje few-shot, evaluamos cada ejemplo del conjunto de evaluación tomando aleatoriamente $ {\textstyle K} $ ejemplos del conjunto de entrenamiento de esa tarea como condicionamiento, delimitados por 1 o 2 saltos de línea según la tarea. Para LAMBADA y Storycloze no hay un conjunto de entrenamiento supervisado disponible, por lo que tomamos los ejemplos de condicionamiento del conjunto de desarrollo y evaluamos en el conjunto de prueba. Para Winograd (la versión original, no la de SuperGLUE) solo hay un conjunto, así que tomamos los ejemplos de condicionamiento directamente de él.

$ {\textstyle K} $ puede tomar cualquier valor desde 0 hasta el máximo permitido por la ventana de contexto del modelo, que es $ {\textstyle n_{ctx} = 2048} $ para todos los modelos y suele caber entre $ {\textstyle 10} $ y $ {\textstyle 100} $ ejemplos. Valores mayores de $ {\textstyle K} $ son normalmente, pero no siempre, mejores, así que cuando hay disponibles conjuntos de desarrollo y prueba separados, experimentamos con varios valores de $ {\textstyle K} $ en el conjunto de desarrollo y luego ejecutamos el mejor valor en el conjunto de prueba. Para algunas tareas (véase el Apéndice G) también usamos un prompt en lenguaje natural además de (o, para $ {\textstyle K = 0} $, en lugar de) las demostraciones.

En tareas que implican elegir una compleción correcta entre varias opciones (selección múltiple), proporcionamos $ {\textstyle K} $ ejemplos de contexto más compleción correcta, seguidos de un ejemplo de solo contexto, y comparamos la verosimilitud del LM para cada compleción. Para la mayoría de las tareas comparamos la verosimilitud por token (para normalizar por longitud); sin embargo, en un pequeño número de conjuntos de datos (ARC, OpenBookQA y RACE) obtenemos un beneficio adicional medido en el conjunto de desarrollo al normalizar por la probabilidad incondicional de cada compleción, calculando $ {\textstyle \frac{P\hspace{0pt}{(\left. {completion} \middle| {context} \right.)}}{P\hspace{0pt}{(\left. {completion} \middle| {{answer}\hspace{0pt}\_\hspace{0pt}{context}} \right.)}}} $, donde $ {\textstyle {answer}\hspace{0pt}\_\hspace{0pt}{context}} $ es la cadena "Answer: " o "A: " y se usa para indicar que la compleción debe ser una respuesta, pero por lo demás es genérica.

En tareas que implican clasificación binaria, damos a las opciones nombres más significativos semánticamente (p. ej. «True» o «False» en lugar de 0 o 1) y luego tratamos la tarea como selección múltiple; a veces también enmarcamos la tarea de manera similar a lo hecho por [116] (véase el Apéndice G para detalles).

En tareas con compleción de forma libre, usamos beam search con los mismos parámetros que [116]: un ancho de haz de 4 y una penalización de longitud de $ {\textstyle \alpha = 0.6} $. Calificamos el modelo usando la puntuación de similitud F1, BLEU o coincidencia exacta, según lo que sea estándar para el conjunto de datos en cuestión.

Los resultados finales se reportan en el conjunto de prueba cuando está disponible públicamente, para cada tamaño de modelo y régimen de aprendizaje (zero-, one- y few-shot). Cuando el conjunto de prueba es privado, nuestro modelo a menudo es demasiado grande para caber en el servidor de prueba, así que reportamos resultados en el conjunto de desarrollo. Sí enviamos al servidor de prueba en un pequeño número de conjuntos de datos (SuperGLUE, TriviaQA, PiQa) en los que pudimos hacer que la presentación funcionara, y enviamos solo los resultados few-shot del modelo de 200B, reportando resultados de conjunto de desarrollo para todo lo demás.

3 Resultados

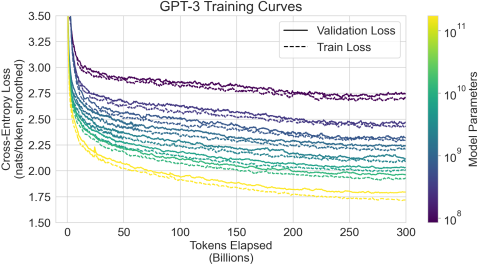

En la Figura 3.1 mostramos las curvas de entrenamiento para los 8 modelos descritos en la Sección 2. Para este gráfico también incluimos 6 modelos extra-pequeños adicionales con tan solo 100.000 parámetros. Como se observa en [57], el rendimiento del modelado de lenguaje sigue una ley de potencia cuando se hace un uso eficiente del cómputo de entrenamiento. Tras extender esta tendencia dos órdenes de magnitud más, observamos solo una ligera (si la hay) desviación de la ley de potencia. Uno podría preocuparse de que estas mejoras en Lua error: Internal error: The interpreter exited with status 1. provengan únicamente de modelar detalles espurios de nuestro corpus de entrenamiento. Sin embargo, en las secciones siguientes veremos que las mejoras en Lua error: Internal error: The interpreter exited with status 1. conducen a ganancias de rendimiento consistentes en un amplio espectro de tareas de lenguaje natural.

A continuación, evaluamos los 8 modelos descritos en la Sección 2 (el GPT-3 de 175 mil millones de parámetros y 7 modelos más pequeños) en una amplia gama de conjuntos de datos. Agrupamos los conjuntos de datos en 9 categorías que representan tareas aproximadamente similares.

En la Sección 3.1 evaluamos en tareas tradicionales de modelado de lenguaje y tareas similares al modelado de lenguaje, como tareas Cloze y tareas de compleción de oraciones/párrafos. En la Sección 3.2 evaluamos en tareas de respuesta a preguntas «a libro cerrado»: tareas que requieren usar la información almacenada en los parámetros del modelo para responder preguntas de conocimiento general. En la Sección 3.3 evaluamos la capacidad del modelo para traducir entre idiomas (especialmente one-shot y few-shot). En la Sección 3.4 evaluamos el rendimiento del modelo en tareas tipo Winograd Schema. En la Sección 3.5 evaluamos en conjuntos de datos que implican razonamiento de sentido común o respuesta a preguntas. En la Sección 3.6 evaluamos en tareas de comprensión lectora, en la Sección 3.7 evaluamos en el conjunto de benchmarks SuperGLUE, y en 3.8 exploramos brevemente NLI. Por último, en la Sección 3.9, inventamos algunas tareas adicionales diseñadas especialmente para sondear las capacidades de aprendizaje en contexto — estas tareas se centran en el razonamiento sobre la marcha, las habilidades de adaptación o la síntesis de texto abierta. Evaluamos todas las tareas en los regímenes few-shot, one-shot y zero-shot.

3.1 Modelado de Lenguaje, Cloze y Tareas de Completado

En esta sección probamos el rendimiento de GPT-3 en la tarea tradicional de modelado de lenguaje, así como en tareas relacionadas que implican predecir una palabra de interés, completar una oración o un párrafo, o elegir entre posibles compleciones de un fragmento de texto.

3.1.1 Modelado de Lenguaje

Calculamos la perplejidad zero-shot en el conjunto de datos Penn Tree Bank (PTB) [86] medido en [117]. Omitimos las 4 tareas relacionadas con Wikipedia de ese trabajo porque están enteramente contenidas en nuestros datos de entrenamiento, y también omitimos el benchmark one-billion word debido a que una alta fracción del conjunto de datos está contenida en nuestro conjunto de entrenamiento. PTB escapa de estos problemas por ser anterior a la internet moderna. Nuestro modelo más grande establece un nuevo SOTA en PTB por un margen sustancial de 15 puntos, alcanzando una perplejidad de 20,50. Nótese que, dado que PTB es un conjunto de datos tradicional de modelado de lenguaje, no tiene una separación clara de ejemplos en torno a la cual definir evaluación one-shot o few-shot, por lo que medimos solo zero-shot.

| Configuración | PTB |

|---|---|

| SOTA (Zero-Shot) | 35.8a |

| GPT-3 Zero-Shot | 20.5 |

3.1.2 LAMBADA

| Configuración | LAMBADA (acc) | LAMBADA (ppl) | StoryCloze (acc) | HellaSwag (acc) |

|---|---|---|---|---|

| SOTA | 68.0a | 8.63b | 91.8c | 85.6d |

| GPT-3 Zero-Shot | 76.2 | 3.00 | 83.2 | 78.9 |

| GPT-3 One-Shot | 72.5 | 3.35 | 84.7 | 78.1 |

| GPT-3 Few-Shot | 86.4 | 1.92 | 87.7 | 79.3 |

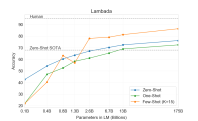

El conjunto de datos LAMBADA [99] evalúa el modelado de dependencias de largo alcance en el texto: se le pide al modelo predecir la última palabra de oraciones que requieren leer un párrafo de contexto. Recientemente se ha sugerido que el escalado continuo de los modelos de lenguaje está produciendo retornos decrecientes en este difícil benchmark. [9] reflexionan sobre la mejora del 1,5 % obtenida al duplicar el tamaño del modelo entre dos resultados recientes del estado del arte ([125] y [132]) y argumentan que «seguir expandiendo el hardware y los tamaños de datos en órdenes de magnitud no es el camino a seguir». Nosotros encontramos que ese camino sigue siendo prometedor y, en un régimen zero-shot, GPT-3 alcanza 76 % en LAMBADA, una ganancia del 8 % sobre el estado del arte previo.

LAMBADA es también una demostración de la flexibilidad del aprendizaje few-shot, ya que ofrece una manera de abordar un problema que clásicamente ocurre con este conjunto de datos. Aunque la compleción en LAMBADA es siempre la última palabra de una oración, un modelo de lenguaje estándar no tiene forma de saber este detalle. Por ello asigna probabilidad no solo al final correcto sino también a otras continuaciones válidas del párrafo. Este problema se ha abordado en parte en el pasado con filtros de palabras de paro [117] (que vetan palabras de «continuación»). El régimen few-shot, en cambio, nos permite «encuadrar» la tarea como un test cloze y permite que el modelo de lenguaje infiera a partir de los ejemplos que se desea una compleción de exactamente una palabra. Usamos el siguiente formato fill-in-the-blank:

Alice era amiga de Bob. Alice fue a visitar a su amigo . $ {\textstyle \rightarrow} $ Bob

George compró algo de equipamiento de béisbol, una pelota, un guante y un . $ {\textstyle \rightarrow} $

Cuando se presentan ejemplos formateados de esta manera, GPT-3 alcanza un 86,4 % de exactitud en el régimen few-shot, un aumento de más del 18 % respecto al estado del arte previo. Observamos que el rendimiento few-shot mejora notablemente con el tamaño del modelo. Mientras que este régimen disminuye el rendimiento del modelo más pequeño en casi un 20 %, para GPT-3 mejora la exactitud en un 10 %. Por último, el método fill-in-blank no es efectivo en one-shot, donde siempre rinde peor que el régimen zero-shot. Quizá esto se deba a que todos los modelos aún requieren varios ejemplos para reconocer el patrón.

Una nota de cautela es que un análisis de contaminación del conjunto de prueba identificó que una minoría significativa del conjunto de datos LAMBADA parece estar presente en nuestros datos de entrenamiento; sin embargo, el análisis realizado en la Sección 4.1 sugiere un impacto insignificante en el rendimiento.

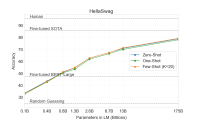

3.1.3 HellaSwag

El conjunto de datos HellaSwag [140] consiste en escoger el mejor final para una historia o un conjunto de instrucciones. Los ejemplos se extrajeron de manera adversarial para que sean difíciles para los modelos de lenguaje y a la vez fáciles para los humanos (que alcanzan un 95,6 % de exactitud). GPT-3 alcanza un 78,1 % de exactitud en el régimen one-shot y un 79,3 % en el régimen few-shot, superando el 75,4 % de exactitud de un modelo de lenguaje ajustado finamente con 1,5 mil millones de parámetros [141], pero todavía bastante por debajo del SOTA general del 85,6 % alcanzado por el modelo multitarea ajustado finamente ALUM.

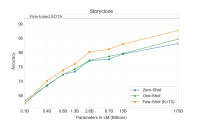

3.1.4 StoryCloze

A continuación evaluamos GPT-3 en el conjunto de datos StoryCloze 2016 [83], que consiste en seleccionar la oración final correcta para historias de cinco oraciones. Aquí GPT-3 alcanza un 83,2 % en el régimen zero-shot y un 87,7 % en el régimen few-shot (con $ {\textstyle K = 70} $). Esto sigue siendo 4,1 % menos que el SOTA ajustado finamente que utiliza un modelo basado en BERT [64], pero mejora los resultados zero-shot anteriores en aproximadamente un 10 %.

3.2 Respuesta a Preguntas de Libro Cerrado

| Configuración | NaturalQS | WebQS | TriviaQA |

|---|---|---|---|

| RAG (Fine-tuned, Open-Domain) [75] | 44.5 | 45.5 | 68.0 |

| T5-11B+SSM (Fine-tuned, Closed-Book) [115] | 36.6 | 44.7 | 60.5 |

| T5-11B (Fine-tuned, Closed-Book) | 34.5 | 37.4 | 50.1 |

| GPT-3 Zero-Shot | 14.6 | 14.4 | 64.3 |

| GPT-3 One-Shot | 23.0 | 25.3 | 68.0 |

| GPT-3 Few-Shot | 29.9 | 41.5 | 71.2 |

En esta sección medimos la capacidad de GPT-3 para responder preguntas sobre conocimiento factual amplio. Dada la inmensa cantidad de consultas posibles, esta tarea normalmente se ha abordado utilizando un sistema de recuperación de información para encontrar texto relevante en combinación con un modelo que aprende a generar una respuesta dado la pregunta y el texto recuperado. Como este régimen permite a un sistema buscar y condicionar su respuesta sobre texto que potencialmente contiene la respuesta, se denomina «a libro abierto». [115] demostraron recientemente que un modelo de lenguaje grande puede desempeñarse sorprendentemente bien al responder directamente las preguntas sin condicionar sobre información auxiliar. Ellos denominan este régimen de evaluación más restrictivo como «a libro cerrado». Su trabajo sugiere que modelos de mayor capacidad podrían rendir incluso mejor, y nosotros ponemos a prueba esta hipótesis con GPT-3. Evaluamos GPT-3 en los 3 conjuntos de datos de [115]: Natural Questions [58], WebQuestions [5] y TriviaQA [49], usando las mismas particiones. Nótese que, además de que todos los resultados están en el régimen a libro cerrado, nuestro uso de evaluaciones few-shot, one-shot y zero-shot representa un régimen aún más estricto que el trabajo previo de QA a libro cerrado: además de no permitirse contenido externo, tampoco se permite el Lua error: Internal error: The interpreter exited with status 1. sobre el propio conjunto de Q&A.

Los resultados para GPT-3 se muestran en la Tabla 3.3. En TriviaQA alcanzamos 64,3 % en el régimen zero-shot, 68,0 % en el one-shot y 71,2 % en el few-shot. El resultado zero-shot ya supera al T5-11B ajustado finamente en 14,2 %, y también supera por 3,8 % a una versión con predicción de spans adaptada para Q&A durante el Lua error: Internal error: The interpreter exited with status 1.. El resultado one-shot mejora un 3,7 % e iguala el SOTA para un sistema de QA de dominio abierto que no solo se ajusta finamente sino que también utiliza un mecanismo de recuperación aprendido sobre un índice vectorial denso de 15,3 mil millones de parámetros sobre 21 millones de documentos [75]. El resultado few-shot de GPT-3 mejora aún más el rendimiento en otro 3,2 % por encima de esto.

En WebQuestions (WebQs), GPT-3 alcanza 14,4 % en el régimen zero-shot, 25,3 % en el one-shot y 41,5 % en el few-shot. Esto se compara con el 37,4 % del T5-11B ajustado finamente y el 44,7 % del T5-11B+SSM ajustado finamente, que utiliza un procedimiento de Lua error: Internal error: The interpreter exited with status 1. específico para Q&A. GPT-3 en el régimen few-shot se aproxima al rendimiento de los modelos de última generación ajustados finamente. Notablemente, en comparación con TriviaQA, WebQS muestra una ganancia mucho mayor desde zero-shot a few-shot (y de hecho su rendimiento zero-shot y one-shot es pobre), lo que quizá sugiera que las preguntas de WebQs y/o el estilo de sus respuestas están fuera de la distribución para GPT-3. Sin embargo, GPT-3 parece capaz de adaptarse a esta distribución, recuperando un fuerte rendimiento en el régimen few-shot.

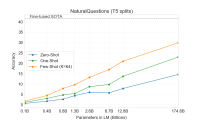

En Natural Questions (NQs) GPT-3 alcanza 14,6 % en el régimen zero-shot, 23,0 % en el one-shot y 29,9 % en el few-shot, comparado con el 36,6 % del T5 11B+SSM ajustado finamente. De manera similar a WebQS, la gran ganancia de zero-shot a few-shot puede sugerir un cambio de distribución, y también puede explicar el rendimiento menos competitivo en comparación con TriviaQA y WebQS. En particular, las preguntas en NQs tienden hacia conocimiento muy granular específicamente sobre Wikipedia, lo que podría estar poniendo a prueba los límites de la capacidad de GPT-3 y la amplitud de la distribución de Lua error: Internal error: The interpreter exited with status 1..

En conjunto, en uno de los tres conjuntos de datos el one-shot de GPT-3 iguala el SOTA de Lua error: Internal error: The interpreter exited with status 1. de dominio abierto. En los otros dos conjuntos se acerca al rendimiento del SOTA a libro cerrado a pesar de no usar Lua error: Internal error: The interpreter exited with status 1.. En los 3 conjuntos de datos, encontramos que el rendimiento escala de manera muy suave con el tamaño del modelo (Figura 3.3 y Apéndice H Figura H.7), lo que posiblemente refleja la idea de que la capacidad del modelo se traduce directamente en más «conocimiento» absorbido en los parámetros del modelo.

3.3 Traducción

Para GPT-2 se utilizó un filtro sobre una colección multilingüe de documentos para producir un conjunto de datos solo en inglés debido a preocupaciones de capacidad. Aun con este filtrado, GPT-2 mostró cierta evidencia de capacidad multilingüe y se desempeñó de manera no trivial al traducir entre francés e inglés a pesar de entrenar solo con 10 megabytes de texto francés residual. Dado que aumentamos la capacidad en más de dos órdenes de magnitud de GPT-2 a GPT-3, también ampliamos el alcance del conjunto de datos de entrenamiento para incluir más representación de otros idiomas, aunque esta sigue siendo un área para mejorar. Como se discute en 2.2 la mayor parte de nuestros datos provienen del Common Crawl en bruto con solo filtrado basado en calidad. Aunque los datos de entrenamiento de GPT-3 siguen siendo principalmente en inglés (93 % por recuento de palabras), también incluyen un 7 % de texto en otros idiomas. Estos idiomas se documentan en el material complementario. Para entender mejor la capacidad de traducción, también ampliamos nuestro análisis para incluir dos idiomas adicionales comúnmente estudiados, alemán y rumano.

Los enfoques existentes de traducción automática no supervisada a menudo combinan Lua error: Internal error: The interpreter exited with status 1. sobre un par de conjuntos de datos monolingües con back-translation [123] para tender un puente entre los dos idiomas de manera controlada. En contraste, GPT-3 aprende de una mezcla de datos de entrenamiento que combina muchos idiomas de manera natural, mezclándolos a nivel de palabra, oración y documento. GPT-3 también utiliza un único objetivo de entrenamiento que no está personalizado ni diseñado para ninguna tarea en particular. Sin embargo, nuestros regímenes one/few-shot no son estrictamente comparables al trabajo no supervisado previo, ya que utilizan una pequeña cantidad de ejemplos pareados (1 o 64). Esto corresponde a hasta una o dos páginas de datos de entrenamiento en contexto.

| Configuración | En$ {\textstyle \rightarrow} $Fr | Fr$ {\textstyle \rightarrow} $En | En$ {\textstyle \rightarrow} $De | De$ {\textstyle \rightarrow} $En | En$ {\textstyle \rightarrow} $Ro | Ro$ {\textstyle \rightarrow} $En |

|---|---|---|---|---|---|---|

| SOTA (Supervised) | 45.6a | 35.0 b | 41.2c | 40.2d | 38.5e | 39.9e |

| XLM [61] | 33.4 | 33.3 | 26.4 | 34.3 | 33.3 | 31.8 |

| MASS [127] | 37.5 | 34.9 | 28.3 | 35.2 | 35.2 | 33.1 |

| mBART [66] | - | - | 29.8 | 34.0 | 35.0 | 30.5 |

| GPT-3 Zero-Shot | 25.2 | 21.2 | 24.6 | 27.2 | 14.1 | 19.9 |

| GPT-3 One-Shot | 28.3 | 33.7 | 26.2 | 30.4 | 20.6 | 38.6 |

| GPT-3 Few-Shot | 32.6 | 39.2 | 29.7 | 40.6 | 21.0 | 39.5 |

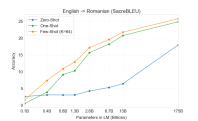

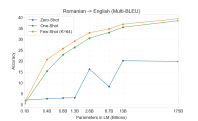

Los resultados se muestran en la Tabla 3.4. El GPT-3 zero-shot, que solo recibe una descripción en lenguaje natural de la tarea, todavía rinde por debajo de los recientes resultados de NMT no supervisada. Sin embargo, proporcionar una sola demostración de ejemplo para cada tarea de traducción mejora el rendimiento en más de 7 BLEU y se acerca a un rendimiento competitivo con el trabajo previo. GPT-3 en el régimen few-shot completo mejora otros 4 BLEU adicionales, resultando en un rendimiento promedio similar al del trabajo previo de NMT no supervisada. GPT-3 muestra una notable asimetría en su rendimiento dependiendo de la dirección de idioma. Para los tres idiomas de entrada estudiados, GPT-3 supera significativamente al trabajo previo de NMT no supervisada al traducir al inglés, pero rinde peor al traducir en la otra dirección. El rendimiento en En-Ro es un valor atípico notable, más de 10 BLEU por debajo del trabajo previo de NMT no supervisada. Esto podría ser una debilidad debida a reutilizar el Lua error: Internal error: The interpreter exited with status 1. BPE a nivel de bytes de GPT-2, que se desarrolló para un conjunto de datos de entrenamiento casi enteramente en inglés. Para Fr-En y De-En, el GPT-3 few-shot supera el mejor resultado supervisado que pudimos encontrar pero, debido a nuestra falta de familiaridad con la literatura y a que estos parecen ser benchmarks no competitivos, no sospechamos que esos resultados representen el verdadero estado del arte. Para Ro-En, el GPT-3 few-shot rinde dentro de 0,5 BLEU del SOTA general, que se logra mediante una combinación de Lua error: Internal error: The interpreter exited with status 1. no supervisado, Lua error: Internal error: The interpreter exited with status 1. supervisado sobre 608K ejemplos etiquetados y back-translation [70].

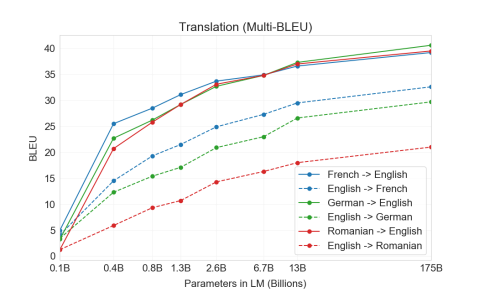

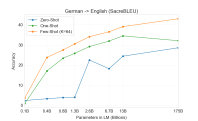

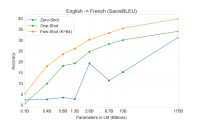

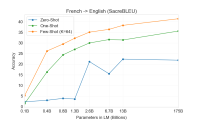

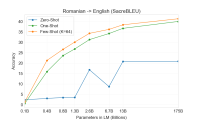

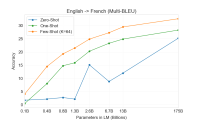

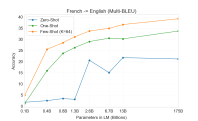

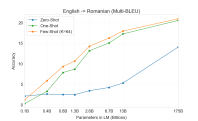

Por último, en todos los pares de idiomas y en los tres regímenes (zero-, one- y few-shot), hay una tendencia suave de mejora con la capacidad del modelo. Esto se muestra en la Figura 3.4 para el caso de los resultados few-shot, y el escalado para los tres regímenes se presenta en el Apéndice H.

3.4 Tareas de Estilo Winograd

| Configuración | Winograd | Winogrande (XL) |

|---|---|---|

| Fine-tuned SOTA | 90.1a | 84.6b |

| GPT-3 Zero-Shot | 88.3* | 70.2 |

| GPT-3 One-Shot | 89.7* | 73.2 |

| GPT-3 Few-Shot | 88.6* | 77.7 |

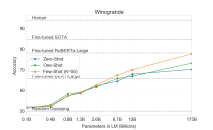

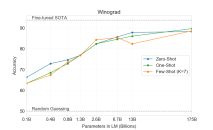

El Winograd Schemas Challenge [65] es una tarea clásica en PLN que consiste en determinar a qué palabra se refiere un pronombre cuando este es gramaticalmente ambiguo pero semánticamente inequívoco para un humano. Recientemente los modelos de lenguaje ajustados finamente han alcanzado un rendimiento cercano al humano en el conjunto de datos Winograd original, pero versiones más difíciles como el conjunto de datos Winogrande extraído de manera adversarial [118] aún quedan significativamente rezagados respecto al rendimiento humano. Probamos el rendimiento de GPT-3 tanto en Winograd como en Winogrande, como de costumbre en los regímenes zero-, one- y few-shot.

En Winograd evaluamos GPT-3 sobre el conjunto original de 273 esquemas de Winograd, usando el mismo método de «evaluación parcial» descrito en [117]. Nótese que este régimen difiere ligeramente de la tarea WSC en el benchmark SuperGLUE, que se presenta como clasificación binaria y requiere extracción de entidades para convertirla a la forma descrita en esta sección. En Winograd GPT-3 alcanza 88,3 %, 89,7 % y 88,6 % en los regímenes zero-shot, one-shot y few-shot, no mostrando un aprendizaje en contexto claro pero, en todos los casos, alcanzando resultados sólidos a solo unos puntos por debajo del estado del arte y del rendimiento humano estimado. Notamos que el análisis de contaminación encontró algunos esquemas Winograd en los datos de entrenamiento, pero esto parece tener solo un pequeño efecto en los resultados (véase la Sección 4.1).

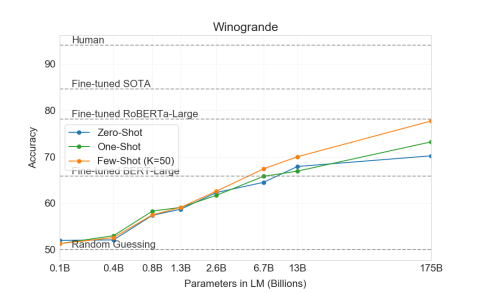

En el conjunto de datos más difícil Winogrande sí encontramos ganancias para el aprendizaje en contexto: GPT-3 alcanza 70,2 % en el régimen zero-shot, 73,2 % en el one-shot y 77,7 % en el few-shot. A modo de comparación, un modelo RoBERTa ajustado finamente alcanza 79 %, el estado del arte es 84,6 % alcanzado con un modelo de alta capacidad ajustado finamente (T5), y el rendimiento humano en la tarea reportado por [118] es de 94,0 %.

3.5 Razonamiento de Sentido Común

| Configuración | PIQA | ARC (Easy) | ARC (Challenge) | OpenBookQA |

|---|---|---|---|---|

| Fine-tuned SOTA | 79.4 | 92.0[55] | 78.5[55] | 87.2[55] |

| GPT-3 Zero-Shot | 80.5* | 68.8 | 51.4 | 57.6 |

| GPT-3 One-Shot | 80.5* | 71.2 | 53.2 | 58.8 |

| GPT-3 Few-Shot | 82.8* | 70.1 | 51.5 | 65.4 |

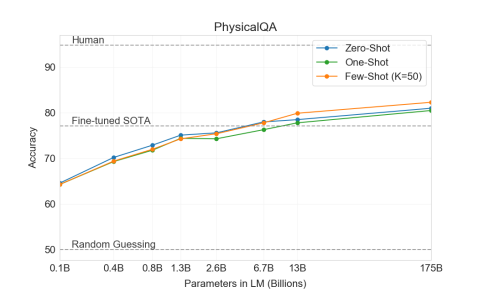

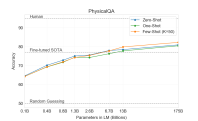

A continuación consideramos tres conjuntos de datos que intentan capturar el razonamiento físico o científico, distinto de la compleción de oraciones, la comprensión lectora o la respuesta a preguntas de conocimiento general. El primero, PhysicalQA (PIQA) [11], hace preguntas de sentido común sobre cómo funciona el mundo físico y está pensado como una sonda de la comprensión arraigada del mundo. GPT-3 alcanza un 81,0 % de exactitud en zero-shot, 80,5 % en one-shot y 82,8 % en few-shot (esta última medida en el servidor de prueba de PIQA). Esto se compara favorablemente con el estado del arte previo del 79,4 % de un RoBERTa ajustado finamente. PIQA muestra un escalado relativamente superficial con el tamaño del modelo y todavía está más de 10 % por debajo del rendimiento humano, pero los resultados few-shot e incluso zero-shot de GPT-3 superan el estado del arte actual. Nuestro análisis marcó PIQA por un posible problema de contaminación de datos (a pesar de que las etiquetas de prueba están ocultas), por lo que conservadoramente marcamos el resultado con un asterisco. Véase la Sección 4.1 para más detalles.

ARC [14] es un conjunto de datos de preguntas de selección múltiple recolectadas de exámenes de ciencia de 3.º a 9.º grado. En la versión «Challenge» del conjunto de datos, que ha sido filtrada para incluir preguntas que métodos estadísticos simples o de recuperación de información no pueden responder correctamente, GPT-3 alcanza un 51,4 % de exactitud en el régimen zero-shot, 53,2 % en el one-shot y 51,5 % en el few-shot. Esto se aproxima al rendimiento de una línea base RoBERTa ajustada finamente (55,9 %) de UnifiedQA [55]. En la versión «Easy» del conjunto de datos (preguntas que cualquiera de los enfoques base mencionados respondió correctamente), GPT-3 alcanza 68,8 %, 71,2 % y 70,1 %, lo que excede ligeramente una línea base RoBERTa ajustada finamente de [55]. Sin embargo, ambos resultados siguen siendo mucho peores que los SOTA generales alcanzados por UnifiedQA, que supera los resultados few-shot de GPT-3 en un 27 % en el conjunto challenge y un 22 % en el conjunto easy.

En OpenBookQA [84], GPT-3 mejora significativamente del régimen zero al few-shot, pero todavía está más de 20 puntos por debajo del SOTA general. El rendimiento few-shot de GPT-3 es similar a una línea base BERT Large ajustada finamente del leaderboard.

En general, el aprendizaje en contexto con GPT-3 muestra resultados mixtos en tareas de razonamiento de sentido común, con solo ganancias pequeñas e inconsistentes observadas en los regímenes one- y few-shot tanto para PIQA como para ARC, pero se observa una mejora significativa en OpenBookQA. GPT-3 establece SOTA en el nuevo conjunto de datos PIQA en todos los regímenes de evaluación.

3.6 Comprensión de Lectura

| Configuración | CoQA | DROP | QuAC | SQuADv2 | RACE-h | RACE-m |

|---|---|---|---|---|---|---|

| Fine-tuned SOTA | 90.7a | 89.1b | 74.4c | 93.0d | 90.0e | 93.1e |

| GPT-3 Zero-Shot | 81.5 | 23.6 | 41.5 | 59.5 | 45.5 | 58.4 |

| GPT-3 One-Shot | 84.0 | 34.3 | 43.3 | 65.4 | 45.9 | 57.4 |

| GPT-3 Few-Shot | 85.0 | 36.5 | 44.3 | 69.8 | 46.8 | 58.1 |

A continuación evaluamos GPT-3 en la tarea de comprensión lectora. Utilizamos un conjunto de 5 conjuntos de datos que incluyen formatos de respuesta abstractivos, de selección múltiple y basados en spans, tanto en regímenes de diálogo como de pregunta única. Observamos una amplia dispersión en el rendimiento de GPT-3 a través de estos conjuntos de datos, lo que sugiere capacidad variable con diferentes formatos de respuesta. En general observamos que GPT-3 está a la par con las líneas base iniciales y los primeros resultados entrenados usando representaciones contextuales en cada conjunto de datos respectivo.

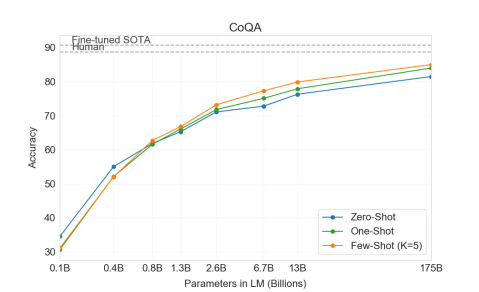

GPT-3 rinde mejor (a menos de 3 puntos de la línea base humana) en CoQA [106], un conjunto de datos conversacional de forma libre, y rinde peor (13 F1 por debajo de una línea base ELMo) en QuAC [16], un conjunto de datos que requiere modelar actos de diálogo estructurados y selección de spans de respuesta de interacciones profesor-alumno. En DROP [27], un conjunto de datos que prueba el razonamiento discreto y la numeralidad en el contexto de la comprensión lectora, GPT-3 en un régimen few-shot supera la línea base BERT ajustada finamente del artículo original, pero todavía está bastante por debajo tanto del rendimiento humano como de los enfoques de última generación que aumentan redes neuronales con sistemas simbólicos [110]. En SQuAD 2.0 [108], GPT-3 demuestra sus capacidades de aprendizaje few-shot, mejorando casi 10 F1 (hasta 69,8) en comparación con el régimen zero-shot. Esto le permite superar ligeramente el mejor resultado ajustado finamente del artículo original. En RACE [78], un conjunto de datos de selección múltiple de exámenes de inglés de secundaria y preparatoria, GPT-3 rinde relativamente débil y solo es competitivo con los primeros trabajos que utilizan representaciones contextuales, y todavía está un 45 % por debajo del SOTA.

| SuperGLUE | BoolQ | CB | CB | COPA | RTE | |

|---|---|---|---|---|---|---|

| Average | Precisión | Precisión | F1 | Precisión | Precisión | |

| Fine-tuned SOTA | 89.0 | 91.0 | 96.9 | 93.9 | 94.8 | 92.5 |

| Fine-tuned BERT-Large | 69.0 | 77.4 | 83.6 | 75.7 | 70.6 | 71.7 |

| GPT-3 Few-Shot | 71.8 | 76.4 | 75.6 | 52.0 | 92.0 | 69.0 |

| WiC | WSC | MultiRC | MultiRC | ReCoRD | ReCoRD | |

|---|---|---|---|---|---|---|

| Accuracy | Precisión | Precisión | F1a | Precisión | F1 | |

| Fine-tuned SOTA | 76.1 | 93.8 | 62.3 | 88.2 | 92.5 | 93.3 |

| Fine-tuned BERT-Large | 69.6 | 64.6 | 24.1 | 70.0 | 71.3 | 72.0 |

| GPT-3 Few-Shot | 49.4 | 80.1 | 30.5 | 75.4 | 90.2 | 91.1 |

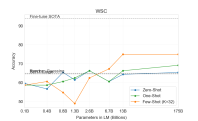

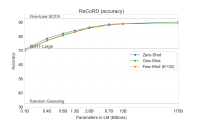

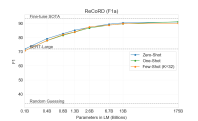

3.7 SuperGLUE

Para agregar mejor los resultados en tareas de PLN y compararlos con modelos populares como BERT y RoBERTa de manera más sistemática, también evaluamos GPT-3 en una colección estandarizada de conjuntos de datos, el benchmark SuperGLUE [135] [135] [17] [25] [105] [54] [142] [21] [8] [34] [6] [96] [98]. El rendimiento de GPT-3 sobre el conjunto de prueba SuperGLUE se muestra en la Tabla 3.8. En el régimen few-shot, usamos 32 ejemplos para todas las tareas, muestreados aleatoriamente del conjunto de entrenamiento. Para todas las tareas excepto WSC y MultiRC, muestreamos un nuevo conjunto de ejemplos para usar en el contexto de cada problema. Para WSC y MultiRC, usamos el mismo conjunto de ejemplos extraídos aleatoriamente del conjunto de entrenamiento como contexto para todos los problemas que evaluamos.

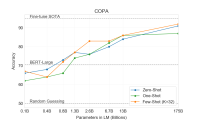

Observamos un amplio rango en el rendimiento de GPT-3 a través de las tareas. En COPA y ReCoRD GPT-3 alcanza un rendimiento cercano al SOTA en los regímenes one-shot y few-shot, con COPA quedando solo unos pocos puntos por debajo y consiguiendo el segundo lugar en el leaderboard, donde el primer lugar lo ocupa un modelo ajustado finamente de 11 mil millones de parámetros (T5). En WSC, el rendimiento sigue siendo relativamente fuerte, alcanzando 80,1 % en el régimen few-shot (nótese que GPT-3 alcanza 88,6 % en el conjunto de datos Winograd original como se describe en la Sección 3.4). En BoolQ, MultiRC y RTE, el rendimiento es razonable, igualando aproximadamente a un BERT-Large ajustado finamente. En CB vemos signos de vida con un 75,6 % en el régimen few-shot.

WiC es un punto débil notable, con un rendimiento few-shot del 49,4 % (al azar). Probamos varias formulaciones y enunciados distintos para WiC (que consiste en determinar si una palabra se usa con el mismo significado en dos oraciones), y ninguno fue capaz de lograr un rendimiento sólido. Esto insinúa un fenómeno que se aclarará en la siguiente sección (que discute el benchmark ANLI): GPT-3 parece ser débil en el régimen few-shot u one-shot en algunas tareas que implican comparar dos oraciones o fragmentos, por ejemplo si una palabra se usa de la misma manera en dos oraciones (WiC), si una oración es paráfrasis de otra, o si una oración implica otra. Esto también podría explicar las puntuaciones comparativamente bajas en RTE y CB, que también siguen este formato. A pesar de estas debilidades, GPT-3 supera a un BERT-large ajustado finamente en cuatro de ocho tareas y en dos tareas se acerca al estado del arte mantenido por un modelo de 11 mil millones de parámetros ajustado finamente.

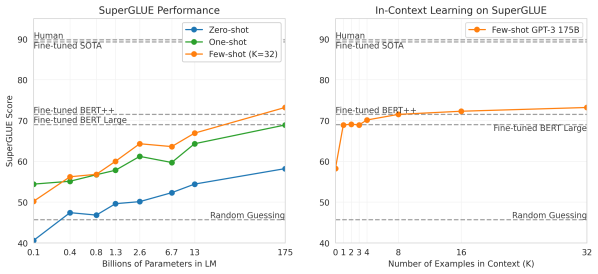

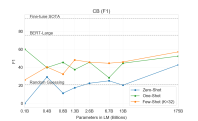

Por último, notamos que la puntuación few-shot en SuperGLUE mejora de manera estable tanto con el tamaño del modelo como con el número de ejemplos en el contexto, mostrando beneficios crecientes del aprendizaje en contexto (Figura 3.8). Escalamos $ {\textstyle K} $ hasta 32 ejemplos por tarea, después de lo cual ejemplos adicionales no caben de manera fiable en nuestro contexto. Al barrer sobre valores de $ {\textstyle K} $, encontramos que GPT-3 requiere menos de ocho ejemplos en total por tarea para superar a un BERT-Large ajustado finamente en la puntuación general de SuperGLUE.

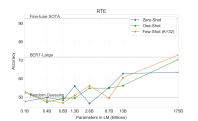

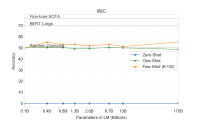

3.8 NLI

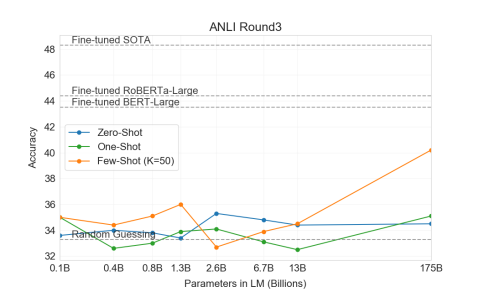

La inferencia de lenguaje natural (NLI) [31] concierne a la capacidad de comprender la relación entre dos oraciones. En la práctica, esta tarea suele estructurarse como un problema de clasificación de dos o tres clases, donde el modelo clasifica si la segunda oración se sigue lógicamente de la primera, contradice la primera oración o es posiblemente verdadera (neutral). SuperGLUE incluye un conjunto de datos NLI, RTE, que evalúa la versión binaria de la tarea. En RTE, solo la versión más grande de GPT-3 rinde de manera convincente mejor que el azar (56 %) en cualquier régimen de evaluación, pero en un régimen few-shot GPT-3 rinde de manera similar a un BERT Large ajustado finamente para una sola tarea. También evaluamos en el conjunto de datos Adversarial Natural Language Inference (ANLI), introducido recientemente [94]. ANLI es un conjunto de datos difícil que emplea una serie de preguntas de inferencia de lenguaje natural extraídas de manera adversarial en tres rondas (R1, R2 y R3). De manera similar a RTE, todos nuestros modelos más pequeños que GPT-3 rinden casi exactamente al azar en ANLI, incluso en el régimen few-shot ($ {\textstyle \sim {33\%}} $), mientras que GPT-3 muestra signos de vida en la Ronda 3. Los resultados para ANLI R3 se destacan en la Figura 3.9 y los resultados completos para todas las rondas se encuentran en el Apéndice H. Estos resultados tanto en RTE como en ANLI sugieren que NLI sigue siendo una tarea muy difícil para los modelos de lenguaje y apenas comienzan a mostrar signos de progreso.

3.9 Tareas Sintéticas y Cualitativas

Una forma de sondear el rango de habilidades de GPT-3 en el régimen few-shot (o zero- y one-shot) es darle tareas que requieran que realice razonamiento computacional simple sobre la marcha, reconozca un patrón novedoso que es poco probable que haya ocurrido durante el entrenamiento o se adapte rápidamente a una tarea inusual. Diseñamos varias tareas para probar este tipo de habilidades. Primero, probamos la capacidad de GPT-3 para realizar aritmética. Segundo, creamos varias tareas que implican reordenar o desordenar las letras de una palabra, tareas que es poco probable que se hayan visto exactamente durante el entrenamiento. Tercero, probamos la capacidad de GPT-3 para resolver problemas de analogía estilo SAT few-shot. Por último, probamos GPT-3 en varias tareas cualitativas, incluyendo el uso de palabras nuevas en una oración, la corrección gramatical en inglés y la generación de artículos de noticias. Publicaremos los conjuntos de datos sintéticos con la esperanza de estimular un mayor estudio del comportamiento en tiempo de prueba de los modelos de lenguaje.

3.9.1 Aritmética

Para probar la capacidad de GPT-3 de realizar operaciones aritméticas simples sin entrenamiento específico de tarea, desarrollamos una pequeña batería de 10 pruebas que consisten en plantear a GPT-3 un problema aritmético simple en lenguaje natural:

•

Suma de 2 dígitos (2D+) – Se le pide al modelo sumar dos enteros muestreados uniformemente de $ {\textstyle \lbrack 0,100)} $, planteados en forma de pregunta, p. ej. «Q: What is 48 plus 76? A: 124.»

•

Resta de 2 dígitos (2D-) – Se le pide al modelo restar dos enteros muestreados uniformemente de $ {\textstyle \lbrack 0,100)} $; la respuesta puede ser negativa. Ejemplo: «Q: What is 34 minus 53? A: -19».

•

Suma de 3 dígitos (3D+) – Igual que la suma de 2 dígitos, salvo que los números se muestrean uniformemente de $ {\textstyle \lbrack 0,1000)} $.

•

Resta de 3 dígitos (3D-) – Igual que la resta de 2 dígitos, salvo que los números se muestrean uniformemente de $ {\textstyle \lbrack 0,1000)} $.

•

Suma de 4 dígitos (4D+) – Igual que la suma de 3 dígitos, salvo que se muestrean uniformemente de $ {\textstyle \lbrack 0,10000)} $.

•

Resta de 4 dígitos (4D-) – Igual que la resta de 3 dígitos, salvo que se muestrean uniformemente de $ {\textstyle \lbrack 0,10000)} $.

•

Suma de 5 dígitos (5D+) – Igual que la suma de 3 dígitos, salvo que se muestrean uniformemente de $ {\textstyle \lbrack 0,100000)} $.

•

Resta de 5 dígitos (5D-) – Igual que la resta de 3 dígitos, salvo que se muestrean uniformemente de $ {\textstyle \lbrack 0,100000)} $.

•

Multiplicación de 2 dígitos (2Dx) – Se le pide al modelo multiplicar dos enteros muestreados uniformemente de $ {\textstyle \lbrack 0,100)} $, p. ej. «Q: What is 24 times 42? A: 1008».

•

Compuesta de un dígito (1DC) – Se le pide al modelo realizar una operación compuesta sobre tres números de 1 dígito, con paréntesis alrededor de los dos últimos. Por ejemplo, «Q: What is 6+(4*8)? A: 38». Los tres números de 1 dígito se seleccionan uniformemente de $ {\textstyle \lbrack 0,10)} $ y las operaciones se seleccionan uniformemente de {+,-,*}.

En las 10 tareas el modelo debe generar la respuesta correcta exactamente. Para cada tarea generamos un conjunto de datos de 2.000 instancias aleatorias de la tarea y evaluamos todos los modelos sobre esas instancias.

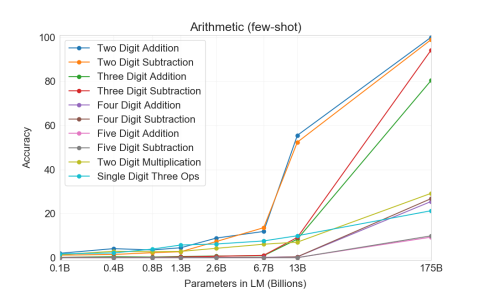

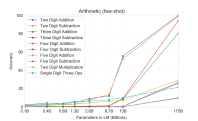

Primero evaluamos GPT-3 en el régimen few-shot, cuyos resultados se muestran en la Figura 3.10. En suma y resta, GPT-3 muestra una fuerte competencia cuando el número de dígitos es pequeño, alcanzando 100 % de exactitud en suma de 2 dígitos, 98,9 % en resta de 2 dígitos, 80,2 % en suma de 3 dígitos y 94,2 % en resta de 3 dígitos. El rendimiento disminuye a medida que aumenta el número de dígitos, pero GPT-3 todavía alcanza 25-26 % de exactitud en operaciones de cuatro dígitos y 9-10 % de exactitud en operaciones de cinco dígitos, lo que sugiere al menos cierta capacidad para generalizar a un mayor número de dígitos. GPT-3 también alcanza un 29,2 % de exactitud en multiplicación de 2 dígitos, una operación especialmente intensiva en cómputo. Por último, GPT-3 alcanza un 21,3 % de exactitud en operaciones combinadas de un dígito (por ejemplo, 9*(7+5)), lo que sugiere que tiene cierta robustez más allá de operaciones simples.

| Configuración | 2D+ | 2D- | 3D+ | 3D- | 4D+ | 4D- | 5D+ | 5D- | 2Dx | 1DC |

|---|---|---|---|---|---|---|---|---|---|---|

| GPT-3 Zero-shot | 76.9 | 58.0 | 34.2 | 48.3 | 4.0 | 7.5 | 0.7 | 0.8 | 19.8 | 9.8 |

| GPT-3 One-shot | 99.6 | 86.4 | 65.5 | 78.7 | 14.0 | 14.0 | 3.5 | 3.8 | 27.4 | 14.3 |

| GPT-3 Few-shot | 100.0 | 98.9 | 80.4 | 94.2 | 25.5 | 26.8 | 9.3 | 9.9 | 29.2 | 21.3 |

Como deja claro la Figura 3.10, los modelos pequeños rinden pobremente en todas estas tareas: incluso el modelo de 13 mil millones de parámetros (el segundo más grande después del GPT-3 completo de 175 mil millones) puede resolver suma y resta de 2 dígitos solo la mitad del tiempo, y todas las demás operaciones menos del 10 % del tiempo.

El rendimiento one-shot y zero-shot está algo degradado en relación con el rendimiento few-shot, lo que sugiere que la adaptación a la tarea (o, como mínimo, el reconocimiento de la tarea) es importante para realizar correctamente estas computaciones. Sin embargo, el rendimiento one-shot sigue siendo bastante fuerte, e incluso el rendimiento zero-shot del GPT-3 completo supera significativamente el aprendizaje few-shot de todos los modelos más pequeños. Los tres regímenes para el GPT-3 completo se muestran en la Tabla 3.9, y el escalado de la capacidad del modelo para los tres regímenes se muestra en el Apéndice H.

Para verificar al vuelo si el modelo simplemente está memorizando problemas aritméticos específicos, tomamos los problemas aritméticos de 3 dígitos de nuestro conjunto de prueba y los buscamos en nuestros datos de entrenamiento tanto en las formas "<NUM1> + <NUM2> =" como "<NUM1> plus <NUM2>". De los 2.000 problemas de suma encontramos solo 17 coincidencias (0,8 %) y de los 2.000 problemas de resta encontramos solo 2 coincidencias (0,1 %), lo que sugiere que solo una fracción trivial de las respuestas correctas pudo haberse memorizado. Además, la inspección de respuestas incorrectas revela que el modelo a menudo comete errores como no «llevar» un «1», lo que sugiere que en realidad está intentando realizar el cálculo relevante en lugar de memorizar una tabla.

En general, GPT-3 muestra una competencia razonable en aritmética moderadamente compleja en los entornos few-shot, one-shot e incluso zero-shot.

3.9.2 Tareas de Manipulación y Codificación de Palabras

Para probar la capacidad de GPT-3 de aprender manipulaciones simbólicas novedosas a partir de unos pocos ejemplos, diseñamos una pequeña batería de 5 tareas de «manipulación de caracteres». Cada tarea consiste en darle al modelo una palabra distorsionada por alguna combinación de mezcla, adición o eliminación de caracteres, y pedirle que recupere la palabra original. Las 5 tareas son:

| Configuración | CL | A1 | A2 | RI | RW |

|---|---|---|---|---|---|

| GPT-3 Zero-shot | 3.66 | 2.28 | 8.91 | 8.26 | 0.09 |

| GPT-3 One-shot | 21.7 | 8.62 | 25.9 | 45.4 | 0.48 |

| GPT-3 Few-shot | 37.9 | 15.1 | 39.7 | 67.2 | 0.44 |

•

Cycle letters in word (CL) – Al modelo se le da una palabra con sus letras desplazadas cíclicamente, luego el símbolo «=», y se espera que genere la palabra original. Por ejemplo, podría recibir «lyinevitab» y debería producir «inevitably».

•

Anagrams of all but first and last characters (A1) – Al modelo se le da una palabra donde todas las letras excepto la primera y la última han sido permutadas aleatoriamente, y debe producir la palabra original. Ejemplo: criroptuon = corruption.

•

Anagrams of all but first and last 2 characters (A2) – Al modelo se le da una palabra donde todas las letras excepto las 2 primeras y las 2 últimas han sido permutadas aleatoriamente, y debe recuperar la palabra original. Ejemplo: opoepnnt $ {\textstyle \rightarrow} $ opponent.

•

Random insertion in word (RI) – Se inserta un carácter de puntuación o espacio aleatorio entre cada letra de una palabra, y el modelo debe producir la palabra original. Ejemplo: s.u!c/c!e.s s i/o/n = succession.

•

Reversed words (RW) – Al modelo se le da una palabra escrita al revés, y debe producir la palabra original. Ejemplo: stcejbo $ {\textstyle \rightarrow} $ objects.

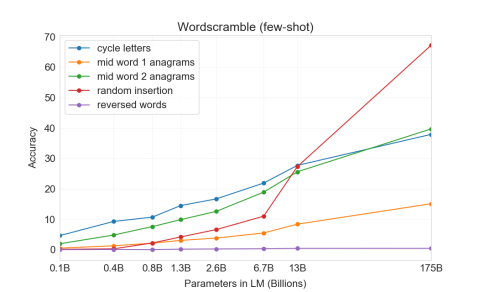

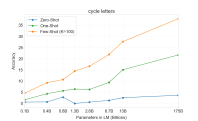

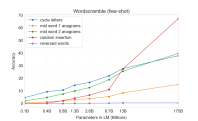

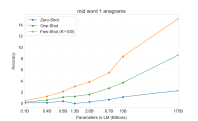

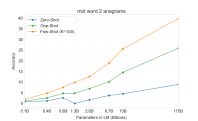

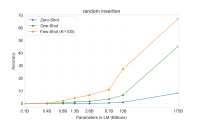

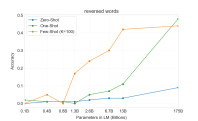

Para cada tarea generamos 10.000 ejemplos, los cuales elegimos como las 10.000 palabras más frecuentes según [92] de longitud mayor a 4 caracteres y menor a 15 caracteres. Los resultados few-shot se muestran en la Figura 3.11. El rendimiento por tarea tiende a crecer suavemente con el tamaño del modelo, alcanzando el GPT-3 completo un 66,9 % en remoción de inserciones aleatorias, un 38,6 % en desplazamiento cíclico de letras, un 40,2 % en la tarea de anagrama más fácil y un 15,1 % en la tarea de anagrama más difícil (donde solo se mantienen fijas las letras inicial y final). Ninguno de los modelos puede invertir las letras de una palabra.

En el régimen one-shot, el rendimiento es significativamente más débil (cae a la mitad o más), y en el régimen zero-shot el modelo rara vez puede realizar alguna de las tareas (Tabla 3.10). Esto sugiere que el modelo realmente parece aprender estas tareas en tiempo de prueba, ya que no puede realizarlas zero-shot y su naturaleza artificial hace improbable que aparezcan en los datos de Lua error: Internal error: The interpreter exited with status 1. (aunque no podemos confirmarlo con certeza).

Podemos cuantificar aún más el rendimiento mediante el trazado de «curvas de aprendizaje en contexto», que muestran el rendimiento de la tarea como función del número de ejemplos en contexto. Mostramos curvas de aprendizaje en contexto para la tarea de Inserción de Símbolos en la Figura 1.2. Podemos ver que los modelos más grandes son capaces de hacer un uso cada vez más efectivo de la información en contexto, incluyendo tanto ejemplos de tarea como descripciones de tarea en lenguaje natural.

Por último, vale la pena añadir que resolver estas tareas requiere manipulaciones a nivel de carácter, mientras que nuestra codificación BPE opera sobre fracciones significativas de una palabra (en promedio $ {\textstyle \sim 0.7} $ palabras por token), por lo que desde la perspectiva del LM tener éxito en estas tareas implica no solo manipular tokens BPE sino comprender y desglosar su subestructura. Además, CL, A1 y A2 no son biyectivas (es decir, la palabra desordenada no es una función determinista de la palabra revuelta), lo que requiere que el modelo realice cierta búsqueda para encontrar el desordenamiento correcto. Así, las habilidades implicadas parecen requerir un emparejamiento de patrones y una computación no triviales.

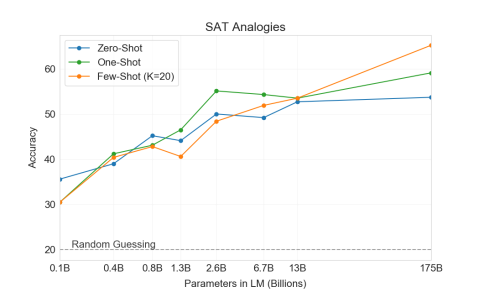

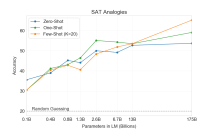

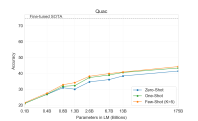

3.9.3 Analogías SAT

Para probar GPT-3 en otra tarea que es algo inusual respecto a la distribución típica del texto, recolectamos un conjunto de 374 problemas de «analogía SAT» [131]. Las analogías son un estilo de pregunta de selección múltiple que constituyó una sección del examen de ingreso a la universidad SAT antes de 2005. Un ejemplo típico es «audacious is to boldness as (a) sanctimonious is to hypocrisy, (b) anonymous is to identity, (c) remorseful is to misdeed, (d) deleterious is to result, (e) impressionable is to temptation». Se espera que el estudiante elija cuál de los cinco pares de palabras tiene la misma relación que el par original; en este ejemplo la respuesta es «sanctimonious is to hypocrisy». En esta tarea GPT-3 alcanza 65,2 % en el régimen few-shot, 59,1 % en el one-shot y 53,7 % en el zero-shot, mientras que la puntuación promedio entre solicitantes universitarios fue del 57 % [129] (la adivinación aleatoria da 20 %). Como se muestra en la Figura 3.12, los resultados mejoran con la escala, mejorando el modelo completo de 175 mil millones más de un 10 % comparado con el modelo de 13 mil millones de parámetros.

3.9.4 Generación de Artículos de Noticias