MTGR: Industrial-Scale Generative Recommendation Framework in Meituan/paper/zh

| Research Paper | |

|---|---|

| Authors | Ruidong Han; Bin Yin; Shangyu Chen; He Jiang; Fei Jiang; Xiang Li; Chi Ma; Mincong Huang; Xiaoguang Li; Chunzhen Jing; Yueming Han; Menglei Zhou; Lei Yu; Chuan Liu; Wei Lin |

| Year | 2025 |

| Topic area | NLP |

| Difficulty | Research |

| arXiv | 2505.18654 |

| Download PDF | |

MTGR: Industrial-Scale Generative Recommendation Framework in Meituan

Ruidong Han MeituanBeijingChina hanruidong@meituan.com , Bin Yin MeituanBeijingChina yinbin05@meituan.com , Shangyu Chen MeituanBeijingChina chenshangyu03@meituan.com , He Jiang MeituanBeijingChina jianghe06@meituan.com , Fei Jiang MeituanBeijingChina jiangfei05@meituan.com , Xiang Li MeituanBeijingChina lixiang245@meituan.com , Chi Ma MeituanBeijingChina machi04@meituan.com , Mincong Huang MeituanBeijingChina huangmincong@meituan.com , Xiaoguang Li MeituanBeijingChina lixiaoguang12@meituan.com , Chunzhen Jing MeituanBeijingChina jingchunzhen@meituan.com , Yueming Han MeituanBeijingChina hanyueming02@meituan.com , Menglei Zhou MeituanBeijingChina zhoumenglei@meituan.com , Lei Yu MeituanBeijingChina yulei37@meituan.com , Chuan Liu MeituanBeijingChina liuchuan11@meituan.com and Wei Lin MeituanBeijingChina linwei31@meituan.com

摘要

scaling law 已在自然語言處理和 computer vision 等眾多領域得到廣泛驗證。在推薦系統中,近期工作採用生成式推薦以獲得可擴展性,但其生成式方法需要放棄傳統推薦模型中精心構造的 cross feature。我們發現這種做法會顯著損害模型性能,且擴大模型規模根本無法彌補。本文提出 MTGR(Meituan Generative Recommendation)來解決這一問題。MTGR 基於 HSTU (Zhai et al., 2024) 架構進行建模,並能夠保留原 DLRM 的全部特徵,包括 cross feature。此外,MTGR 通過用戶級壓縮實現訓練與推理加速,從而保證高效擴展。我們還提出 Group-Layer Normalization (GLN) 以提升不同語義空間內的編碼性能,並提出 dynamic masking 策略以避免信息泄露。我們進一步優化訓練框架,支持計算複雜度為 DLRM 的 10 至 100 倍的模型,而成本基本不增加。MTGR 在單樣本前向推理上相比 DLRM 模型達到 $ {\textstyle 65} $x FLOPs,在線下與線上均取得了近兩年最大的收益。該突破已成功部署在美團——全球最大的外賣平台——並已承擔其主流量。

Scaling Law; Generative Recommendation ††ccs: 信息系統 推薦系統

1. 引言

scaling law 已被證明適用於大多數 deep learning 任務,包括語言模型 (Kaplan et al., 2020)、computer vision (Zhai et al., 2022; Peebles 與 Xie, 2023) 以及信息檢索 (Fang et al., 2024)。在工業推薦系統對高 QPS(Queries Per Second)和低延遲的要求下,模型的擴展通常同時受到訓練成本和推理時間的限制。目前關於排序模型擴展的研究可分為兩類:Deep Learning Recommendation Model(DLRM)和 Generative Recommendation Model(GRM)。DLRM 對單個用戶-物品對進行建模以學習用於排序的興趣概率,並通過設計更複雜的映射來擴展。GRM 像自然語言一樣按 token 組織數據,並通過 transformer 架構進行 next token prediction。

在工業推薦系統中,DLRM 已使用近十年,輸入通常包含大量精心設計的人工特徵,如 cross feature 111Cross feature 衡量多個原始特徵之間的交互,例如用戶對目標候選的歷史 click-through rate,以提升模型性能。然而 DLRM 在擴展時存在兩個顯著缺點:1) 隨着用戶行為的指數增長,傳統 DLRM 無法高效處理完整的用戶行為,往往需藉助序列檢索或設計低複雜度模塊進行學習,這限制了模型的學習能力 (Pi et al., 2020; Chen et al., 2021);2) 基於 DLRM 的擴展在訓練和推理上的成本與候選數量近似呈線性增長,使得開銷難以承受。

對於 GRM,近期研究指出其具有出色的可擴展性 (Zhai et al., 2024; Deng et al., 2025)。我們識別出兩個關鍵因素:1) GRM 直接對用戶行為的完整鏈條進行建模,將同一用戶下的多次曝光樣本壓縮為一次。這顯著減少了計算冗餘,同時相對 DLRM 允許端到端編碼更長的序列;2) GRM 採用帶高效 attention 計算的 transformer 架構 (Zhai et al., 2024; Dao et al., 2022),使模型的訓練和推理能夠滿足工業推薦系統的需求。然而 GRM 嚴重依賴 next token prediction 來建模完整的用戶行為序列,這要求移除候選與用戶之間的 cross feature。我們發現,排除 cross feature 會嚴重損害模型性能,且這種退化根本無法通過擴大規模來彌補。

如何構建一個既利用 cross feature 以保證有效性、又具備 GRM 可擴展性的排序模型?為解決該問題,我們提出 Meituan Generative Recommendation(MTGR)。相比傳統的 DLRM 與 GRM,MTGR 取其優點、舍其缺點。MTGR 保持與傳統 DLRM 一致的輸入特徵,包括 cross feature。具體而言,MTGR 通過將用戶特徵與候選特徵轉換為不同的 token 來重組特徵,得到一個 token 序列以支持高效的模型擴展。隨後 MTGR 將 cross feature 融入候選 token,並採用判別式損失進行學習。

MTGR 採用與 (Zhai et al., 2024) 中類似的 HSTU(Hierarchical Sequential Transduction Units)架構進行建模。在 HSTU 中,我們提出 Group-layer Normalization(GLN),分別對不同類型的 token 進行歸一化,從而能夠同時更好地建模多種異質信息。此外,我們提出 dynamic masking 策略,分別使用 full-attention、自回歸以及僅對自身可見,以保證性能並避免信息泄露。

與業界常用的 TensorFlow 不同,MTGR 訓練框架構建於 TorchRec (Ivchenko et al., 2022) 之上,並針對計算效率進行了優化。具體地,為了處理 sparse embedding 條目的實時插入/刪除,我們採用 dynamic hash table 替代靜態表。為提升效率,我們進行動態序列均衡以解決 GPU 間的計算負載不均,並採用 embedding ID 去重與自動 table 合併來加速 embedding lookup。我們還加入了包括 mixed precision 訓練和算子融合在內的實現層優化。相比 TorchRec,我們的優化框架將訓練吞吐提升 $ {\textstyle 1.6} $x – $ {\textstyle 2.4} $x,並在超過 $ {\textstyle 100} $ 張 GPU 上仍具有良好可擴展性。

我們在小規模數據集上驗證 MTGR 的可擴展性。隨後,我們設計了三種不同規模的模型,使用超過六個月的數據進行訓練,以驗證 scaling law 在線下和線上的表現。large 版本與多年優化的 DLRM 基線相比,前向計算的每樣本 FLOPs 達到 $ {\textstyle 65} $x,並在我們的場景中將轉化量提升 $ {\textstyle 1.22\%} $、CTR(Click-Through Rate)提升 $ {\textstyle 1.31\%} $。與此同時,訓練成本保持不變,推理成本降低 12%。MTGR-large 已部署在美團外賣推薦系統中,服務數億用戶。

總之,我們的貢獻可以總結如下:

•

MTGR 結合了 DLRM 與 GRM 的優點,保留了 DLRM 的全部特徵(包括 cross feature),同時具有與 GRM 同等的優秀可擴展性。

•

我們提出 Group-Layer Normalization 與 dynamic masking 策略以獲得更好的性能。

•

我們對基於 TorchRec 的 MTGR 訓練框架進行了系統性優化,以提升訓練性能。

•

線上線下實驗都驗證了 MTGR 性能與計算複雜度之間的冪律關係,以及其相對 DLRM 的優勢。

2. 相關工作

2.1. 深度學習推薦模型

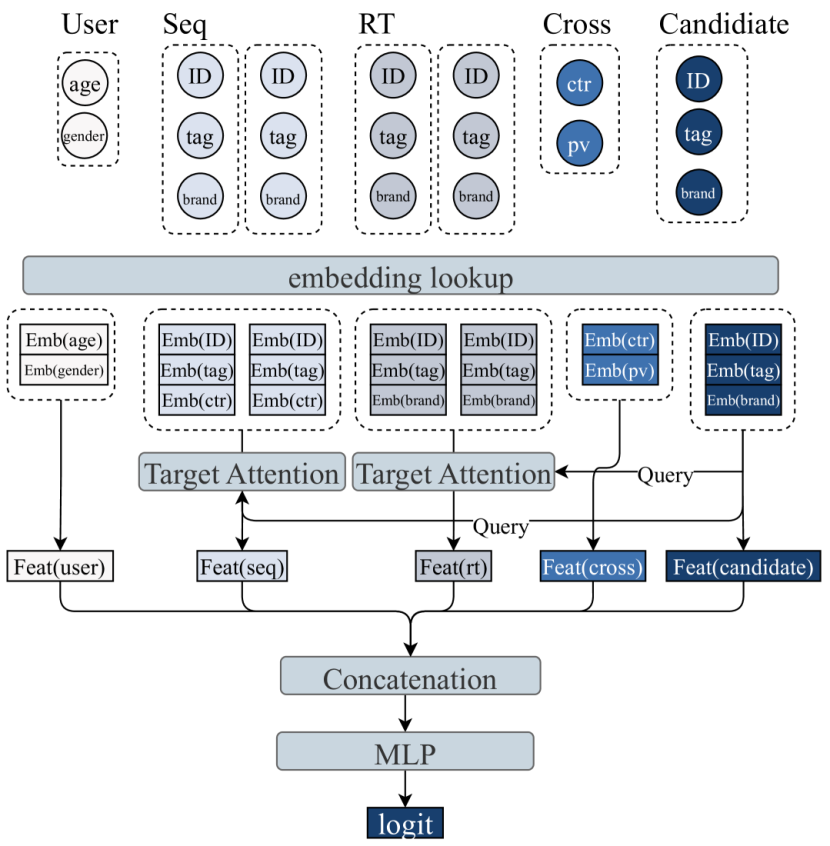

經典的 DLRM 結構通常包含許多輸入,如上下文(例如時間、位置)、用戶畫像(例如性別、年齡)、用戶行為序列以及帶有大量 cross feature 的目標 item。排序模型中尤為重要的兩個模塊是行為序列處理和特徵交互學習。行為序列模塊 (Zhou et al., 2018; Pi et al., 2020; Si et al., 2024) 通常採用 target attention 機制來捕捉用戶歷史行為與待預測物品之間的相似性。特徵交互模塊 (Lian et al., 2018; Tang et al., 2020; Wang et al., 2021, 2024) 旨在捕捉用戶與物品等不同特徵之間的交互,以產生最終預測。

2.2. 擴展推薦模型

根據 DLRM 中所擴展的不同模塊,存在兩種不同的方法。一種是擴展 cross module,即擴大整合用戶與物品信息的特徵交互模塊。(Zhang et al., 2024b) 引入可堆疊的 Wukong 層進行擴展。(Guo et al., 2023) 採用 multi-embedding 策略以應對 embedding collapse,從而提升模型可擴展性。另一種方法是擴展 user module,即只擴展用戶部分,使其對推理更友好。(Zhang et al., 2024a; Han et al., 2024) 通過僅擴展用戶表徵並將其緩存或廣播給不同的待預測物品來降低線上推理成本。(Shin et al., 2023; Yan et al., 2025) 設計了用戶表徵的預訓練方法,在下游任務中展示了可擴展性。

DLRM 的對照是 GRM。(Zhai et al., 2024) 通過將 HSTU 擴展到萬億參數級驗證了 scaling law。(Deng et al., 2025) 使用語義編碼替代傳統的 ID 表徵,將 DPO 優化與 HSTU 相結合,用統一的生成式模型替代級聯式學習框架。

3. 預備

3.1. 數據組織

傳統上,對於一個用戶及其對應的 $ {\textstyle K} $ 個候選,該用戶與第 $ {\textstyle i} $ 個候選構成的第 $ {\textstyle i} $ 個樣本可表示為 $ {\textstyle {\mathbb{D}}_{i} = {\lbrack\mathbf{U},\overset{\rightarrow}{\mathbf{S}},\overset{\rightarrow}{\mathbf{R}},\mathbf{C}{}_{}^{}\mathbf{I}{}_{}^{}}} $。具體來說,$ {\textstyle \mathbf{U} = {\lbrack\mathbf{U}{}_{}^{}\ldots,\mathbf{U}{}_{}^{N\mathbf{U}}}} $ 表示用戶的畫像特徵 ($ {\textstyle \mathbf{U}^{i}} $),如年齡、性別等。每個特徵 $ {\textstyle \mathbf{U}^{i}} $ 都是標量,$ {\textstyle N_{\mathbf{U}}} $ 表示所使用特徵的數量。$ {\textstyle \overset{\rightarrow}{\mathbf{S}} = {\lbrack\mathbf{S}{}_{}^{}\ldots,\mathbf{S}{}_{}^{N\mathbf{S}}}} $ 包含用戶歷史交互過的物品序列。$ {\textstyle \mathbf{S}{}_{}^{}{\lbrack\mathbf{s}{}_{}^{}\ldots,\mathbf{s}{}_{}^{N\mathbf{s}}}} $ 中的每個元素表示一個物品,由所選特徵 ($ {\textstyle \mathbf{s}^{i}} $) 構成,如物品的 ID、tag、平均 CTR 等。類似 $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $,$ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ 記錄最接近當前請求的幾小時或一天內的交互。$ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ 表示用戶的實時行為與偏好。它與 $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ 共享相同的特徵。$ {\textstyle \mathbf{C} = {\lbrack\mathbf{C}{}_{}^{}\ldots,\mathbf{C}{}_{}^{N\mathbf{C}}}} $ 包含用戶與候選之間的 cross feature。$ {\textstyle \mathbf{I} = {\lbrack\mathbf{I}{}_{}^{}\ldots,\mathbf{I}{}_{}^{N\mathbf{I}}}} $ 包含候選所使用的特徵,如物品 ID、tag 和品牌。$ {\textstyle \mathbf{I}} $ 依賴於候選,且對不同用戶共享。

3.2. 推薦系統中的排序模型

對於輸入樣本 $ {\textstyle \mathbb{D}} $,傳統推薦系統對樣本逐一獨立處理。具體地,它首先對 $ {\textstyle \mathbb{D}} $ 中的特徵進行嵌入,並將樣本轉換為稠密表示。形式上,$ {\textstyle \mathbf{U}} $、$ {\textstyle \mathbf{C}} $、$ {\textstyle \mathbf{I}} $ 中的特徵分別被嵌入並拼接為 $ {\textstyle {\mathbf{E}\mathbf{m}\mathbf{b}}{}_{}^{}{\mathbb{R}}^{K \times d_{\mathbf{U}}}} $、$ {\textstyle {\mathbf{E}\mathbf{m}\mathbf{b}}{}_{}^{}{\mathbb{R}}^{K \times d_{\mathbf{C}}}} $ 與 $ {\textstyle {\mathbf{E}\mathbf{m}\mathbf{b}}{}_{}^{}{\mathbb{R}}^{K \times d_{\mathbf{I}}}} $。對於 $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ 與 $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ 中的特徵 222在下文描述中,由於 $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ 與 $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ 處理方式類似,為清晰起見僅描述 $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ 的建模。,每個 item ($ {\textstyle \mathbf{S}^{i}} $) 的特徵類似地被嵌入並拼接為 $ {\textstyle {\mathbf{E}\mathbf{m}\mathbf{b}}_{\mathbf{S}^{i}} \in {\mathbb{R}}^{d_{\mathbf{s}}}} $,$ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ 中的 item 沿另一維度拼接,得到 $ {\textstyle {\mathbf{E}\mathbf{m}\mathbf{b}}_{\overset{\rightarrow}{\mathbf{S}}} \in {\mathbb{R}}^{N_{\overset{\rightarrow}{\mathbf{S}}} \times d_{\mathbf{s}}}} $ 333$ {\textstyle N_{\ast}} $ 表示 $ {\textstyle \ast} $ 的序列長度。

為了在歷史交互物品與候選之間提取用戶興趣,通常使用 target attention,以 target 作為 query,以序列特徵作為 key/value。形式上,

| (1) | $ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{\left. \mathbf{S}\rightarrow \right.}^{}\text{Attention}{({\mathbf{E}\mathbf{m}\mathbf{b}}{}_{}^{}{\mathbf{E}\mathbf{m}\mathbf{b}}_{\overset{\rightarrow}{\mathbf{S}}},{\mathbf{E}\mathbf{m}\mathbf{b}}_{\overset{\rightarrow}{\mathbf{S}}})} \in {\mathbb{R}}^{K \times d_{\mathbf{S}}}} $ |

式 1 根據 $ {\textstyle \mathbf{I}} $ 對 $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ 進行匯聚。最後,從 $ {\textstyle \mathbb{D}} $ 中嵌入並處理過的特徵被拼接並表示為:

| (2) | $ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{}^{}{\lbrack{\mathbf{E}\mathbf{m}\mathbf{b}}{}_{}^{}{\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{\left. \mathbf{S}\rightarrow \right.}^{}{\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{\left. \mathbf{R}\rightarrow \right.}^{}{\mathbf{E}\mathbf{m}\mathbf{b}}{}_{}^{}{\mathbf{E}\mathbf{m}\mathbf{b}}_{\mathbf{s}}\rbrack} \in {\mathbb{R}}^{K \times {({d_{\mathbf{U}} + d_{\mathbf{S}} + d_{\mathbf{C}} + d_{\mathbf{I}}})}}} $ |

$ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}_{\mathbb{D}}} $ 進一步送入多層感知機(MLP),為每個樣本輸出一個 logit。該 logit 在訓練時用於學習,在推理時用於排序。

圖 1 展示了傳統排序模型下簡化的數據組織與工作流程。這些特徵首先被嵌入,前部的嵌入按不同方法處理。最後,處理後的特徵被拼接並由 MLP 處理以進行特徵交互。最終為每個候選生成 logit。

3.3. 推薦系統中的擴展困境

模型擴展一直是排序性能提升的常用方法。通常,模型擴展的目標是擴大 user module 與 cross module 中的參數。user module 處理包括序列特徵在內的用戶特徵,並生成依賴於用戶的表徵。擴展 user module 能為用戶帶來更好的表徵。此外,由於用戶對所有候選共享並只推理一次,user module 中較大的推理成本不會造成系統過載。然而,僅擴展 user module 並不能直接促進用戶與物品之間的特徵交互。

相反,另一類方法旨在擴展 cross module,即特徵拼接後的特徵交互 MLP。這類方法通過更多關注用戶與候選之間的交互來增強排序能力。然而,由於 cross module 對每個候選都要推理,計算量隨候選數量線性增長。擴展 cross module 會帶來不可接受的系統延遲。

傳統推薦系統中的擴展困境呼喚一種新的擴展方法:在用戶與候選之間實現高效的特徵交互,同時使推理成本隨候選數次線性增長。MTGR 通過數據重組和相應的架構優化,革新了推薦系統中的擴展方式。

4. MTGR 的數據重組與架構

4.1. 面向訓練與推理效率的用戶級樣本聚合

與 3.1 節中的特徵分類相比,對於候選中的第 $ {\textstyle i} $ 個樣本,MTGR 將特徵組織為 $ {\textstyle {\mathbb{D}}_{i} = {\lbrack\mathbf{U},\overset{\rightarrow}{\mathbf{S}},\overset{\rightarrow}{\mathbf{R}},{\lbrack\mathbf{C}{}_{}^{}\mathbf{I}{}_{}^{}}\rbrack}} $。特別地,cross feature $ {\textstyle \mathbf{C}} $ 被作為候選物品特徵的一部分進行排列。在 MTGR 中,訓練時按用戶在指定窗口內聚合候選,推理時按請求聚合。由於聚合針對的是同一個用戶,聚合樣本可以使用相同的用戶表徵 ($ {\textstyle \mathbf{U}} $, $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $, $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $)。特別地,$ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ 按交互時間的時間順序排列用戶在另一指定窗口內的所有實時交互物品。

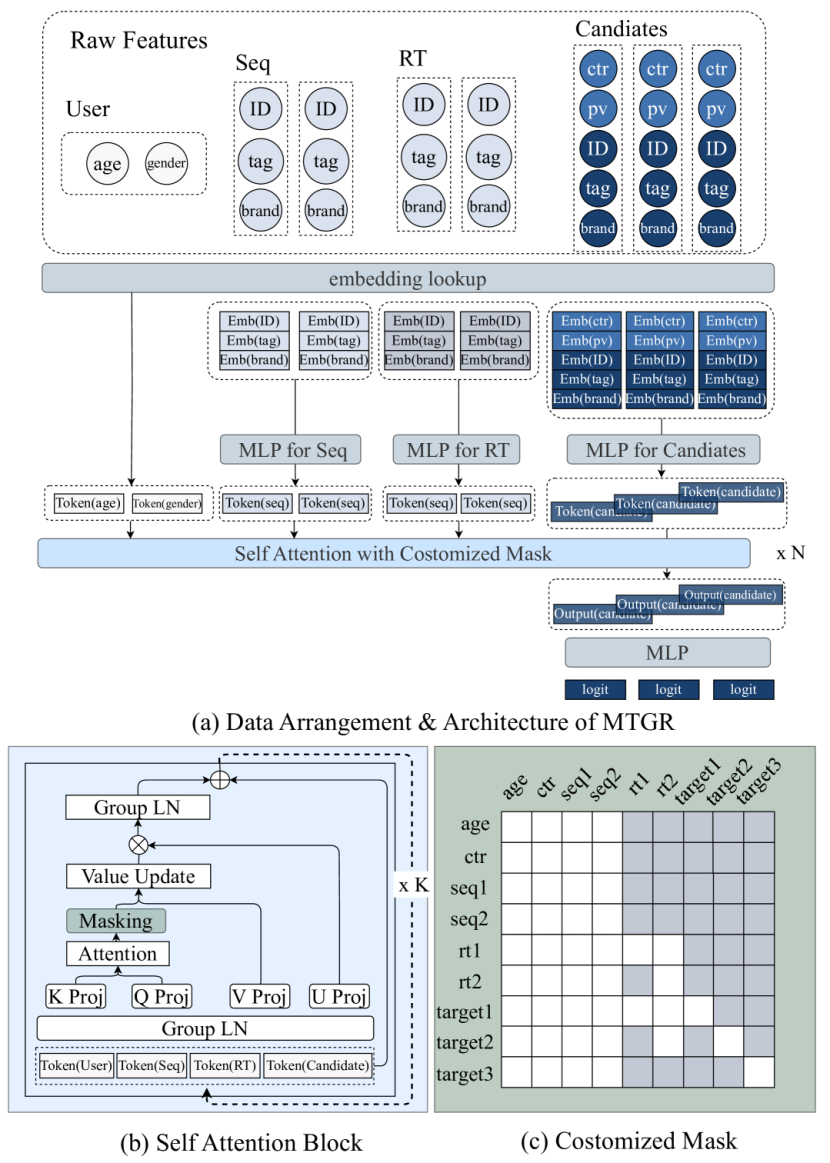

圖 2(a) 展示了聚合:與圖 1 中只預測一個候選不同,圖 2(a) 將三個物品聚合到一個樣本中,復用同一用戶表徵。形式上,它為同一用戶構建特徵表示:

| (3) | $ {\textstyle {\mathbb{D}} = {\lbrack\mathbf{U},\overset{\rightarrow}{\mathbf{S}},\overset{\rightarrow}{\mathbf{R}},{\lbrack\mathbf{C},\mathbf{I}\rbrack}_{1},\ldots,{\lbrack\mathbf{C},\mathbf{I}\rbrack}_{K}\rbrack}} $ |

通過將候選聚合到一個樣本中,MTGR 僅執行一次計算即可為所有候選生成分數,從而極大地節省資源。具體地,用戶級聚合將訓練樣本量從候選量級降到用戶量級。對於推理,請求中的候選按上述方式分組,MTGR 僅對所有候選排序進行一次推理,而非按候選數量分別推理。聚合避免了推理成本對候選數量的依賴,為模型擴展留下了空間和潛力。

式 3 是標量特徵與序列特徵的組合。為了統一輸入格式,MTGR 將特徵與序列轉換為 token。具體地,對於 $ {\textstyle \mathbf{U}} $ 中的標量特徵,每個特徵自然對應一個維度為 $ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{}^{}{\mathbb{R}}^{N_{\mathbf{U}} \times d_{\text{model}}}} $ 的獨立 token。$ {\textstyle d_{\text{model}}} $ 是為所有 token 設置的統一維度。對於 $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ 與 $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ 的序列特徵,每個 item $ {\textstyle \mathbf{S}} $ 視為一個 token。$ {\textstyle \mathbf{S}} $ 中的特徵首先被嵌入並拼接,然後通過一個 MLP 模塊進行維度統一。形式上,$ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{\mathbf{S}_{i}}^{}\text{MLP}{(\text{Concat}{({\mathbf{E}\mathbf{m}\mathbf{b}}{}_{}^{}})} \in {\mathbb{R}}^{d_{\text{model}}}} $。序列中 $ {\textstyle \mathbf{S}} $ 的特徵沿另一維度拼接,得到 $ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{\left. \mathbf{S}\rightarrow \right.}^{}{\mathbb{R}}^{N_{\overset{\rightarrow}{\mathbf{S}}} \times d_{\text{model}}}} $。

類似地,候選中的每個 item $ {\textstyle \mathbf{I}} $ 也視為一個 token。候選中的特徵被嵌入並拼接,並通過另一個 MLP 轉換到統一維度。候選拼接成一系列 token:$ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{}^{}\text{Concat}{(\text{MLP}{(\text{Concat}{({\mathbf{E}\mathbf{m}\mathbf{b}}{}_{\mathbf{C}_{i}}^{}{\mathbf{E}\mathbf{m}\mathbf{b}}{}_{\mathbf{I}_{i}}^{}})})} \in {\mathbb{R}}^{N_{\mathbf{I}}}} $。最後,由 $ {\textstyle \mathbf{U}} $、$ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $、$ {\textstyle \lbrack\mathbf{C},\mathbf{s}\rbrack} $ 構造的 token 被拼接,形成一條較長的 token 序列:

| $ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}_{\mathbb{D}}} $ | $ {\textstyle =} $ | $ {\textstyle \text{Concat}{({\lbrack{\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{}^{}{\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{\left. \mathbf{S}\rightarrow \right.}^{}{\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{\left. \mathbf{R}\rightarrow \right.}^{}{\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{}^{}})}} $ | ||

| $ {\textstyle \in} $ | $ {\textstyle {\mathbb{R}}^{{({N_{\mathbf{U}} + N_{\overset{\rightarrow}{\mathbf{S}}} + N_{\overset{\rightarrow}{\mathbf{R}}} + N_{\mathbf{I}}})} \times d_{\text{model}}}} $ |

4.2. 統一的 HSTU 編碼器

來自一個用戶的樣本被聚合為一段 token 序列,天然適合用 self-attention 處理。受 HSTU (Zhai et al., 2024) 啟發,MTGR 採用堆疊的 self-attention 層和 encoder-only 架構進行建模。

與 LLM 類似,輸入 token 序列按層處理。如圖 2 所示,在 self-attention 塊中,輸入序列 $ {\textstyle \mathbf{X}} $ 首先經 group layer norm 歸一化。同一域(例如 $ {\textstyle \mathbf{U}} $)的特徵構成一個組。group layer norm 確保不同域的 token 在 self-attention 前共享相似分佈,並對齊不同域的語義空間 $ {\textstyle \overset{\sim}{X} = {\text{GroupLN}\hspace{0pt}{(\mathbf{X})}}} $。歸一化後的輸入再被投影到 4 種不同表示:$ {\textstyle {\mathbf{K},\mathbf{Q},\mathbf{V},\mathbf{U}} = {\text{MLP}_{\mathbf{K}/\mathbf{Q}/\mathbf{V}/\mathbf{U}}\hspace{0pt}{(\overset{\sim}{\mathbf{X}})}}} $。$ {\textstyle \mathbf{Q}} $、$ {\textstyle \mathbf{K}} $ 用於帶 silu 非線性激活的 multi-head attention 計算。所得 attention 以輸入特徵的總長度作為平均因子進行除法。接着,對 attention score 施加自定義 mask ($ {\textstyle \mathbf{M}} $),並使用投影后的 $ {\textstyle \mathbf{V}} $ 進行 value 更新:

| (5) | $ {\textstyle \overset{\sim}{\mathbf{V}}} $ | $ {\textstyle =} $ | $ {\textstyle \frac{\text{silu}\hspace{0pt}{({\mathbf{K}^{T}\hspace{0pt}\mathbf{Q}})}}{({N_{\mathbf{U}} + N_{\overset{\rightarrow}{\mathbf{S}}} + N_{\overset{\rightarrow}{\mathbf{R}}} + N_{\mathbf{I}}})}\hspace{0pt}{\mathbf{M}\mathbf{V}}} $ |

投影得到的 $ {\textstyle \mathbf{U}} $ 與更新後的 $ {\textstyle \overset{\sim}{\mathbf{V}}} $ 進行逐元素相乘。隨後再應用一次 group layer norm。最後,我們添加殘差模塊,並在其上再疊加一個 MLP:

| (6) | $ {\textstyle \mathbf{X}} $ | $ {\textstyle =} $ | $ {\textstyle {\text{MLP}\hspace{0pt}{({\text{GroupLN}\hspace{0pt}{({\overset{\sim}{\mathbf{V}} \odot \mathbf{U}})}})}} + \mathbf{X}} $ |

Dynamic Masking (Zhai et al., 2024) 使用 causal mask 進行序列建模。然而,這種實現並不能為 MTGR 帶來顯著提升。此外,由於 $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ 記錄用戶最近的交互,其時間可能與樣本聚合窗口重疊。在 MTGR 中使用簡單的 causal mask 可能導致信息泄露。例如,晚上的交互不應暴露給下午的候選,但這些信息可能被聚合到同一樣本中。這一困境要求一種靈活且高效的 masking 方案。

在 MTGR 中,$ {\textstyle \mathbf{U}} $、$ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ 被視為靜態的(下文將 $ {\textstyle \mathbf{U}} $、$ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ 稱為「靜態序列」),因為其信息來自聚合窗口之前,因此不會引起因果性錯誤。$ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ 則是動態的,因為它實時地逐步納入用戶的交互(相對於 $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ 稱為「動態序列」)。MTGR 對靜態序列採用 full attention,對 $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ 採用帶 dynamic masking 的自回歸,對候選間採用對角 masking。具體地,MTGR 的 masking 設定 3 條規則:

•

靜態序列對所有 token 可見。

•

動態序列的可見性遵循因果性,每個 token 僅對其後出現的 token 可見,這包括候選 token。

•

候選 token ($ {\textstyle \mathbf{C}} $, $ {\textstyle \mathbf{I}} $) 僅對自身可見。

圖 2 (c) 展示了 dynamic masking 的一個例子:『age’、『ctr』 表示來自 $ {\textstyle \mathbf{U}} $ 的特徵 token;『seq1』、『seq2』 表示 $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $;『rt1』、『rt2』 表示 $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $,『target1』 - 『target3』 表示候選。行中的白塊表示該 token 可以使用其他 token 的信息,列則表示該 token 是否對其他 token 可見。$ {\textstyle \mathbf{U}} $ 與 $ {\textstyle \mathbf{S}} $ 之間使用 full attention,從 『age’ 到 『seq2』 形成一個白色方塊。對於 『rt1』 與 『rt2』,我們假定 『rt1』 出現晚於 『rt2』,因此從 『rt1』 到 『rt2』 構成一個小方塊,其上三角為白色,意味着 『rt1』 可以使用 『rt2』 的信息,但 『rt1』 對 『rt2』 不可見。此外,假定 『target2』 與 『target3』 出現早於 『rt1』,因此 『rt1』 對它們不可見。『rt2』 出現早於所有 『target1』 與 『target2』,晚於 『target3』,因此 『rt2』 對 『target3』 不可見,而 『target3』 出現早於所有 『rt』,因此無法使用 『rt』 的信息。

5. 訓練系統

為便於 MTGR 模型結構的設計與開發,並方便地引入快速發展的 LLM 社區中的更多特性,我們決定不再沿用之前基於 TensorFlow 的訓練框架,而是選擇在 PyTorch 生態中重建訓練框架。具體地,我們擴展並優化了 TorchRec 的功能,針對 MTGR 模型特性做了專門增強,最終實現了 MTGR 模型的高效訓練。相比 TorchRec,我們的優化框架將訓練吞吐提升 1.6x – 2.4x,並在超過 100 張 GPU 上仍具良好擴展性。相比 DLRM 基線,我們在前向計算上每樣本達到 65x FLOPs,而訓練成本基本不變。下面給出我們的部分關鍵工作。

Dynamic Hash Table。TorchRec 使用固定大小的表來處理 sparse embedding,這不適合大規模工業流式訓練場景。首先,一旦靜態表達到其預設容量,就無法實時為新用戶和新物品分配額外的 embedding。在此情況下,雖然可以使用默認 embedding 或採用某些 eviction 策略淘汰「舊」的 ID,但模型精度會下降。其次,靜態表通常需要預分配超過實際需求的容量以防止 ID 溢出,不可避免地導致內存利用低效。為應對這些挑戰,我們實現了基於哈希的高性能 embedding table,在訓練過程中為 sparse ID 動態分配空間。我們對 hash table 採用解耦架構,將 key 與 value 的存儲分離到不同結構中。key 結構維護一個輕量的映射表,包含 key 與對應的 embedding 向量指針;value 結構則同時存儲 embedding 向量以及 eviction 策略所需的輔助元數據(如計數器和時間戳)。這種雙結構設計達成兩個關鍵目標:(1) 通過僅複製緊湊的 key 結構而非龐大的 embedding 數據來支持容量的動態擴展;(2) 通過緊湊的內存佈局存儲 key 來優化 key 掃描效率,同時容納可能稀疏的 key 分佈。

Embedding Lookup。embedding lookup 過程採用 All-to-all 通信進行跨設備 embedding 交換。我們採用兩階段 ID 去重操作,在 ID 通信前後減少冗餘 ID,從而避免設備間重複傳輸 embedding。我們還設計了一個特徵配置接口以實現自動 table 合併,這可以減少 embedding lookup 算子的數量,從而加速整個過程。

Load balance。在推薦系統中,用戶行為序列通常呈長尾分佈——只有少數用戶的序列較長,而大多數用戶的序列較短。在使用固定 batch size(縮寫為 BS)訓練時,這會帶來顯著的計算負載不均。常見的解決方案是採用 sequence packing 技術 (Krell et al., 2021),將多條短序列合併為一條較長序列。然而,這種方法需要仔細調整 mask 以防止不同序列在 attention 計算時相互干擾,實現成本較高。我們直接的做法是引入動態 BS。每張 GPU 的本地 BS 根據輸入數據的實際序列長度調整,以保證計算負載相近。此外,我們還調整了梯度聚合策略,按各 GPU 的 BS 對其梯度加權,從而在計算邏輯上與固定 BS 保持一致。

Other Optimizations。為進一步提升訓練效率,我們通過 pipeline 技術使用三個 stream 最大化並行度:copy、dispatch 與 compute。具體地,copy stream 將輸入數據從 CPU 加載到 GPU,dispatch stream 按 ID 進行 table lookup,compute stream 負責前向計算與反向更新。例如,當 compute stream 執行 batch $ {\textstyle \mathbf{T}} $ 的前向與反向時,copy stream 同時加載 batch $ {\textstyle \mathbf{T} + 1} $ 以掩蓋 I/O 延遲。完成 batch $ {\textstyle \mathbf{T}} $ 的反向更新後,dispatch stream 立即開始 batch $ {\textstyle \mathbf{T} + 1} $ 的 table lookup 與通信。此外,我們採用 bf16 混合精度訓練,並開發了一個精心設計的、類似 FlashAttention 的基於 cutlass 的 attention kernel,以加速訓練過程。

6. 實驗

6.1. 實驗設置

Datasets。公開數據集通常使用獨立的 ID 與屬性特徵,很少引入 cross feature。然而 cross feature 在真實應用中至關重要。在我們的場景中,cross feature 是一類重要特徵,通常經過精心人工構造,包含諸如用戶-物品、用戶與高層類別、物品與時空信息等交互。為彌補公開數據集中 cross feature 的缺失,我們基於美團真實工業級推薦系統的日誌構造了訓練數據集。與公開數據集不同,我們的真實數據集包含更豐富的 cross feature 集合和更長的用戶行為序列。此外,數據集體量較大,能讓複雜模型在訓練中更充分地收斂。對於線下實驗,我們收集 $ {\textstyle 10} $ 天的數據。數據集統計如表 1 所示。對於線上實驗,為了與訓練超過 $ {\textstyle 2} $ 年的 DLRM 基線對比,我們構造了周期更長的實驗數據集,覆蓋超過 $ {\textstyle 6} $ 個月的數據。

| Dataset | #Users | #Items | #Exposure | #Click | #Purchases |

|---|---|---|---|---|---|

| Train | 0.21 billion | 4,302,391 | 23.74 billion | 1.08 billion | 0.18 billion |

| Test | 3,021,198 | 3,141,997 | 76,855,608 | 4,545,386 | 769,534 |

Baseline。對於 DLRM,我們在序列建模上對比兩種方法:基於序列檢索的 SIM 與對原始長序列做端到端建模的 End2End(E2E)。在擴展方面,我們對比 DNN、MoE (Ma et al., 2018)、Wukong (Zhang et al., 2024b)、MultiEmbed (Guo et al., 2023) 與 UserTower。

MoE 使用 $ {\textstyle 4} $ 個 expert,每個 expert 包含與基礎 DNN 同等複雜度的網絡。Wukong 與 MultiEmbed 配置為與 MoE 同等的計算複雜度。UserTower 使用一組可學習的 query,並在用戶行為之上插入一層 qFormer (Li et al., 2023) 與另一個 MoE(16 個 expert)模塊。UserTower 的計算複雜度是 MoE 方法的三倍,但在推理時可以為同一用戶的多個待預測物品共享該計算,從而降低推理成本。它在我們的場景中取得了良好效果。

MTGR 採用 E2E 處理全部序列信息。此外,如表 2 所示,我們設置了三種不同規模以驗證 MTGR 的可擴展性。

| Model | Setting | Learning rate | GFLOPs/example |

|---|---|---|---|

| UserTower-SIM | - | $ {\textstyle 8 \times 10^{- 4}} $ | 0.86 |

| MTGR-small | $ {\textstyle n_{\text{layer}} = 3} $, $ {\textstyle d_{\text{model}} = 512} $, $ {\textstyle n_{\text{heads}} = 2} $ | $ {\textstyle 3 \times 10^{- 4}} $ | 5.47 |

| MTGR-medium | $ {\textstyle n_{\text{layer}} = 5} $, $ {\textstyle d_{\text{model}} = 768} $, $ {\textstyle n_{\text{heads}} = 3} $ | $ {\textstyle 3 \times 10^{- 4}} $ | 18.59 |

| MTGR-large | $ {\textstyle n_{\text{layer}} = 15} $, $ {\textstyle d_{\text{model}} = 768} $, $ {\textstyle n_{\text{heads}} = 3} $ | $ {\textstyle 1 \times 10^{- 4}} $ | 55.76 |

Evaluation Metrics。線下我們關注兩項任務的學習:CTR 與 CTCVR(Click-Through Conversion Rate),並使用 AUC (Ferri et al., 2011) 與 GAUC(Group AUC)進行評估。GAUC 是按用戶求 AUC 後取平均。相比 AUC,GAUC 更關注模型對同一用戶的排序能力。在線上評估中,我們關注兩項指標:PV_CTR(按 page view 的 CTR)與 UV_CTCVR(按 user view 的 CTCVR),其中 UV_CTCVR 是衡量業務增長最關鍵的指標。

Parameter Setting。我們的模型使用 Adam 優化器訓練。對於 DLRM,每張 GPU 處理 2400 的 batch size,使用 8 張 NVIDIA A100 GPU 訓練。對於 MTGR,batch size 設為 96,使用 16 張 NVIDIA A100 GPU 訓練。如表 2 所示,learning rate 隨模型複雜度的增加而減小。此外,隨着模型規模增長,我們按比例增加 sparse 參數的規模。假設一個 token 由 $ {\textstyle k} $ 個特徵組成,每個特徵的 embedding 維度通常取接近 $ {\textstyle d_{\text{model}}/k} $ 的整數。最後,$ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ 的最大長度設為 $ {\textstyle 1000} $,$ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ 設為 $ {\textstyle 100} $。

6.2. 總體性能對比

我們使用 10 天的數據集評估 MTGR 與其他基線方法的性能。表 3 展示了不同模型的性能。各模型在不同線下指標上的差異相當一致。根據以往經驗,線下指標上 $ {\textstyle 0.001} $ 的提升即被視為顯著。在 DLRM 的各個版本中,Wukong-SIM 與 MultiEmbed-SIM 的結果優於 MoE-SIM。UserTower-SIM 表現最佳,而 UserTower-E2E 相比 UserTower-SIM 性能略有下降。我們推測在 DLRM 範式下,模型複雜度不足以建模全部序列信息,導致欠擬合。我們提出的 MTGR,即使是最小的版本,也超過最強的 DLRM 模型。此外,三種不同規模的模型展現出可擴展性,隨着模型複雜度提高,性能平滑提升。

| Model | CTR | CTCVR | ||

|---|---|---|---|---|

| AUC | GAUC | AUC | GAUC | |

| DNN-SIM | 0.7432 | 0.6679 | 0.8737 | 0.6504 |

| MoE-SIM | 0.7484 | 0.6698 | 0.8750 | 0.6519 |

| MultiEmbed-SIM | 0.7501 | 0.6715 | 0.8766 | 0.6525 |

| Wukong-SIM | 0.7568 | 0.6759 | 0.8800 | 0.6530 |

| UserTower-SIM | 0.7593 | 0.6792 | 0.8815 | 0.6550 |

| UserTower-E2E | 0.7576 | 0.6787 | 0.8818 | 0.6548 |

| MTGR-small | 0.7631 | 0.6826 | 0.8840 | 0.6603 |

| MTGR-medium | 0.7645 | 0.6843 | 0.8849 | 0.6625 |

| MTGR-large | 0.7661 | 0.6865 | 0.8862 | 0.6646 |

| Impr.% | 0.8956 | 1.0748 | 0.4990 | 1.4656 |

| Model | CTR | CTCVR | ||

|---|---|---|---|---|

| AUC | GAUC | AUC | GAUC | |

| MTGR-small | 0.7631 | 0.6826 | 0.8840 | 0.6603 |

| w/o cross features | 0.7495 | 0.6689 | 0.8736 | 0.6514 |

| w/o GLN | 0.7606 | 0.6809 | 0.8826 | 0.6585 |

| w/o dynamic mask | 0.7620 | 0.6810 | 0.8828 | 0.6587 |

6.3. 消融研究

我們基於 small 版本對 MTGR 的兩個組件——Dynamic Masking 與 group layer norm(GLN)——進行消融研究。消融結果如圖 4 所示。從 MTGR 中移除任一組件都會導致性能顯著下降,下降幅度可比 MTGR-small 到 MTGR-medium 的提升。這表明 Dynamic Masking 與 GLN 對 MTGR 的重要性。此外,我們對 cross feature 對 MTGR 的重要性做了額外實驗。移除 cross feature 後,性能指標顯著下降,甚至抹去 MTGR-large 相對 DLRM 的全部增益,凸顯了 cross feature 在真實推薦系統中的關鍵作用。

6.4. 可擴展性

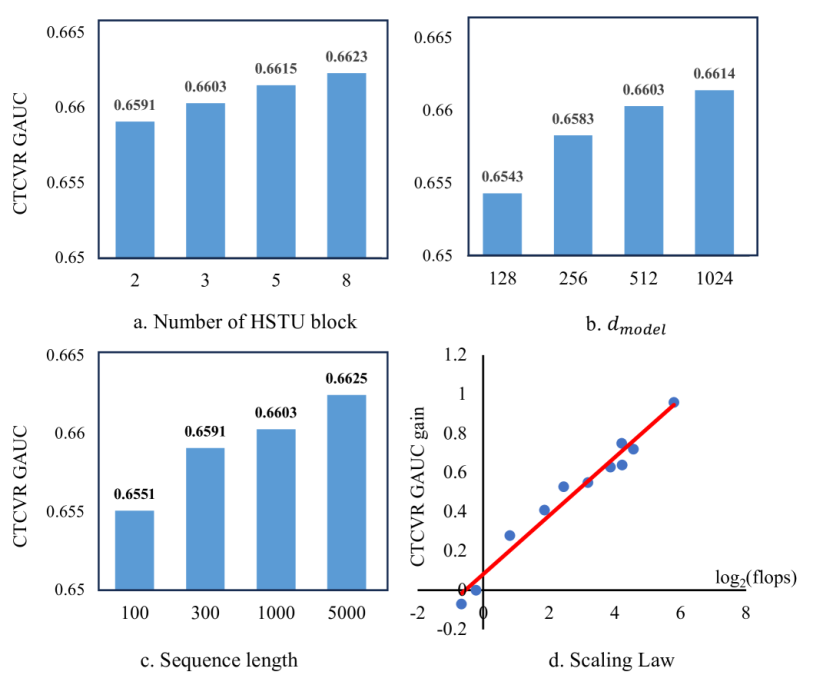

圖 3 展示了我們 MTGR 的可擴展性。我們基於 MTGR-small 對三種不同超參數進行測試:HSTU 塊數量、$ {\textstyle d_{\text{model}}} $ 與輸入序列長度。可以看到,MTGR 在不同超參數下都展現出良好的可擴展性。此外,圖 3(d) 展示了性能與計算複雜度之間的冪律關係。縱軸表示相對於最佳 DLRM 模型 UserTower-SIM 在 CTCVR GAUC 指標上的提升,橫軸表示相對 UserTower-SIM 的計算複雜度的對數倍數。

6.5. 線上實驗

為進一步驗證 MTGR 的有效性,我們在美團外賣平台部署 MTGR,使用 $ {\textstyle 2\%} $ 的流量進行 AB 測試。實驗流量每日覆蓋數百萬次曝光,保證了實驗的置信度。對比基線是線上最先進的 DLRM 模型(UserTower-SIM),它已連續學習 $ {\textstyle 2} $ 年。我們使用最近 $ {\textstyle 6} $ 個月的數據訓練 MTGR 模型,並將其部署上線進行對比。

儘管訓練數據量顯著少於 DLRM 模型,線下和線上指標仍大幅超過 DLRM 基線。如表 5 所示,線下與線上指標均展現出可擴展性。我們還發現,隨着訓練 token 數量的增加,相對 DLRM 的收益不斷放大。最終在 CTCVR GAUC 上,我們的 large 版本甚至超過過去一年所有優化的累計提升。

該模型已在我們的場景中全量部署,訓練成本與 DLRM 相同,推理成本降低 $ {\textstyle 12\%} $。對於 DLRM,其推理成本與候選數量近似線性。然而,MTGR 對一次請求中的所有候選採用 user aggregation,使推理成本隨候選數量呈次線性擴展。這有助於我們降低線上推理的開銷。

| Offline Metric diff | Online Metric diff | |||

|---|---|---|---|---|

| CTR GAUC | CTCVR GAUC | PV_CTR | UV_CTCVR | |

| MTGR-small | +0.0036 | +0.0154 | +1.04% | +0.04% |

| MTGR-medium | +0.0071 | +0.0182 | +2.29% | +0.62% |

| MTGR-large | +0.0153 | +0.0288 | +1.90% | +1.02% |

7. 結論

本文提出了 MTGR,一種基於 HSTU 探索推薦系統中 scaling law 的全新排序框架。MTGR 結合了 DLRM 與 GRM 的優勢,允許使用 cross feature 以保證模型性能,同時具備與 GRM 同等的可擴展性。MTGR 已在我們的場景中部署,並帶來顯著收益。未來,我們將探索如何將 MTGR 擴展到多場景建模,類似於 large language model,以構建一個具備廣泛知識的推薦基礎模型。

參考文獻

- (1)

- Chen et al. (2021) Qiwei Chen, Changhua Pei, Shanshan Lv, Chao Li, Junfeng Ge, and Wenwu Ou. 2021. End-to-end user behavior retrieval in click-through rateprediction model. arXiv preprint arXiv:2108.04468 (2021).

- Dao et al. (2022) Tri Dao, Dan Fu, Stefano Ermon, Atri Rudra, and Christopher Ré. 2022. Flashattention: Fast and memory-efficient exact attention with io-awareness. Advances in neural information processing systems 35 (2022), 16344–16359.

- Deng et al. (2025) Jiaxin Deng, Shiyao Wang, Kuo Cai, Lejian Ren, Qigen Hu, Weifeng Ding, Qiang Luo, and Guorui Zhou. 2025. OneRec: Unifying Retrieve and Rank with Generative Recommender and Iterative Preference Alignment. arXiv preprint arXiv:2502.18965 (2025).

- Fang et al. (2024) Yan Fang, Jingtao Zhan, Qingyao Ai, Jiaxin Mao, Weihang Su, Jia Chen, and Yiqun Liu. 2024. Scaling laws for dense retrieval. In Proceedings of the 47th International ACM SIGIR Conference on Research and Development in Information Retrieval. 1339–1349.

- Ferri et al. (2011) Cesar Ferri, José Hernández-Orallo, and Peter A Flach. 2011. A coherent interpretation of AUC as a measure of aggregated classification performance. In Proceedings of the 28th International Conference on Machine Learning (ICML-11). 657–664.

- Guo et al. (2023) Xingzhuo Guo, Junwei Pan, Ximei Wang, Baixu Chen, Jie Jiang, and Mingsheng Long. 2023. On the embedding collapse when scaling up recommendation models. arXiv preprint arXiv:2310.04400 (2023).

- Han et al. (2024) Ruidong Han, Qianzhong Li, He Jiang, Rui Li, Yurou Zhao, Xiang Li, and Wei Lin. 2024. Enhancing CTR Prediction through Sequential Recommendation Pre-training: Introducing the SRP4CTR Framework. In Proceedings of the 33rd ACM International Conference on Information and Knowledge Management. 3777–3781.

- Ivchenko et al. (2022) Dmytro Ivchenko, Dennis Van Der Staay, Colin Taylor, Xing Liu, Will Feng, Rahul Kindi, Anirudh Sudarshan, and Shahin Sefati. 2022. Torchrec: a pytorch domain library for recommendation systems. In Proceedings of the 16th ACM Conference on Recommender Systems. 482–483.

- Kaplan et al. (2020) Jared Kaplan, Sam McCandlish, Tom Henighan, Tom B Brown, Benjamin Chess, Rewon Child, Scott Gray, Alec Radford, Jeffrey Wu, and Dario Amodei. 2020. Scaling laws for neural language models. arXiv preprint arXiv:2001.08361 (2020).

- Krell et al. (2021) Mario Michael Krell, Matej Kosec, Sergio P Perez, and Andrew Fitzgibbon. 2021. Efficient sequence packing without cross-contamination: Accelerating large language models without impacting performance. arXiv preprint arXiv:2107.02027 (2021).

- Li et al. (2023) Junnan Li, Dongxu Li, Silvio Savarese, and Steven Hoi. 2023. Blip-2: Bootstrapping language-image pre-training with frozen image encoders and large language models. In International conference on machine learning. PMLR, 19730–19742.

- Lian et al. (2018) Jianxun Lian, Xiaohuan Zhou, Fuzheng Zhang, Zhongxia Chen, Xing Xie, and Guangzhong Sun. 2018. xdeepfm: Combining explicit and implicit feature interactions for recommender systems. In Proceedings of the 24th ACM SIGKDD international conference on knowledge discovery & data mining. 1754–1763.

- Ma et al. (2018) Jiaqi Ma, Zhe Zhao, Xinyang Yi, Jilin Chen, Lichan Hong, and Ed H Chi. 2018. Modeling task relationships in multi-task learning with multi-gate mixture-of-experts. In Proceedings of the 24th ACM SIGKDD international conference on knowledge discovery & data mining. 1930–1939.

- Peebles and Xie (2023) William Peebles and Saining Xie. 2023. Scalable diffusion models with transformers. In Proceedings of the IEEE/CVF international conference on computer vision. 4195–4205.

- Pi et al. (2020) Qi Pi, Guorui Zhou, Yujing Zhang, Zhe Wang, Lejian Ren, Ying Fan, Xiaoqiang Zhu, and Kun Gai. 2020. Search-based user interest modeling with lifelong sequential behavior data for click-through rate prediction. In Proceedings of the 29th ACM International Conference on Information & Knowledge Management. 2685–2692.

- Shin et al. (2023) Kyuyong Shin, Hanock Kwak, Su Young Kim, Max Nihlén Ramström, Jisu Jeong, Jung-Woo Ha, and Kyung-Min Kim. 2023. Scaling law for recommendation models: Towards general-purpose user representations. In Proceedings of the AAAI conference on artificial intelligence, Vol. 37. 4596–4604.

- Si et al. (2024) Zihua Si, Lin Guan, ZhongXiang Sun, Xiaoxue Zang, Jing Lu, Yiqun Hui, Xingchao Cao, Zeyu Yang, Yichen Zheng, Dewei Leng, et al. 2024. Twin v2: Scaling ultra-long user behavior sequence modeling for enhanced ctr prediction at kuaishou. In Proceedings of the 33rd ACM International Conference on Information and Knowledge Management. 4890–4897.

- Tang et al. (2020) Hongyan Tang, Junning Liu, Ming Zhao, and Xudong Gong. 2020. Progressive layered extraction (ple): A novel multi-task learning (mtl) model for personalized recommendations. In Proceedings of the 14th ACM conference on recommender systems. 269–278.

- Wang et al. (2021) Ruoxi Wang, Rakesh Shivanna, Derek Cheng, Sagar Jain, Dong Lin, Lichan Hong, and Ed Chi. 2021. Dcn v2: Improved deep & cross network and practical lessons for web-scale learning to rank systems. In Proceedings of the web conference 2021. 1785–1797.

- Wang et al. (2024) Xu Wang, Jiangxia Cao, Zhiyi Fu, Kun Gai, and Guorui Zhou. 2024. HoME: Hierarchy of Multi-Gate Experts for Multi-Task Learning at Kuaishou. arXiv preprint arXiv:2408.05430 (2024).

- Yan et al. (2025) Bencheng Yan, Shilei Liu, Zhiyuan Zeng, Zihao Wang, Yizhen Zhang, Yujin Yuan, Langming Liu, Jiaqi Liu, Di Wang, Wenbo Su, et al. 2025. Unlocking Scaling Law in Industrial Recommendation Systems with a Three-step Paradigm based Large User Model. arXiv preprint arXiv:2502.08309 (2025).

- Zhai et al. (2024) Jiaqi Zhai, Lucy Liao, Xing Liu, Yueming Wang, Rui Li, Xuan Cao, Leon Gao, Zhaojie Gong, Fangda Gu, Michael He, et al. 2024. Actions speak louder than words: Trillion-parameter sequential transducers for generative recommendations. arXiv preprint arXiv:2402.17152 (2024).

- Zhai et al. (2022) Xiaohua Zhai, Alexander Kolesnikov, Neil Houlsby, and Lucas Beyer. 2022. Scaling vision transformers. In Proceedings of the IEEE/CVF conference on computer vision and pattern recognition. 12104–12113.

- Zhang et al. (2024b) Buyun Zhang, Liang Luo, Yuxin Chen, Jade Nie, Xi Liu, Daifeng Guo, Yanli Zhao, Shen Li, Yuchen Hao, Yantao Yao, et al. 2024b. Wukong: Towards a scaling law for large-scale recommendation. arXiv preprint arXiv:2403.02545 (2024).

- Zhang et al. (2024a) Wei Zhang, Dai Li, Chen Liang, Fang Zhou, Zhongke Zhang, Xuewei Wang, Ru Li, Yi Zhou, Yaning Huang, Dong Liang, et al. 2024a. Scaling User Modeling: Large-scale Online User Representations for Ads Personalization in Meta. In Companion Proceedings of the ACM Web Conference 2024. 47–55.

- Zhou et al. (2018) Guorui Zhou, Xiaoqiang Zhu, Chenru Song, Ying Fan, Han Zhu, Xiao Ma, Yanghui Yan, Junqi Jin, Han Li, and Kun Gai. 2018. Deep interest network for click-through rate prediction. In Proceedings of the 24th ACM SIGKDD international conference on knowledge discovery & data mining. 1059–1068.