MTGR: Industrial-Scale Generative Recommendation Framework in Meituan/paper/es

| Research Paper | |

|---|---|

| Authors | Ruidong Han; Bin Yin; Shangyu Chen; He Jiang; Fei Jiang; Xiang Li; Chi Ma; Mincong Huang; Xiaoguang Li; Chunzhen Jing; Yueming Han; Menglei Zhou; Lei Yu; Chuan Liu; Wei Lin |

| Year | 2025 |

| Topic area | NLP |

| Difficulty | Research |

| arXiv | 2505.18654 |

| Download PDF | |

MTGR: Industrial-Scale Generative Recommendation Framework in Meituan

Ruidong Han MeituanBeijingChina hanruidong@meituan.com , Bin Yin MeituanBeijingChina yinbin05@meituan.com , Shangyu Chen MeituanBeijingChina chenshangyu03@meituan.com , He Jiang MeituanBeijingChina jianghe06@meituan.com , Fei Jiang MeituanBeijingChina jiangfei05@meituan.com , Xiang Li MeituanBeijingChina lixiang245@meituan.com , Chi Ma MeituanBeijingChina machi04@meituan.com , Mincong Huang MeituanBeijingChina huangmincong@meituan.com , Xiaoguang Li MeituanBeijingChina lixiaoguang12@meituan.com , Chunzhen Jing MeituanBeijingChina jingchunzhen@meituan.com , Yueming Han MeituanBeijingChina hanyueming02@meituan.com , Menglei Zhou MeituanBeijingChina zhoumenglei@meituan.com , Lei Yu MeituanBeijingChina yulei37@meituan.com , Chuan Liu MeituanBeijingChina liuchuan11@meituan.com and Wei Lin MeituanBeijingChina linwei31@meituan.com

Resumen.

La scaling law ha sido validada extensamente en muchos dominios, como el procesamiento del lenguaje natural y la computer vision. En el sistema de recomendación, trabajos recientes han adoptado recomendaciones generativas para lograr escalabilidad, pero sus enfoques generativos requieren abandonar las cross features cuidadosamente construidas de los modelos de recomendación tradicionales. Encontramos que este enfoque degrada significativamente el rendimiento del modelo, y escalar no puede compensarlo en absoluto. En este artículo, proponemos MTGR (Meituan Generative Recommendation) para abordar este problema. MTGR realiza el modelado basado en la arquitectura HSTU (Zhai et al., 2024) y puede conservar las features originales del modelo de recomendación de deep learning (DLRM), incluidas las cross features. Además, MTGR logra aceleración del entrenamiento y la inferencia mediante compresión a nivel de usuario para asegurar un escalado eficiente. También proponemos Group-Layer Normalization (GLN) para mejorar el rendimiento de la codificación dentro de diferentes espacios semánticos y la estrategia de dynamic masking para evitar fugas de información. Optimizamos además los frameworks de entrenamiento, permitiendo soportar nuestros modelos con una complejidad computacional de 10 a 100 veces la del DLRM, sin aumentos de costo significativos. MTGR alcanzó $ {\textstyle 65} $x FLOPs para inferencia forward de muestra única en comparación con el modelo DLRM, resultando en la mayor ganancia en casi dos años tanto offline como online. Este avance fue desplegado exitosamente en Meituan, la mayor plataforma de food delivery del mundo, donde ha estado manejando el tráfico principal.

Scaling Law; Generative Recommendation ††ccs: Sistemas de información — Sistemas de recomendación

1. Introducción

Las scaling laws han demostrado aplicarse a la mayoría de las tareas de deep learning, incluidos modelos de lenguaje (Kaplan et al., 2020), computer vision (Zhai et al., 2022; Peebles y Xie, 2023) y recuperación de información (Fang et al., 2024). Bajo los requisitos de alto QPS (Queries Per Second) y baja latencia en sistemas de recomendación industriales, el escalado del modelo suele estar limitado tanto por el costo de entrenamiento como por el tiempo de inferencia. Actualmente, el estudio del escalado de modelos de ranking puede dividirse en dos tipos: Deep Learning Recommendation Model (DLRM) y Generative Recommendation Model (GRM). DLRM modela pares individuales usuario-ítem para aprender la probabilidad de interés para el ranking y escala desarrollando mappings más complejos. GRM organiza los datos por token, como el lenguaje natural, y realiza next token prediction mediante una arquitectura transformer.

En sistemas de recomendación industriales, DLRM se ha utilizado durante casi una década, típicamente con entradas que incluyen un gran número de features hechas a mano, como las cross features 111Las cross features miden las interacciones de múltiples features brutas, como el click-through rate histórico del usuario para el candidato objetivo, para mejorar el rendimiento del modelo. Sin embargo, DLRM tiene dos desventajas significativas a la hora de escalar: 1) con el crecimiento exponencial del comportamiento del usuario, el DLRM tradicional no puede procesar eficientemente todos los comportamientos del usuario, recurriendo a menudo a recuperación de secuencias o al diseño de módulos de baja complejidad para el aprendizaje, lo que limita la capacidad de aprendizaje del modelo (Pi et al., 2020; Chen et al., 2021). 2) escalar basado en DLRM incurre en costos aproximadamente lineales en entrenamiento e inferencia respecto al número de candidatos, haciendo que los gastos sean inasumibles.

En cuanto al GRM, estudios recientes han señalado su excelente escalabilidad (Zhai et al., 2024; Deng et al., 2025). Identificamos dos factores clave: 1) GRM modela directamente la cadena completa de comportamiento del usuario, lo que comprime múltiples muestras de exposición bajo el mismo usuario en una sola. Esto reduce significativamente la redundancia computacional, mientras permite codificar end-to-end secuencias más largas en comparación con DLRM; 2) GRM adopta una arquitectura transformer con cómputo de atención eficiente (Zhai et al., 2024; Dao et al., 2022), permitiendo que el entrenamiento e inferencia del modelo cumplan los requisitos de los sistemas de recomendación industriales. Sin embargo, GRM depende fuertemente de next token prediction para modelar una secuencia completa de comportamiento del usuario, lo que requiere eliminar las cross features entre candidatos y el usuario. Encontramos que excluir las cross features daña gravemente el rendimiento del modelo, y esta degeneración no puede compensarse en absoluto escalando.

¿Cómo podemos construir un modelo de ranking que utilice cross features para asegurar la efectividad mientras posee también la escalabilidad de GRM? Para abordar este problema, proponemos Meituan Generative Recommendation (MTGR). En comparación con los DLRM y GRM tradicionales, MTGR aprovecha las ventajas y descarta las desventajas de los métodos. MTGR mantiene features de entrada consistentes con el DLRM tradicional, incluidas las cross features. En particular, MTGR reorganiza features convirtiendo features de usuario y de candidato en distintos tokens, dando lugar a una secuencia de tokens para un escalado eficiente del modelo. Luego MTGR incorpora la cross feature en los tokens de candidato y aprende con una pérdida discriminativa.

MTGR emplea para el modelado una arquitectura HSTU (Hierarchical Sequential Transduction Units) similar a la utilizada en (Zhai et al., 2024). Dentro de HSTU proponemos Group-layer Normalization (GLN) para normalizar por separado distintos tipos de tokens, lo que permite un mejor modelado simultáneo de múltiples informaciones heterogéneas. Además, proponemos una estrategia de dynamic masking, donde se utilizan full-attention, autorregresivo y visibilidad solo a sí mismo para asegurar el rendimiento y evitar fugas de información.

A diferencia del TensorFlow comúnmente utilizado en la industria, el framework de entrenamiento de MTGR está construido sobre TorchRec (Ivchenko et al., 2022) y optimizado para eficiencia computacional. En particular, para manejar la inserción/eliminación en tiempo real de entradas de embedding sparse, empleamos dynamic hash tables para reemplazar a las tablas estáticas. Para mejorar la eficiencia, realizamos balanceo dinámico de secuencias para abordar los desequilibrios de carga de cómputo entre GPUs y adoptamos deduplicación de IDs de embedding junto con fusión automática de tablas para acelerar el embedding lookup. También incorporamos optimizaciones de implementación incluyendo entrenamiento en mixed precision y operator fusion. Comparado con TorchRec, nuestro framework optimizado mejora el throughput de entrenamiento en $ {\textstyle 1.6} $x – $ {\textstyle 2.4} $x y logra buena escalabilidad al ejecutarse sobre más de $ {\textstyle 100} $ GPUs.

Validamos la escalabilidad de MTGR en un dataset de pequeña escala. Luego, diseñamos tres modelos de tamaños variados, entrenados usando más de seis meses de datos, para verificar la scaling law tanto en rendimiento offline como online. La versión large, comparada con la línea base DLRM optimizada durante años, demuestra $ {\textstyle 65} $x FLOPs por muestra en cómputo forward y aumenta los volúmenes de conversión en $ {\textstyle 1.22\%} $ y el CTR (Click-Through Rate) en $ {\textstyle 1.31\%} $ en nuestros escenarios. Mientras tanto, el costo de entrenamiento permanece sin cambios y el costo de inferencia se reduce un 12%. MTGR-large ha sido desplegado en el sistema de recomendación take-away de Meituan, sirviendo a cientos de millones de usuarios.

En resumen, nuestras contribuciones se resumen como sigue:

•

MTGR combina las ventajas de DLRM y GRM, conservando todas las features de DLRM, incluida la cross feature, mientras demuestra una excelente escalabilidad como GRM.

•

Proponemos estrategias de Group-Layer Normalization y dynamic masking para lograr un mejor rendimiento.

•

Realizamos optimizaciones sistemáticas sobre el framework de entrenamiento de MTGR basado en TorchRec para mejorar el rendimiento del entrenamiento.

•

Se realizaron experimentos tanto offline como online para demostrar la relación de ley de potencia entre el rendimiento de MTGR y la complejidad computacional, y su superioridad en comparación con DLRM.

2. Trabajos relacionados

2.1. Modelo de recomendación con deep learning

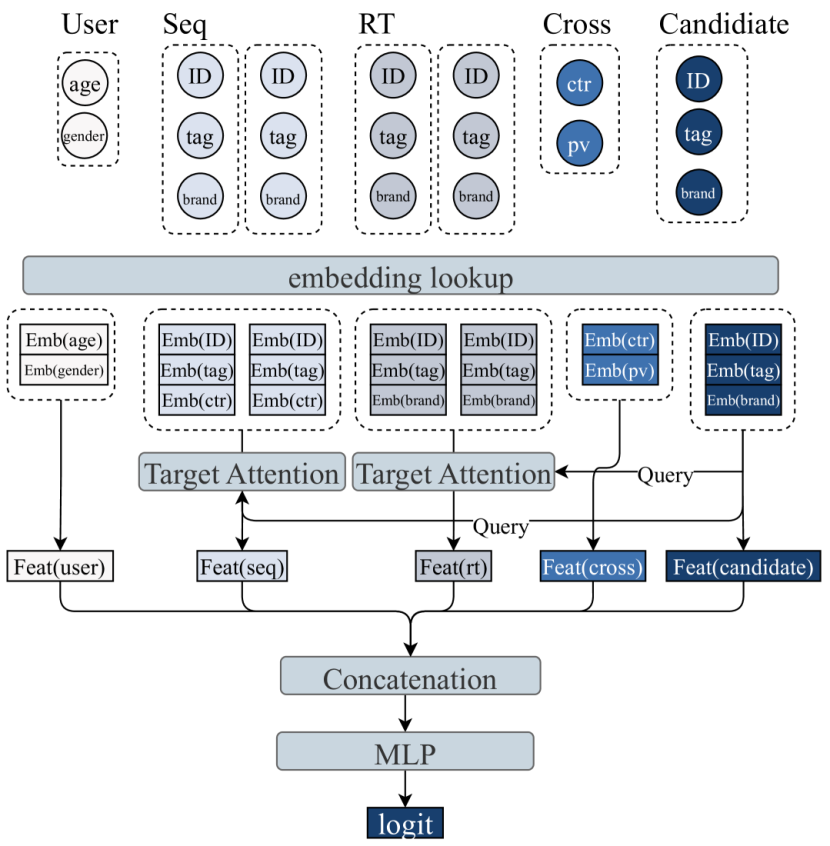

Una estructura DLRM clásica suele incluir muchas entradas como contexto (p. ej., tiempo, ubicación), perfil de usuario (p. ej., género, edad), secuencias de comportamiento del usuario y el ítem objetivo con muchas cross features. Dos módulos especialmente importantes en un modelo de ranking son el procesamiento de secuencias de comportamiento y el aprendizaje de feature interactions. El módulo de secuencia de comportamiento (Zhou et al., 2018; Pi et al., 2020; Si et al., 2024) suele emplear mecanismos de target attention para capturar la similitud entre el comportamiento histórico de los usuarios y el ítem a estimar. El módulo de feature interactions (Lian et al., 2018; Tang et al., 2020; Wang et al., 2021, 2024) está diseñado para capturar interacciones entre diferentes features, incluido usuario e ítem, para producir la predicción final.

2.2. Escalado de modelos de recomendación

Basándose en los diferentes módulos a escalar en DLRM, existen dos enfoques distintos. Uno es el escalado del cross module, es decir, escalar el módulo de feature interactions que integra información del usuario y del ítem. (Zhang et al., 2024b) introduce una capa apilable Wukong para escalar. (Guo et al., 2023) emplea una estrategia multi-embedding para abordar el embedding collapse, mejorando así la escalabilidad del modelo. El otro enfoque es el escalado del user module, donde solo se escala la parte del usuario, haciendo que este enfoque sea más amigable a la inferencia. (Zhang et al., 2024a; Han et al., 2024) reducen los costos de inferencia online escalando solo las representaciones de usuario y cacheándolas o difundiéndolas a los distintos ítems que se estimarán. (Shin et al., 2023; Yan et al., 2025) diseñan un método de pre-entrenamiento para representaciones de usuario, demostrando escalabilidad en tareas downstream.

La contraparte del DLRM es el GRM. (Zhai et al., 2024) valida la scaling law mediante HSTU escalando hasta parámetros del orden del billón. (Deng et al., 2025) usa codificación semántica para reemplazar las representaciones tradicionales basadas en ID, combinando optimización DPO con HSTU para reemplazar el framework de aprendizaje en cascada por un único modelo generativo unificado.

3. Preliminares

3.1. Disposición de los datos

Tradicionalmente, para un usuario y los $ {\textstyle K} $ candidatos correspondientes, la $ {\textstyle i} $-ésima muestra para el par usuario y $ {\textstyle i} $-ésimo candidato puede representarse como $ {\textstyle {\mathbb{D}}_{i} = {\lbrack\mathbf{U},\overset{\rightarrow}{\mathbf{S}},\overset{\rightarrow}{\mathbf{R}},\mathbf{C}{}_{}^{}\mathbf{I}{}_{}^{}}} $. Específicamente, $ {\textstyle \mathbf{U} = {\lbrack\mathbf{U}{}_{}^{}\ldots,\mathbf{U}{}_{}^{N\mathbf{U}}}} $ representa la feature de perfil del usuario ($ {\textstyle \mathbf{U}^{i}} $), tal como edad, género, etc. Cada feature $ {\textstyle \mathbf{U}^{i}} $ es un escalar, y $ {\textstyle N_{\mathbf{U}}} $ representa el número de features utilizadas. $ {\textstyle \overset{\rightarrow}{\mathbf{S}} = {\lbrack\mathbf{S}{}_{}^{}\ldots,\mathbf{S}{}_{}^{N\mathbf{S}}}} $ contiene la secuencia de ítems con los que el usuario ha interactuado históricamente. Cada elemento en $ {\textstyle \mathbf{S}{}_{}^{}{\lbrack\mathbf{s}{}_{}^{}\ldots,\mathbf{s}{}_{}^{N\mathbf{s}}}} $ representa un ítem, compuesto por features seleccionadas ($ {\textstyle \mathbf{s}^{i}} $) tales como ID del ítem, tag, CTR promedio sobre el ítem, etc. Similar a $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $, $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ registra las interacciones más cercanas a la solicitud actual dentro de unas pocas horas o un día. $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ representa las acciones y preferencias en tiempo real del usuario. Comparte las mismas features con $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $. $ {\textstyle \mathbf{C} = {\lbrack\mathbf{C}{}_{}^{}\ldots,\mathbf{C}{}_{}^{N\mathbf{C}}}} $ comprende las cross features entre el usuario y los candidatos. $ {\textstyle \mathbf{I} = {\lbrack\mathbf{I}{}_{}^{}\ldots,\mathbf{I}{}_{}^{N\mathbf{I}}}} $ contiene las features usadas para los candidatos, tales como ID del ítem, tag y marca. $ {\textstyle \mathbf{I}} $ depende del candidato y se comparte para diferentes usuarios.

3.2. Modelo de ranking en sistemas de recomendación

Con muestras de entrada $ {\textstyle \mathbb{D}} $, el sistema de recomendación tradicional procesa las muestras de forma independiente. En particular, primero embebe las features en $ {\textstyle \mathbb{D}} $ y convierte las muestras a una representación densa. Formalmente, las features en $ {\textstyle \mathbf{U}} $, $ {\textstyle \mathbf{C}} $, $ {\textstyle \mathbf{I}} $ son embebidas y concatenadas a $ {\textstyle {\mathbf{E}\mathbf{m}\mathbf{b}}{}_{}^{}{\mathbb{R}}^{K \times d_{\mathbf{U}}}} $, $ {\textstyle {\mathbf{E}\mathbf{m}\mathbf{b}}{}_{}^{}{\mathbb{R}}^{K \times d_{\mathbf{C}}}} $ y $ {\textstyle {\mathbf{E}\mathbf{m}\mathbf{b}}{}_{}^{}{\mathbb{R}}^{K \times d_{\mathbf{I}}}} $, respectivamente. Para las features en $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ y $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ 222En la siguiente descripción, dado que $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ y $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ se procesan de forma similar, solo se describe el modelado de $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ por claridad., las features de cada ítem ($ {\textstyle \mathbf{S}^{i}} $) son embebidas y concatenadas de forma similar a $ {\textstyle {\mathbf{E}\mathbf{m}\mathbf{b}}_{\mathbf{S}^{i}} \in {\mathbb{R}}^{d_{\mathbf{s}}}} $, los ítems en $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ se concatenan en otra dimensión, dando $ {\textstyle {\mathbf{E}\mathbf{m}\mathbf{b}}_{\overset{\rightarrow}{\mathbf{S}}} \in {\mathbb{R}}^{N_{\overset{\rightarrow}{\mathbf{S}}} \times d_{\mathbf{s}}}} $ 333$ {\textstyle N_{\ast}} $ representa la longitud de secuencia de $ {\textstyle \ast} $.

Para extraer el interés del usuario entre los ítems históricamente interactuados y los candidatos, normalmente se utiliza target attention con el target como query y la feature de secuencia como key/value. Formalmente,

| (1) | $ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{\left. \mathbf{S}\rightarrow \right.}^{}\text{Attention}{({\mathbf{E}\mathbf{m}\mathbf{b}}{}_{}^{}{\mathbf{E}\mathbf{m}\mathbf{b}}_{\overset{\rightarrow}{\mathbf{S}}},{\mathbf{E}\mathbf{m}\mathbf{b}}_{\overset{\rightarrow}{\mathbf{S}}})} \in {\mathbb{R}}^{K \times d_{\mathbf{S}}}} $ |

La Ec. 1 agrega $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ según $ {\textstyle \mathbf{I}} $. Finalmente, las features embebidas y procesadas a partir de $ {\textstyle \mathbb{D}} $ se concatenan y se representan como:

| (2) | $ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{}^{}{\lbrack{\mathbf{E}\mathbf{m}\mathbf{b}}{}_{}^{}{\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{\left. \mathbf{S}\rightarrow \right.}^{}{\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{\left. \mathbf{R}\rightarrow \right.}^{}{\mathbf{E}\mathbf{m}\mathbf{b}}{}_{}^{}{\mathbf{E}\mathbf{m}\mathbf{b}}_{\mathbf{s}}\rbrack} \in {\mathbb{R}}^{K \times {({d_{\mathbf{U}} + d_{\mathbf{S}} + d_{\mathbf{C}} + d_{\mathbf{I}}})}}} $ |

$ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}_{\mathbb{D}}} $ se alimenta a un perceptrón multicapa (MLP) para producir un logit por muestra. El logit se utiliza para el aprendizaje en entrenamiento y para el ranking en inferencia.

La Fig. 1 muestra una disposición de datos y flujo de trabajo simplificados bajo el modelo de ranking tradicional. Estas features primero son embebidas, los embeddings iniciales se procesan con distintos métodos. Finalmente, las features procesadas se concatenan y se procesan por MLP para feature interaction. El logit final se genera para cada candidato.

3.3. Dilema de escalado en sistemas de recomendación

El escalado del modelo ha sido un método común para mejorar el rendimiento en ranking. Generalmente, el escalado del modelo apunta a escalar parámetros en el user module y el cross module. El user module procesa la feature de usuario, incluidas las features de secuencia, y genera una representación dependiente del usuario. Escalar el user module aporta una mejor representación para el usuario. Además, dado que el usuario se comparte y se infiere una sola vez para todos los candidatos, un costo de inferencia grande en el user module no provoca una sobrecarga gravosa del sistema. Sin embargo, escalar solo el user module no contribuye directamente a la feature interaction entre usuario e ítem.

Por el contrario, otra tendencia metodológica busca escalar el cross module, es decir, el MLP de feature interaction tras la concatenación de features. Estos métodos mejoran la capacidad de ranking prestando más atención a la interacción entre usuario y candidatos. Sin embargo, dado que el cross module se infiere para cada candidato, el aumento de cómputo escala linealmente con el número de candidatos. Escalar el cross module introduce una latencia del sistema inaceptable.

El dilema de escalado en el sistema de recomendación tradicional exige un nuevo método de escalado, que aporte una feature interaction eficiente entre usuario y candidatos al tiempo que produzca un costo de inferencia sub-lineal en el número de candidatos. MTGR innova el enfoque de escalado en el sistema de recomendación mediante la rearrangement de datos y la correspondiente optimización de arquitectura.

4. Reorganización de datos y arquitectura de MTGR

4.1. Agregación de muestras a nivel de usuario para eficiencia de entrenamiento e inferencia

Comparado con la categorización de features en la Sec. 3.1, para la $ {\textstyle i} $-ésima muestra entre los candidatos, MTGR organiza las features en $ {\textstyle {\mathbb{D}}_{i} = {\lbrack\mathbf{U},\overset{\rightarrow}{\mathbf{S}},\overset{\rightarrow}{\mathbf{R}},{\lbrack\mathbf{C}{}_{}^{}\mathbf{I}{}_{}^{}}\rbrack}} $. En particular, la cross feature $ {\textstyle \mathbf{C}} $ se dispone como parte de la feature de ítem de los candidatos. En MTGR, los candidatos se agregan por usuario en una ventana específica para entrenamiento y por solicitud para inferencia. Dado que la agregación se realiza para el mismo usuario, la muestra agregada puede usar la misma representación de usuario ($ {\textstyle \mathbf{U}} $, $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $, $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $). En particular, $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ ordena todos los ítems de interacción en tiempo real del usuario dentro de otra ventana específica en orden cronológico del tiempo de interacción.

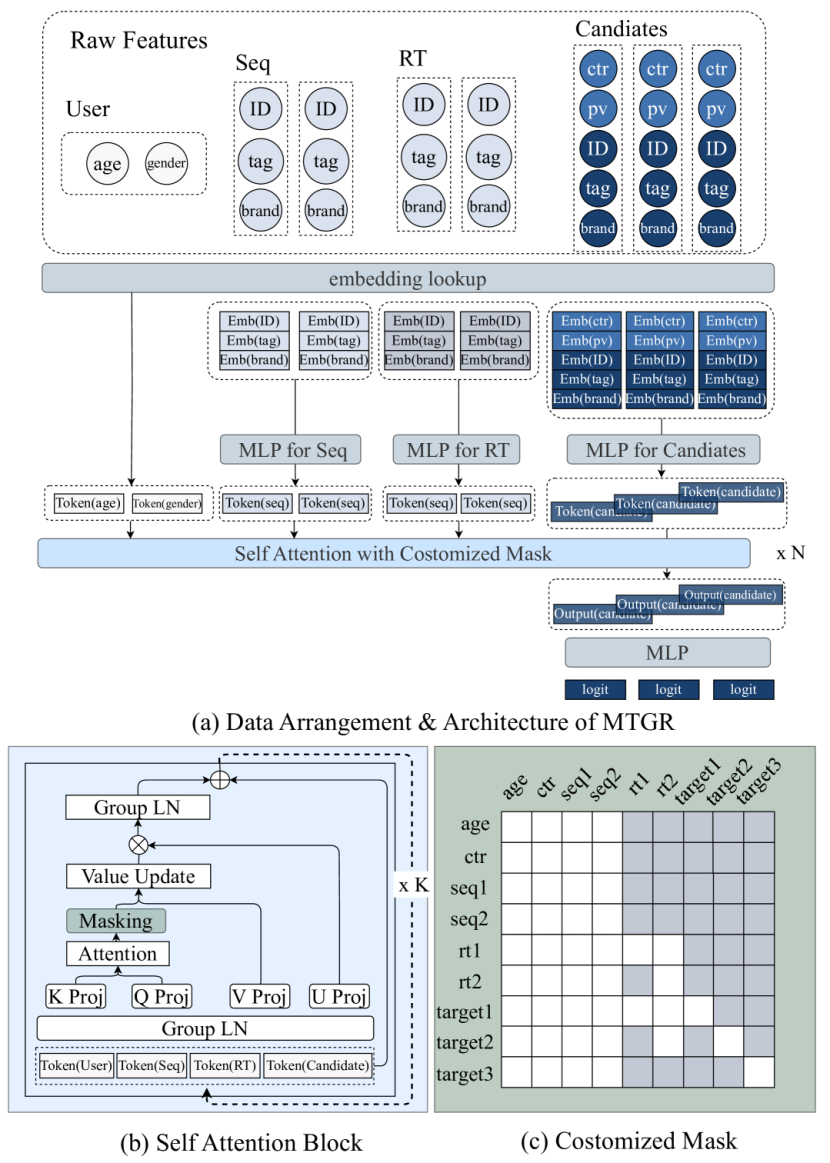

La Fig. 2(a) demuestra la agregación: comparada con la Fig. 1 donde solo se predice un candidato, la Fig. 2(a) agrega tres ítems en una sola muestra, reutilizando la misma representación de usuario. Formalmente, forma una representación de features para el mismo usuario:

| (3) | $ {\textstyle {\mathbb{D}} = {\lbrack\mathbf{U},\overset{\rightarrow}{\mathbf{S}},\overset{\rightarrow}{\mathbf{R}},{\lbrack\mathbf{C},\mathbf{I}\rbrack}_{1},\ldots,{\lbrack\mathbf{C},\mathbf{I}\rbrack}_{K}\rbrack}} $ |

Al agregar candidatos en una sola muestra, MTGR reduce una enorme cantidad de recursos al realizar un único cómputo y producir scores para todos los candidatos. En particular, el procedimiento de agregación por usuario reduce enormemente las muestras de entrenamiento desde el tamaño de todos los candidatos al de todos los usuarios. Para inferencia, los candidatos en una solicitud se agrupan como se mencionó arriba, MTGR realiza solo una inferencia única para el ranking de todos los candidatos, en vez de inferencias del orden del número de candidatos. La agregación elude la dependencia del volumen de candidatos en el costo de inferencia, dejando posibilidad y potencial para el escalado del modelo.

La Ec. 3 es una combinación de features escalares y de secuencia. Para unificar el formato de entrada, MTGR convierte features y secuencia en tokens. En particular, para las features escalares en $ {\textstyle \mathbf{U}} $, cada feature se convierte naturalmente en un token individual con dimensión $ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{}^{}{\mathbb{R}}^{N_{\mathbf{U}} \times d_{\text{model}}}} $. $ {\textstyle d_{\text{model}}} $ es una dimensión unificada fijada para todos los tokens. Para las features de secuencia de $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ y $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $, cada ítem $ {\textstyle \mathbf{S}} $ se considera un token. Las features en $ {\textstyle \mathbf{S}} $ primero son embebidas y concatenadas, luego se adopta un módulo MLP para unificación de dimensión. Formalmente, $ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{\mathbf{S}_{i}}^{}\text{MLP}{(\text{Concat}{({\mathbf{E}\mathbf{m}\mathbf{b}}{}_{}^{}})} \in {\mathbb{R}}^{d_{\text{model}}}} $. Las features de $ {\textstyle \mathbf{S}} $ en la secuencia se concatenan a lo largo de otra dimensión, dando $ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{\left. \mathbf{S}\rightarrow \right.}^{}{\mathbb{R}}^{N_{\overset{\rightarrow}{\mathbf{S}}} \times d_{\text{model}}}} $.

De forma similar, cada ítem $ {\textstyle \mathbf{I}} $ en candidatos se considera un token. Las features en candidatos se embeben y concatenan, y se convierten a la dimensión unificada por otro MLP. Los candidatos se concatenan como una serie de tokens: $ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{}^{}\text{Concat}{(\text{MLP}{(\text{Concat}{({\mathbf{E}\mathbf{m}\mathbf{b}}{}_{\mathbf{C}_{i}}^{}{\mathbf{E}\mathbf{m}\mathbf{b}}{}_{\mathbf{I}_{i}}^{}})})} \in {\mathbb{R}}^{N_{\mathbf{I}}}} $. Finalmente, los tokens construidos a partir de $ {\textstyle \mathbf{U}} $, $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $, $ {\textstyle \lbrack\mathbf{C},\mathbf{s}\rbrack} $ se concatenan, dando una larga secuencia de tokens:

| $ {\textstyle {\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}_{\mathbb{D}}} $ | $ {\textstyle =} $ | $ {\textstyle \text{Concat}{({\lbrack{\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{}^{}{\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{\left. \mathbf{S}\rightarrow \right.}^{}{\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{\left. \mathbf{R}\rightarrow \right.}^{}{\mathbf{F}\mathbf{e}\mathbf{a}\mathbf{t}}{}_{}^{}})}} $ | ||

| $ {\textstyle \in} $ | $ {\textstyle {\mathbb{R}}^{{({N_{\mathbf{U}} + N_{\overset{\rightarrow}{\mathbf{S}}} + N_{\overset{\rightarrow}{\mathbf{R}}} + N_{\mathbf{I}}})} \times d_{\text{model}}}} $ |

4.2. Encoder HSTU unificado

Las muestras de un usuario se agregan como una secuencia de tokens, naturalmente adecuada para procesarse mediante self-attention. Inspirado en HSTU (Zhai et al., 2024), MTGR utiliza pilas de capas de self-attention y una arquitectura encoder-only para el modelado.

Similar a un LLM, las secuencias de tokens de entrada se procesan capa por capa. Como se muestra en la Fig. 2, en el bloque de self-attention, la secuencia de entrada $ {\textstyle \mathbf{X}} $ primero es normalizada por group layer norm. Las features del mismo dominio (por ejemplo, $ {\textstyle \mathbf{U}} $) forman un grupo. Luego, el group layer norm asegura que tokens de distintos dominios compartan una distribución similar antes de la self-attention y alinea los distintos espacios semánticos de los distintos dominios $ {\textstyle \overset{\sim}{X} = {\text{GroupLN}\hspace{0pt}{(\mathbf{X})}}} $. La entrada normalizada se proyecta luego a 4 representaciones diferentes: $ {\textstyle {\mathbf{K},\mathbf{Q},\mathbf{V},\mathbf{U}} = {\text{MLP}_{\mathbf{K}/\mathbf{Q}/\mathbf{V}/\mathbf{U}}\hspace{0pt}{(\overset{\sim}{\mathbf{X}})}}} $. $ {\textstyle \mathbf{Q}} $, $ {\textstyle \mathbf{K}} $ se utilizan para el cómputo de multi-head attention con activación no lineal silu. La atención resultante se divide por la longitud total de las features de entrada como factor promedio. A continuación, se impone una máscara personalizada ($ {\textstyle \mathbf{M}} $) sobre el score de atención y la $ {\textstyle \mathbf{V}} $ proyectada se aplica para la actualización de valor:

| (5) | $ {\textstyle \overset{\sim}{\mathbf{V}}} $ | $ {\textstyle =} $ | $ {\textstyle \frac{\text{silu}\hspace{0pt}{({\mathbf{K}^{T}\hspace{0pt}\mathbf{Q}})}}{({N_{\mathbf{U}} + N_{\overset{\rightarrow}{\mathbf{S}}} + N_{\overset{\rightarrow}{\mathbf{R}}} + N_{\mathbf{I}}})}\hspace{0pt}{\mathbf{M}\mathbf{V}}} $ |

La $ {\textstyle \mathbf{U}} $ proyectada y la $ {\textstyle \overset{\sim}{\mathbf{V}}} $ actualizada se multiplican elemento a elemento. Luego, se aplica otro group layer norm. Finalmente, añadimos un módulo residual y colocamos otro MLP encima:

| (6) | $ {\textstyle \mathbf{X}} $ | $ {\textstyle =} $ | $ {\textstyle {\text{MLP}\hspace{0pt}{({\text{GroupLN}\hspace{0pt}{({\overset{\sim}{\mathbf{V}} \odot \mathbf{U}})}})}} + \mathbf{X}} $ |

Dynamic Masking (Zhai et al., 2024) utiliza la causal mask para el modelado de secuencias. Sin embargo, tal implementación no aporta una mejora significativa en MTGR. Además, dado que $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ registra las interacciones más recientes del usuario, cuyo timing podría coincidir con la ventana de agregación de la muestra, usar una causal mask simple en MTGR podría producir fugas de información. Por ejemplo, las interacciones de la noche no deberían exponerse a candidatos de la tarde, y sin embargo esta información puede agregarse en una sola muestra. Este dilema requiere un masking flexible y eficiente.

En MTGR, $ {\textstyle \mathbf{U}} $, $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ se consideran estáticos (en lo siguiente, denotamos $ {\textstyle \mathbf{U}} $, $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ como ‘secuencia estática’) porque su información proviene de antes de la ventana de agregación, por lo que no causa errores de causalidad. $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ es dinámica ya que incluye progresivamente las interacciones del usuario (‘secuencia dinámica’ para $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $) en tiempo real. MTGR aplica full attention para la secuencia estática, autorregresivo con dynamic masking para $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ y diagonal masking entre candidatos. En particular, se establecen 3 reglas para el masking de MTGR:

•

La secuencia estática es visible para todos los tokens.

•

La visibilidad de la secuencia dinámica respeta la causalidad: cada token solo es visible para tokens que ocurren después, lo que incluye los tokens de candidato.

•

Los tokens de candidato ($ {\textstyle \mathbf{C}} $, $ {\textstyle \mathbf{I}} $) son visibles solo a sí mismos.

La Fig. 2 (c) demuestra un ejemplo del dynamic masking: ‘age’, ‘ctr’ representan tokens de feature de $ {\textstyle \mathbf{U}} $; ‘seq1’, ‘seq2’ de $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $; ‘rt1’, ‘rt2’ de $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ y ‘target1’ - ‘target3’ para candidatos. Un bloque blanco en una fila representa que cierto token puede usar la información de otros, mientras la columna representa si el token es visible o no para otros. Se utiliza full attention para $ {\textstyle \mathbf{U}} $ y $ {\textstyle \mathbf{S}} $, dando lugar a un cuadrado blanco desde ‘age’ hasta ‘seq2’. Para ‘rt1’ a ‘rt2’, asumimos que ‘rt1’ aparece después que ‘rt2’; por lo tanto, se construye un pequeño cuadrado de ‘rt1’ a ‘rt2’ con bloques blancos en la triangular superior, lo que significa que ‘rt1’ puede usar información de ‘rt2’ mientras que ‘rt1’ no es visible para ‘rt2’. Además, se asume que ‘target2’ y ‘target3’ aparecen antes que ‘rt1’, por lo que ‘rt1’ no es visible para ellos. ‘rt2’ aparece antes que todos ‘target1’ y ‘target2’ pero después que ‘target3’. Por tanto, ‘rt2’ no es visible para ‘target3’, que aparece antes que todos los ‘rt’s, lo que provoca que no pueda usar información de los ‘rt’s.

5. Sistema de entrenamiento

Para facilitar el diseño y desarrollo de la estructura del modelo MTGR e incorporar convenientemente más features de la comunidad LLM en rápido crecimiento, decidimos no continuar con nuestro framework de entrenamiento previo basado en TensorFlow. En su lugar, optamos por reconstruir nuestro framework de entrenamiento dentro del ecosistema PyTorch. En particular, expandimos y optimizamos la funcionalidad de TorchRec, hicimos mejoras específicamente orientadas a las características del modelo MTGR y, finalmente, logramos un entrenamiento eficiente del modelo MTGR. Comparado con TorchRec, nuestro framework optimizado mejora el throughput de entrenamiento en 1.6x – 2.4x mientras logra buena escalabilidad al ejecutarse sobre más de 100 GPUs. Comparado con la línea base DLRM, alcanzamos 65x FLOPs por muestra para cómputo forward, mientras el costo de entrenamiento permaneció casi sin cambios. Detallamos a continuación parte de nuestro trabajo clave.

Dynamic Hash Table. TorchRec usa una tabla de tamaño fijo para procesar embeddings sparse, lo cual no es adecuado para escenarios industriales de entrenamiento en streaming a gran escala. Primero, no se pueden asignar embeddings adicionales a nuevos usuarios e ítems en tiempo real una vez que la tabla estática alcanza su capacidad preestablecida. Aunque podrían usarse algunos embeddings por defecto en este caso, o emplearse algunas estrategias de eviction para eliminar IDs ‘viejos’, la accuracy del modelo se degradará. Segundo, las tablas estáticas suelen requerir pre-asignación de capacidad superior a la necesaria realmente para evitar overflow de IDs, lo que inevitablemente conduce a una utilización ineficiente de memoria. Para abordar estos retos, implementamos una embedding table de alto rendimiento basada en hash, asignando dinámicamente espacio a IDs sparse durante el proceso de entrenamiento. Empleamos una arquitectura desacoplada para la hash table, separando el almacenamiento de claves y valores en estructuras distintas. La estructura de claves mantiene una tabla de mapeo ligera con claves y los punteros correspondientes a los vectores de embedding, mientras que la estructura de valores almacena tanto los vectores de embedding como metadatos auxiliares (p. ej., contadores y timestamps) requeridos por las políticas de eviction. Este diseño de doble estructura logra dos objetivos críticos: (1) habilitar expansión dinámica de capacidad mediante la replicación únicamente de la estructura compacta de claves en lugar de los enormes datos de embedding, y (2) optimizar la eficiencia del escaneo de claves almacenándolas en layouts de memoria compactos al tiempo que acomoda distribuciones de claves potencialmente sparse.

Embedding Lookup. El proceso de embedding lookup emplea comunicación All-to-all para el intercambio de embeddings entre dispositivos. Adoptamos una operación de unique de IDs en dos etapas para reducir IDs redundantes antes y después de la comunicación de IDs y evitar transferencias repetitivas de embeddings entre los dispositivos. También diseñamos una interfaz de configuración de features para implementar la fusión automática de tablas, que puede reducir el número de operadores de embedding lookup y así acelerar el proceso.

Load balance. En sistemas de recomendación, las secuencias de comportamiento de usuario suelen exhibir una distribución de cola larga, donde solo unos pocos usuarios tienen secuencias largas, mientras que la mayoría las tienen cortas. Esto provoca un significativo desequilibrio de carga computacional al entrenar con un batch size fijo (abreviado BS). Una solución común es usar técnicas de sequence packing (Krell et al., 2021), donde múltiples secuencias cortas se fusionan en una más larga. Sin embargo, este enfoque requiere ajustes cuidadosos del mask para evitar que distintas secuencias interfieran entre sí durante el cómputo de attention, lo que puede ser bastante costoso de implementar. Nuestra solución directa es introducir un BS dinámico. El BS local de cada GPU se ajusta según la longitud real de la secuencia de los datos de entrada, asegurando una carga de cómputo similar. Adicionalmente, hemos ajustado la estrategia de agregación de gradientes para ponderar los gradientes de cada GPU según su BS, manteniendo la consistencia de la lógica de cómputo con un BS fijo.

Other Optimizations. Para mejorar aún más la eficiencia del entrenamiento, maximizamos el paralelismo mediante tecnología de pipeline usando tres streams: copy, dispatch y compute. En particular, el stream copy carga datos de entrada de CPU a GPU, el stream dispatch realiza lookups de tabla basados en IDs, y el stream compute maneja el cómputo forward y las actualizaciones backward. Por ejemplo, mientras el stream compute ejecuta los pases forward y backward para el batch $ {\textstyle \mathbf{T}} $, el stream copy carga concurrentemente el batch $ {\textstyle \mathbf{T} + 1} $ para enmascarar la latencia de I/O. Al completar las actualizaciones backward para el batch $ {\textstyle \mathbf{T}} $, el stream dispatch inicia inmediatamente lookups de tabla y comunicación para el batch $ {\textstyle \mathbf{T} + 1} $. Además, empleamos entrenamiento en mixed precision bf16 y desarrollamos un kernel de attention bien diseñado basado en cutlass que es similar a FlashAttention para acelerar el proceso de entrenamiento.

6. Experimentos

6.1. Configuración del experimento

Datasets. Los datasets públicos suelen usar features independientes de ID y atributo, donde rara vez se introducen cross features. Sin embargo, las cross features demuestran importancia en aplicaciones del mundo real. Las cross features son una categoría importante de features en nuestro escenario. Suelen ser meticulosamente hechas a mano, incluyendo interacciones como usuario-ítem, usuario y categorías de nivel superior, e ítem e información espacio-temporal. Para compensar la ausencia de cross features en datasets públicos, construimos un dataset de entrenamiento basado en logs del sistema real de recomendación a escala industrial en Meituan. A diferencia de los datasets públicos, nuestro dataset real contiene un conjunto más rico de cross features y secuencias de comportamiento de usuario más largas. Además, el volumen de nuestro dataset es grande, permitiendo que modelos complejos alcancen una convergencia más adecuada durante el entrenamiento. Para los experimentos offline, recolectamos datos durante un período de $ {\textstyle 10} $ días. Las estadísticas del dataset se muestran en la Tabla 1. Para los experimentos online, con el fin de comparar con la línea base DLRM que ha sido entrenada durante más de $ {\textstyle 2} $ años, construimos un dataset de plazo más largo para los experimentos, usando datos que abarcan más de $ {\textstyle 6} $ meses.

| Dataset | #Users | #Items | #Exposure | #Click | #Purchases |

|---|---|---|---|---|---|

| Train | 0.21 billion | 4,302,391 | 23.74 billion | 1.08 billion | 0.18 billion |

| Test | 3,021,198 | 3,141,997 | 76,855,608 | 4,545,386 | 769,534 |

Baseline. Para DLRM, comparamos dos métodos en el modelado de secuencias: SIM basado en recuperación de secuencias y modelado End2End para secuencias largas originales (E2E). En cuanto al escalado, comparamos DNN, MoE (Ma et al., 2018), Wukong (Zhang et al., 2024b), MultiEmbed (Guo et al., 2023) y UserTower.

MoE usa $ {\textstyle 4} $ expertos, conteniendo cada uno una red de la misma complejidad que el DNN base. Wukong y MultiEmbed se configuran a la misma complejidad computacional que MoE. UserTower utiliza un conjunto de queries aprendibles e inserta una capa qFormer (Li et al., 2023) con otro módulo MoE (16 expertos) sobre el comportamiento de usuario. La complejidad computacional de UserTower es el triple que la del método MoE, pero puede compartir este cómputo para múltiples ítems predichos del mismo usuario durante la inferencia, reduciendo así los costos de inferencia. Ha logrado buenos resultados en nuestro escenario.

MTGR emplea E2E para manejar toda la información de secuencia. Adicionalmente, como se muestra en la Tabla 2, hemos configurado tres escalas distintas para verificar la escalabilidad de MTGR.

| Model | Setting | Learning rate | GFLOPs/example |

|---|---|---|---|

| UserTower-SIM | - | $ {\textstyle 8 \times 10^{- 4}} $ | 0.86 |

| MTGR-small | $ {\textstyle n_{\text{layer}} = 3} $, $ {\textstyle d_{\text{model}} = 512} $, $ {\textstyle n_{\text{heads}} = 2} $ | $ {\textstyle 3 \times 10^{- 4}} $ | 5.47 |

| MTGR-medium | $ {\textstyle n_{\text{layer}} = 5} $, $ {\textstyle d_{\text{model}} = 768} $, $ {\textstyle n_{\text{heads}} = 3} $ | $ {\textstyle 3 \times 10^{- 4}} $ | 18.59 |

| MTGR-large | $ {\textstyle n_{\text{layer}} = 15} $, $ {\textstyle d_{\text{model}} = 768} $, $ {\textstyle n_{\text{heads}} = 3} $ | $ {\textstyle 1 \times 10^{- 4}} $ | 55.76 |

Evaluation Metrics. En offline, nos centramos en el aprendizaje de dos tareas: CTR y CTCVR (Click-Through Conversion Rate) y usamos AUC (Ferri et al., 2011) y GAUC (Group AUC) para la evaluación. GAUC se promedia sobre los AUC por usuario. Comparado con AUC, GAUC presta más atención a la capacidad de ranking del modelo para el mismo usuario. Para la evaluación online, nos centramos en dos métricas: PV_CTR (CTR por page view) y UV_CTCVR (CTCVR por user view), donde UV_CTCVR es la métrica más crucial para evaluar el crecimiento del negocio.

Parameter Setting. Nuestro modelo se entrena usando el optimizador Adam. Para DLRM, cada GPU procesa un batch size de 2400, con 8 GPUs NVIDIA A100 para el entrenamiento. En el caso de MTGR, el batch size se fija en 96, utilizando 16 GPUs NVIDIA A100 para el entrenamiento. Como se muestra en la Tabla 2, el learning rate disminuye al aumentar la complejidad del modelo. Además, conforme crece el tamaño del modelo, aumentamos proporcionalmente el tamaño de los parámetros sparse. Suponiendo que un token consta de $ {\textstyle k} $ features, la dimensión del embedding por feature se fija generalmente en un entero cercano a $ {\textstyle d_{\text{model}}/k} $. Finalmente, la longitud máxima de $ {\textstyle \overset{\rightarrow}{\mathbf{S}}} $ se fija en $ {\textstyle 1000} $, mientras que $ {\textstyle \overset{\rightarrow}{\mathbf{R}}} $ se fija en $ {\textstyle 100} $.

6.2. Comparación de rendimiento general

Evaluamos el rendimiento de MTGR y otros métodos baseline usando nuestro dataset de 10 días. La Tabla 3 muestra el rendimiento de los distintos modelos. Las diferencias entre los distintos modelos en las distintas métricas offline son bastante consistentes. Según la experiencia previa, un incremento de $ {\textstyle 0.001} $ en nuestra métrica offline se considera significativo. Entre las distintas versiones de DLRM, Wukong-SIM y MultiEmbed-SIM logran un mejor resultado que MoE-SIM. UserTower-SIM rinde mejor y UserTower-E2E muestra una ligera disminución de rendimiento comparado con UserTower-SIM. Especulamos que bajo el paradigma DLRM, la complejidad del modelo es insuficiente para modelar toda la información de secuencia, dando lugar a underfitting. Nuestro MTGR propuesto, incluso la versión más pequeña, supera al modelo DLRM más fuerte. Adicionalmente, modelos de tres tamaños distintos exhiben escalabilidad, con su rendimiento creciendo suavemente al aumentar la complejidad del modelo.

| Model | CTR | CTCVR | ||

|---|---|---|---|---|

| AUC | GAUC | AUC | GAUC | |

| DNN-SIM | 0.7432 | 0.6679 | 0.8737 | 0.6504 |

| MoE-SIM | 0.7484 | 0.6698 | 0.8750 | 0.6519 |

| MultiEmbed-SIM | 0.7501 | 0.6715 | 0.8766 | 0.6525 |

| Wukong-SIM | 0.7568 | 0.6759 | 0.8800 | 0.6530 |

| UserTower-SIM | 0.7593 | 0.6792 | 0.8815 | 0.6550 |

| UserTower-E2E | 0.7576 | 0.6787 | 0.8818 | 0.6548 |

| MTGR-small | 0.7631 | 0.6826 | 0.8840 | 0.6603 |

| MTGR-medium | 0.7645 | 0.6843 | 0.8849 | 0.6625 |

| MTGR-large | 0.7661 | 0.6865 | 0.8862 | 0.6646 |

| Impr.% | 0.8956 | 1.0748 | 0.4990 | 1.4656 |

| Model | CTR | CTCVR | ||

|---|---|---|---|---|

| AUC | GAUC | AUC | GAUC | |

| MTGR-small | 0.7631 | 0.6826 | 0.8840 | 0.6603 |

| w/o cross features | 0.7495 | 0.6689 | 0.8736 | 0.6514 |

| w/o GLN | 0.7606 | 0.6809 | 0.8826 | 0.6585 |

| w/o dynamic mask | 0.7620 | 0.6810 | 0.8828 | 0.6587 |

6.3. Estudio de ablación

Realizamos estudios de ablación sobre dos componentes de MTGR: Dynamic Masking y group layer norm (GLN), basados en nuestra versión small. Los resultados de ablación se muestran en la Fig. 4. Eliminar cualquiera de estos de MTGR resultará en un declive significativo del rendimiento, con un grado de declive comparable al incremento de MTGR-small a MTGR-medium. Esto indica la importancia de Dynamic Masking y GLN para MTGR. Además, realizamos experimentos extra sobre la importancia de las cross features para MTGR. Tras eliminar las cross features, las métricas de rendimiento muestran una caída significativa, que incluso borra la ganancia de MTGR-large sobre DLRM, destacando el papel vital de las cross features en el sistema real de recomendación.

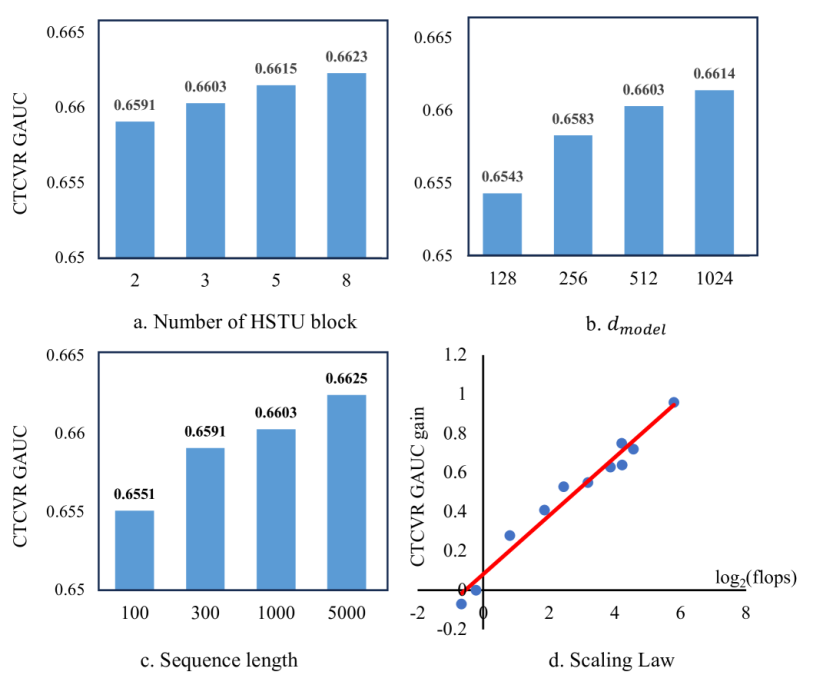

6.4. Escalabilidad

La Fig. 3 ilustra la escalabilidad de nuestro MTGR. Realizamos pruebas basadas en MTGR-small para tres hiperparámetros distintos: el número de bloques HSTU, el $ {\textstyle d_{\text{model}}} $ y la longitud de la secuencia de entrada. Como se observa, MTGR demuestra buena escalabilidad a través de distintos hiperparámetros. Además, la Fig. 3(d) presenta una relación de ley de potencia entre rendimiento y complejidad computacional. El eje vertical indica la ganancia en la métrica CTCVR GAUC respecto a nuestro mejor modelo DLRM, UserTower-SIM, mientras que el eje horizontal refleja el múltiplo logarítmico de complejidad computacional comparado con UserTower-SIM.

6.5. Experimentos online

Para validar adicionalmente la efectividad de MTGR, desplegamos MTGR en la plataforma Meituan Take-away, realizando AB testing con $ {\textstyle 2\%} $ del tráfico. El volumen de tráfico experimental cubre millones de exposiciones por día, demostrando la confianza del experimento. La línea base de comparación es el modelo DLRM online más avanzado (UserTower-SIM), y ha estado aprendiendo continuamente durante $ {\textstyle 2} $ años. Usamos datos de los últimos $ {\textstyle 6} $ meses para entrenar el modelo MTGR, que luego se despliega online para la comparación.

Aunque el volumen de datos de entrenamiento es significativamente menor que el del modelo DLRM, las métricas offline y online aún superan ampliamente la base DLRM. Como se muestra en la Tabla 5, tanto las métricas offline como online demuestran escalabilidad. También encontramos que, conforme aumenta el número de tokens de entrenamiento, los beneficios respecto a DLRM siguen amplificándose. Eventualmente, en términos de CTCVR GAUC, nuestra versión large incluso supera el incremento acumulado de todas las optimizaciones del último año.

El modelo ya ha sido completamente desplegado en nuestro escenario, con costos de entrenamiento iguales a DLRM y costos de inferencia reducidos en $ {\textstyle 12\%} $. Para DLRM, su costo de inferencia es aproximadamente lineal con el número de candidatos. Sin embargo, MTGR usa user aggregation para todos los candidatos en una solicitud, dando lugar a un escalado sub-lineal del costo de inferencia con el número de candidatos. Esto nos ayuda a reducir el overhead de la inferencia online.

| Offline Metric diff | Online Metric diff | |||

|---|---|---|---|---|

| CTR GAUC | CTCVR GAUC | PV_CTR | UV_CTCVR | |

| MTGR-small | +0.0036 | +0.0154 | +1.04% | +0.04% |

| MTGR-medium | +0.0071 | +0.0182 | +2.29% | +0.62% |

| MTGR-large | +0.0153 | +0.0288 | +1.90% | +1.02% |

7. Conclusión

En este artículo, propusimos MTGR, un nuevo framework de ranking para explorar la scaling law en sistemas de recomendación basado en HSTU. MTGR combina las ventajas de DLRM y GRM, permitiendo el uso de cross features para asegurar el rendimiento del modelo a la vez que tiene la misma escalabilidad que GRM. MTGR ya ha sido desplegado en nuestro escenario y ha aportado beneficios significativos. En el futuro, exploraremos cómo extender MTGR al modelado multi-escenario, similar a los large language models, para establecer un modelo fundacional de recomendación con conocimiento extenso.

Referencias

- (1)

- Chen et al. (2021) Qiwei Chen, Changhua Pei, Shanshan Lv, Chao Li, Junfeng Ge, and Wenwu Ou. 2021. End-to-end user behavior retrieval in click-through rateprediction model. arXiv preprint arXiv:2108.04468 (2021).

- Dao et al. (2022) Tri Dao, Dan Fu, Stefano Ermon, Atri Rudra, and Christopher Ré. 2022. Flashattention: Fast and memory-efficient exact attention with io-awareness. Advances in neural information processing systems 35 (2022), 16344–16359.

- Deng et al. (2025) Jiaxin Deng, Shiyao Wang, Kuo Cai, Lejian Ren, Qigen Hu, Weifeng Ding, Qiang Luo, and Guorui Zhou. 2025. OneRec: Unifying Retrieve and Rank with Generative Recommender and Iterative Preference Alignment. arXiv preprint arXiv:2502.18965 (2025).

- Fang et al. (2024) Yan Fang, Jingtao Zhan, Qingyao Ai, Jiaxin Mao, Weihang Su, Jia Chen, and Yiqun Liu. 2024. Scaling laws for dense retrieval. In Proceedings of the 47th International ACM SIGIR Conference on Research and Development in Information Retrieval. 1339–1349.

- Ferri et al. (2011) Cesar Ferri, José Hernández-Orallo, and Peter A Flach. 2011. A coherent interpretation of AUC as a measure of aggregated classification performance. In Proceedings of the 28th International Conference on Machine Learning (ICML-11). 657–664.

- Guo et al. (2023) Xingzhuo Guo, Junwei Pan, Ximei Wang, Baixu Chen, Jie Jiang, and Mingsheng Long. 2023. On the embedding collapse when scaling up recommendation models. arXiv preprint arXiv:2310.04400 (2023).

- Han et al. (2024) Ruidong Han, Qianzhong Li, He Jiang, Rui Li, Yurou Zhao, Xiang Li, and Wei Lin. 2024. Enhancing CTR Prediction through Sequential Recommendation Pre-training: Introducing the SRP4CTR Framework. In Proceedings of the 33rd ACM International Conference on Information and Knowledge Management. 3777–3781.

- Ivchenko et al. (2022) Dmytro Ivchenko, Dennis Van Der Staay, Colin Taylor, Xing Liu, Will Feng, Rahul Kindi, Anirudh Sudarshan, and Shahin Sefati. 2022. Torchrec: a pytorch domain library for recommendation systems. In Proceedings of the 16th ACM Conference on Recommender Systems. 482–483.

- Kaplan et al. (2020) Jared Kaplan, Sam McCandlish, Tom Henighan, Tom B Brown, Benjamin Chess, Rewon Child, Scott Gray, Alec Radford, Jeffrey Wu, and Dario Amodei. 2020. Scaling laws for neural language models. arXiv preprint arXiv:2001.08361 (2020).

- Krell et al. (2021) Mario Michael Krell, Matej Kosec, Sergio P Perez, and Andrew Fitzgibbon. 2021. Efficient sequence packing without cross-contamination: Accelerating large language models without impacting performance. arXiv preprint arXiv:2107.02027 (2021).

- Li et al. (2023) Junnan Li, Dongxu Li, Silvio Savarese, and Steven Hoi. 2023. Blip-2: Bootstrapping language-image pre-training with frozen image encoders and large language models. In International conference on machine learning. PMLR, 19730–19742.

- Lian et al. (2018) Jianxun Lian, Xiaohuan Zhou, Fuzheng Zhang, Zhongxia Chen, Xing Xie, and Guangzhong Sun. 2018. xdeepfm: Combining explicit and implicit feature interactions for recommender systems. In Proceedings of the 24th ACM SIGKDD international conference on knowledge discovery & data mining. 1754–1763.

- Ma et al. (2018) Jiaqi Ma, Zhe Zhao, Xinyang Yi, Jilin Chen, Lichan Hong, and Ed H Chi. 2018. Modeling task relationships in multi-task learning with multi-gate mixture-of-experts. In Proceedings of the 24th ACM SIGKDD international conference on knowledge discovery & data mining. 1930–1939.

- Peebles and Xie (2023) William Peebles and Saining Xie. 2023. Scalable diffusion models with transformers. In Proceedings of the IEEE/CVF international conference on computer vision. 4195–4205.

- Pi et al. (2020) Qi Pi, Guorui Zhou, Yujing Zhang, Zhe Wang, Lejian Ren, Ying Fan, Xiaoqiang Zhu, and Kun Gai. 2020. Search-based user interest modeling with lifelong sequential behavior data for click-through rate prediction. In Proceedings of the 29th ACM International Conference on Information & Knowledge Management. 2685–2692.

- Shin et al. (2023) Kyuyong Shin, Hanock Kwak, Su Young Kim, Max Nihlén Ramström, Jisu Jeong, Jung-Woo Ha, and Kyung-Min Kim. 2023. Scaling law for recommendation models: Towards general-purpose user representations. In Proceedings of the AAAI conference on artificial intelligence, Vol. 37. 4596–4604.

- Si et al. (2024) Zihua Si, Lin Guan, ZhongXiang Sun, Xiaoxue Zang, Jing Lu, Yiqun Hui, Xingchao Cao, Zeyu Yang, Yichen Zheng, Dewei Leng, et al. 2024. Twin v2: Scaling ultra-long user behavior sequence modeling for enhanced ctr prediction at kuaishou. In Proceedings of the 33rd ACM International Conference on Information and Knowledge Management. 4890–4897.

- Tang et al. (2020) Hongyan Tang, Junning Liu, Ming Zhao, and Xudong Gong. 2020. Progressive layered extraction (ple): A novel multi-task learning (mtl) model for personalized recommendations. In Proceedings of the 14th ACM conference on recommender systems. 269–278.

- Wang et al. (2021) Ruoxi Wang, Rakesh Shivanna, Derek Cheng, Sagar Jain, Dong Lin, Lichan Hong, and Ed Chi. 2021. Dcn v2: Improved deep & cross network and practical lessons for web-scale learning to rank systems. In Proceedings of the web conference 2021. 1785–1797.

- Wang et al. (2024) Xu Wang, Jiangxia Cao, Zhiyi Fu, Kun Gai, and Guorui Zhou. 2024. HoME: Hierarchy of Multi-Gate Experts for Multi-Task Learning at Kuaishou. arXiv preprint arXiv:2408.05430 (2024).

- Yan et al. (2025) Bencheng Yan, Shilei Liu, Zhiyuan Zeng, Zihao Wang, Yizhen Zhang, Yujin Yuan, Langming Liu, Jiaqi Liu, Di Wang, Wenbo Su, et al. 2025. Unlocking Scaling Law in Industrial Recommendation Systems with a Three-step Paradigm based Large User Model. arXiv preprint arXiv:2502.08309 (2025).

- Zhai et al. (2024) Jiaqi Zhai, Lucy Liao, Xing Liu, Yueming Wang, Rui Li, Xuan Cao, Leon Gao, Zhaojie Gong, Fangda Gu, Michael He, et al. 2024. Actions speak louder than words: Trillion-parameter sequential transducers for generative recommendations. arXiv preprint arXiv:2402.17152 (2024).

- Zhai et al. (2022) Xiaohua Zhai, Alexander Kolesnikov, Neil Houlsby, and Lucas Beyer. 2022. Scaling vision transformers. In Proceedings of the IEEE/CVF conference on computer vision and pattern recognition. 12104–12113.

- Zhang et al. (2024b) Buyun Zhang, Liang Luo, Yuxin Chen, Jade Nie, Xi Liu, Daifeng Guo, Yanli Zhao, Shen Li, Yuchen Hao, Yantao Yao, et al. 2024b. Wukong: Towards a scaling law for large-scale recommendation. arXiv preprint arXiv:2403.02545 (2024).

- Zhang et al. (2024a) Wei Zhang, Dai Li, Chen Liang, Fang Zhou, Zhongke Zhang, Xuewei Wang, Ru Li, Yi Zhou, Yaning Huang, Dong Liang, et al. 2024a. Scaling User Modeling: Large-scale Online User Representations for Ads Personalization in Meta. In Companion Proceedings of the ACM Web Conference 2024. 47–55.

- Zhou et al. (2018) Guorui Zhou, Xiaoqiang Zhu, Chenru Song, Ying Fan, Han Zhu, Xiao Ma, Yanghui Yan, Junqi Jin, Han Li, and Kun Gai. 2018. Deep interest network for click-through rate prediction. In Proceedings of the 24th ACM SIGKDD international conference on knowledge discovery & data mining. 1059–1068.