A Theoretically Grounded Application of Dropout in Recurrent Neural Networks/paper/es

| Research Paper | |

|---|---|

| Authors | Yarin Gal; Zoubin Ghahramani |

| Year | 2015 |

| Topic area | Machine Learning |

| Difficulty | Research |

| arXiv | 1512.05287 |

| Download PDF | |

A Theoretically Grounded Application of Dropout in Recurrent Neural Networks

&Yarin Gal &

University of Cambridge

{yg279,zg201}@cam.ac.uk &Zoubin Ghahramani

Resumen

Las redes neuronales recurrentes (RNN) están en la primera línea de muchos avances recientes del aprendizaje profundo. Sin embargo, una dificultad importante de estos modelos es su tendencia al sobreajuste, y el dropout ha demostrado fallar cuando se aplica a las capas recurrentes. Resultados recientes en la intersección entre el modelado bayesiano y el aprendizaje profundo ofrecen una interpretación bayesiana de técnicas habituales de aprendizaje profundo, como el dropout. Esta fundamentación del dropout en la inferencia bayesiana aproximada sugiere una extensión de los resultados teóricos que aporta nuevas ideas sobre el uso del dropout con modelos RNN. Aplicamos esta nueva técnica de dropout basada en inferencia variacional en modelos LSTM y GRU, evaluándola en tareas de modelado de lenguaje y análisis de sentimientos. El nuevo enfoque supera a las técnicas existentes y, hasta donde sabemos, mejora el estado del arte de modelo único en modelado de lenguaje en Penn Treebank (perplejidad de prueba de 73,4). Esto amplía nuestro arsenal de herramientas variacionales en deep learning.

1 Introducción

Las redes neuronales recurrentes (RNN) son modelos basados en secuencias de importancia clave para la comprensión del lenguaje natural, la generación de lenguaje, el procesamiento de vídeo y muchas otras tareas [1, 2, 3]. La entrada del modelo es una secuencia de símbolos en la que, en cada paso temporal, se aplica una pequeña red neuronal (la unidad RNN) a un único símbolo, así como a la salida de la red en el paso temporal anterior. Las RNN son modelos potentes que muestran un rendimiento sobresaliente en muchas tareas, pero se sobreajustan rápidamente. La falta de regularización en los modelos RNN dificulta el manejo de pequeños volúmenes de datos, y para evitar el sobreajuste los investigadores recurren a menudo a la parada temprana o a modelos pequeños y subespecificados [4].

El dropout es una técnica de regularización popular en redes profundas [5, 6] en la que las unidades de la red se enmascaran al azar durante el entrenamiento (se eliminan). Pero la técnica nunca se ha aplicado con éxito a las RNN. Los resultados empíricos han llevado a muchos a creer que el ruido añadido a las capas recurrentes (las conexiones entre unidades RNN) se amplificará en secuencias largas y ahogará la señal [4]. En consecuencia, la investigación existente ha concluido que la técnica debe usarse únicamente con las entradas y las salidas de la RNN [4, 7, 8, 9, 10]. Pero este enfoque sigue conduciendo al sobreajuste, como se muestra en nuestros experimentos.

Resultados recientes en la intersección entre la investigación bayesiana y el aprendizaje profundo ofrecen una interpretación de las técnicas habituales de aprendizaje profundo desde una óptica bayesiana [11, 12, 13, 14, 15, 16]. Esta visión bayesiana del aprendizaje profundo permitió la introducción de nuevas técnicas en el campo, como métodos para obtener estimaciones de incertidumbre fundamentadas a partir de redes de aprendizaje profundo [14, 17]. Gal y Ghahramani [14] mostraron, por ejemplo, que el dropout puede interpretarse como una aproximación variacional al posterior de una red neuronal (NN) bayesiana. Su distribución variacional aproximante es una mezcla de dos gaussianas con varianzas pequeñas, con la media de una de las gaussianas fijada en cero. Esta fundamentación del dropout en la inferencia bayesiana aproximada sugiere que una extensión de los resultados teóricos podría aportar ideas sobre el uso de la técnica con modelos RNN.

Aquí nos centramos en modelos RNN comunes en el campo (LSTM [18], GRU [19]) y los interpretamos como modelos probabilísticos, es decir, como RNN cuyos pesos se tratan como variables aleatorias y con funciones de verosimilitud adecuadamente definidas. A continuación realizamos inferencia variacional aproximada en estos modelos bayesianos probabilísticos (a los que llamaremos Variational RNNs). Aproximar la distribución posterior sobre los pesos con una mezcla de gaussianas (con una componente fijada en cero y varianzas pequeñas) conduce a un objetivo de optimización tratable. Optimizar este objetivo es idéntico a aplicar una nueva variante de dropout en las RNN correspondientes.

[[File:data:image/svg+xml;base64,PHN2ZyBoZWlnaHQ9IjM0Ny4yOSIgaWQ9IlMxLkYxLnNmMS5waWMxIiBvdmVyZmxvdz0idmlzaWJsZSIgdmVyc2lvbj0iMS4xIiB3aWR0aD0iMjYzLjA5Ij48ZyBmaWxsPSIjMDAwMDAwIiBzdHJva2U9IiMwMDAwMDAiIHRyYW5zZm9ybT0idHJhbnNsYXRlKDAsMzQ3LjI5KSBtYXRyaXgoMSAwIDAgLTEgMCAwKSB0cmFuc2xhdGUoMTMwLjY4LDApIHRyYW5zbGF0ZSgwLDI4Ljg1KSI+PGcgc3Ryb2tlLXdpZHRoPSIwLjRwdCI+PGcgZmlsbD0iIzAwMDAwMCIgc3Ryb2tlPSIjMDAwMDAwIiB0cmFuc2Zvcm09Im1hdHJpeCgxLjAgMC4wIDAuMCAxLjAgLTExLjcyIC0xMC4yNCkiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgMTYuMzIpIj48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAxIDAgOS40NikiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgMCkiPjxmb3JlaWdub2JqZWN0IGhlaWdodD0iMTIuMTUiIG92ZXJmbG93PSJ2aXNpYmxlIiB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAtMSAwIDE2LjYpIiB3aWR0aD0iMjMuNDUiPlxwZ2ZtYXRocmVzdWx0cHQ8L2ZvcmVpZ25vYmplY3Q+PC9nPjwvZz48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAxIDAgMTguMTEpIj48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAtMSA2LjM3IDApIj48Zm9yZWlnbm9iamVjdCBoZWlnaHQ9IjguMzQiIG92ZXJmbG93PSJ2aXNpYmxlIiB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAtMSAwIDE2LjYpIiB3aWR0aD0iMTAuNzEiPjxtYXRoIGFsdHRleHQ9Inhfe3R9IiBkaXNwbGF5PSJpbmxpbmUiIGlkPSJTMS5GMS5zZjEucGljMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMSI+PHNlbWFudGljcyBpZD0iUzEuRjEuc2YxLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjFhIj48bXN1YiBpZD0iUzEuRjEuc2YxLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMSIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS5jbW1sIj48bWkgaWQ9IlMxLkYxLnNmMS5waWMxLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMiIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4yLmNtbWwiPng8L21pPjxtaSBpZD0iUzEuRjEuc2YxLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zIiB4cmVmPSJTMS5GMS5zZjEucGljMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuY21tbCI+dDwvbWk+PC9tc3ViPjxhbm5vdGF0aW9uLXhtbCBlbmNvZGluZz0iTWF0aE1MLUNvbnRlbnQiIGlkPSJTMS5GMS5zZjEucGljMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMWIiPjxhcHBseSBpZD0iUzEuRjEuc2YxLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xIj48Y3N5bWJvbCBjZD0iYW1iaWd1b3VzIiBpZD0iUzEuRjEuc2YxLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4xLmNtbWwiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEiPnN1YnNjcmlwdDwvY3N5bWJvbD48Y2kgaWQ9IlMxLkYxLnNmMS5waWMxLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMi5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIiPvCdkaU8L2NpPjxjaSBpZD0iUzEuRjEuc2YxLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLmNtbWwiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMyI+8J2RoTwvY2k+PC9hcHBseT48L2Fubm90YXRpb24teG1sPjxhbm5vdGF0aW9uIGVuY29kaW5nPSJhcHBsaWNhdGlvbi94LXRleCIgaWQ9IlMxLkYxLnNmMS5waWMxLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xYyI+eF97dH08L2Fubm90YXRpb24+PC9zZW1hbnRpY3M+PC9tYXRoPjwvZm9yZWlnbm9iamVjdD48L2c+PC9nPjwvZz48L2c+PHBhdGggZD0iTSAtNC42MSA1OS43NiBoIDkuMjIgdiA0OC41OSBoIC05LjIyIFoiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PHBhdGggZD0iTSAtNC42MSAxNTMuMjYgaCA5LjIyIHYgNDguNTkgaCAtOS4yMiBaIiBzdHlsZT0iZmlsbDpub25lIiAvPjxnIGZpbGw9IiMwMDAwMDAiIHN0cm9rZT0iIzAwMDAwMCIgdHJhbnNmb3JtPSJtYXRyaXgoMS4wIDAuMCAwLjAgMS4wIC01LjA0IDI1MS4zNykiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgNDMuNjk1KSI+PGcgdHJhbnNmb3JtPSJtYXRyaXgoMSAwIDAgMSAwIDQ1LjMzKSI+PGcgdHJhbnNmb3JtPSJtYXRyaXgoMSAwIDAgLTEgMCAwKSI+PGZvcmVpZ25vYmplY3QgaGVpZ2h0PSI4LjY1IiBvdmVyZmxvdz0idmlzaWJsZSIgdHJhbnNmb3JtPSJtYXRyaXgoMSAwIDAgLTEgMCAxNi42KSIgd2lkdGg9IjEwLjA4Ij48bWF0aCBhbHR0ZXh0PSJ5X3t0fSIgZGlzcGxheT0iaW5saW5lIiBpZD0iUzEuRjEuc2YxLnBpYzEuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEiPjxzZW1hbnRpY3MgaWQ9IlMxLkYxLnNmMS5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xYSI+PG1zdWIgaWQ9IlMxLkYxLnNmMS5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuY21tbCI+PG1pIGlkPSJTMS5GMS5zZjEucGljMS4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMi5jbW1sIj55PC9taT48bWkgaWQ9IlMxLkYxLnNmMS5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMyIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLmNtbWwiPnQ8L21pPjwvbXN1Yj48YW5ub3RhdGlvbi14bWwgZW5jb2Rpbmc9Ik1hdGhNTC1Db250ZW50IiBpZD0iUzEuRjEuc2YxLnBpYzEuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjFiIj48YXBwbHkgaWQ9IlMxLkYxLnNmMS5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuY21tbCIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMSI+PGNzeW1ib2wgY2Q9ImFtYmlndW91cyIgaWQ9IlMxLkYxLnNmMS5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xIj5zdWJzY3JpcHQ8L2NzeW1ib2w+PGNpIGlkPSJTMS5GMS5zZjEucGljMS4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIuY21tbCIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4yIj7wnZGmPC9jaT48Y2kgaWQ9IlMxLkYxLnNmMS5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMiPvCdkaE8L2NpPjwvYXBwbHk+PC9hbm5vdGF0aW9uLXhtbD48YW5ub3RhdGlvbiBlbmNvZGluZz0iYXBwbGljYXRpb24veC10ZXgiIGlkPSJTMS5GMS5zZjEucGljMS4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMWMiPnlfe3R9PC9hbm5vdGF0aW9uPjwvc2VtYW50aWNzPjwvbWF0aD48L2ZvcmVpZ25vYmplY3Q+PC9nPjwvZz48L2c+PC9nPjxnIGZpbGw9IiMwMDAwMDAiIHN0cm9rZT0iIzAwMDAwMCIgdHJhbnNmb3JtPSJtYXRyaXgoMS4wIDAuMCAwLjAgMS4wIC04My4wMiAtMjMuOTEpIj48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAtMSAwIDQzLjU5NSkiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIDEgMCA0NS4zMykiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgMCkiPjxmb3JlaWdub2JqZWN0IGhlaWdodD0iOC40NSIgb3ZlcmZsb3c9InZpc2libGUiIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgMTYuNikiIHdpZHRoPSIxNy4xNiI+PG1hdGggYWx0dGV4dD0ieF97dC0xfSIgZGlzcGxheT0iaW5saW5lIiBpZD0iUzEuRjEuc2YxLnBpYzEuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEiPjxzZW1hbnRpY3MgaWQ9IlMxLkYxLnNmMS5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xYSI+PG1zdWIgaWQ9IlMxLkYxLnNmMS5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuY21tbCI+PG1pIGlkPSJTMS5GMS5zZjEucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMi5jbW1sIj54PC9taT48bXJvdyBpZD0iUzEuRjEuc2YxLnBpYzEuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zIiB4cmVmPSJTMS5GMS5zZjEucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuY21tbCI+PG1pIGlkPSJTMS5GMS5zZjEucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMiIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjIuY21tbCI+dDwvbWk+PG1vIGlkPSJTMS5GMS5zZjEucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMSIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjEuY21tbCI+4oiSPC9tbz48bW4gaWQ9IlMxLkYxLnNmMS5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4zIiB4cmVmPSJTMS5GMS5zZjEucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMy5jbW1sIj4xPC9tbj48L21yb3c+PC9tc3ViPjxhbm5vdGF0aW9uLXhtbCBlbmNvZGluZz0iTWF0aE1MLUNvbnRlbnQiIGlkPSJTMS5GMS5zZjEucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMWIiPjxhcHBseSBpZD0iUzEuRjEuc2YxLnBpYzEuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xIj48Y3N5bWJvbCBjZD0iYW1iaWd1b3VzIiBpZD0iUzEuRjEuc2YxLnBpYzEuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4xLmNtbWwiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEiPnN1YnNjcmlwdDwvY3N5bWJvbD48Y2kgaWQ9IlMxLkYxLnNmMS5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMi5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIiPvCdkaU8L2NpPjxhcHBseSBpZD0iUzEuRjEuc2YxLnBpYzEuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLmNtbWwiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMyI+PG1pbnVzIGlkPSJTMS5GMS5zZjEucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMSI+PC9taW51cz48Y2kgaWQ9IlMxLkYxLnNmMS5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4yLmNtbWwiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4yIj7wnZGhPC9jaT48Y24gaWQ9IlMxLkYxLnNmMS5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4zLmNtbWwiIHR5cGU9ImludGVnZXIiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4zIj4xPC9jbj48L2FwcGx5PjwvYXBwbHk+PC9hbm5vdGF0aW9uLXhtbD48YW5ub3RhdGlvbiBlbmNvZGluZz0iYXBwbGljYXRpb24veC10ZXgiIGlkPSJTMS5GMS5zZjEucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMWMiPnhfe3QtMX08L2Fubm90YXRpb24+PC9zZW1hbnRpY3M+PC9tYXRoPjwvZm9yZWlnbm9iamVjdD48L2c+PC9nPjwvZz48L2c+PHBhdGggZD0iTSAtNzkuMDUgNzMuNDMgaCA5LjIyIHYgNDguNTkgaCAtOS4yMiBaIiBzdHlsZT0iZmlsbDpub25lIiAvPjxwYXRoIGQ9Ik0gLTc5LjA1IDE2Ni45MyBoIDkuMjIgdiA0OC41OSBoIC05LjIyIFoiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PGcgZmlsbD0iIzAwMDAwMCIgc3Ryb2tlPSIjMDAwMDAwIiB0cmFuc2Zvcm09Im1hdHJpeCgxLjAgMC4wIDAuMCAxLjAgLTgyLjcgMjY1LjA0KSI+PGcgdHJhbnNmb3JtPSJtYXRyaXgoMSAwIDAgLTEgMCA0My42OTUpIj48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAxIDAgNDUuMzMpIj48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAtMSAwIDApIj48Zm9yZWlnbm9iamVjdCBoZWlnaHQ9IjguNjUiIG92ZXJmbG93PSJ2aXNpYmxlIiB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAtMSAwIDE2LjYpIiB3aWR0aD0iMTYuNTQiPjxtYXRoIGFsdHRleHQ9Inlfe3QtMX0iIGRpc3BsYXk9ImlubGluZSIgaWQ9IlMxLkYxLnNmMS5waWMxLjQuNC40LjQuNC40LjQuNC40LjQuNC40LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xIj48c2VtYW50aWNzIGlkPSJTMS5GMS5zZjEucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMWEiPjxtc3ViIGlkPSJTMS5GMS5zZjEucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xIiB4cmVmPSJTMS5GMS5zZjEucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLmNtbWwiPjxtaSBpZD0iUzEuRjEuc2YxLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4yIiB4cmVmPSJTMS5GMS5zZjEucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIuY21tbCI+eTwvbWk+PG1yb3cgaWQ9IlMxLkYxLnNmMS5waWMxLjQuNC40LjQuNC40LjQuNC40LjQuNC40LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMyIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLmNtbWwiPjxtaSBpZD0iUzEuRjEuc2YxLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjIiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjQuNC40LjQuNC40LjQuNC40LjQuNC40LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4yLmNtbWwiPnQ8L21pPjxtbyBpZD0iUzEuRjEuc2YxLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjEiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjQuNC40LjQuNC40LjQuNC40LjQuNC40LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4xLmNtbWwiPuKIkjwvbW8+PG1uIGlkPSJTMS5GMS5zZjEucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMyIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjMuY21tbCI+MTwvbW4+PC9tcm93PjwvbXN1Yj48YW5ub3RhdGlvbi14bWwgZW5jb2Rpbmc9Ik1hdGhNTC1Db250ZW50IiBpZD0iUzEuRjEuc2YxLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjFiIj48YXBwbHkgaWQ9IlMxLkYxLnNmMS5waWMxLjQuNC40LjQuNC40LjQuNC40LjQuNC40LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuY21tbCIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMSI+PGNzeW1ib2wgY2Q9ImFtYmlndW91cyIgaWQ9IlMxLkYxLnNmMS5waWMxLjQuNC40LjQuNC40LjQuNC40LjQuNC40LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xIj5zdWJzY3JpcHQ8L2NzeW1ib2w+PGNpIGlkPSJTMS5GMS5zZjEucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIuY21tbCIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4yIj7wnZGmPC9jaT48YXBwbHkgaWQ9IlMxLkYxLnNmMS5waWMxLjQuNC40LjQuNC40LjQuNC40LjQuNC40LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMiPjxtaW51cyBpZD0iUzEuRjEuc2YxLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjEuY21tbCIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjEiPjwvbWludXM+PGNpIGlkPSJTMS5GMS5zZjEucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMi5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMiI+8J2RoTwvY2k+PGNuIGlkPSJTMS5GMS5zZjEucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMy5jbW1sIiB0eXBlPSJpbnRlZ2VyIiB4cmVmPSJTMS5GMS5zZjEucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMyI+MTwvY24+PC9hcHBseT48L2FwcGx5PjwvYW5ub3RhdGlvbi14bWw+PGFubm90YXRpb24gZW5jb2Rpbmc9ImFwcGxpY2F0aW9uL3gtdGV4IiBpZD0iUzEuRjEuc2YxLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjFjIj55X3t0LTF9PC9hbm5vdGF0aW9uPjwvc2VtYW50aWNzPjwvbWF0aD48L2ZvcmVpZ25vYmplY3Q+PC9nPjwvZz48L2c+PC9nPjxnIGZpbGw9IiMwMDAwMDAiIHN0cm9rZT0iIzAwMDAwMCIgdHJhbnNmb3JtPSJtYXRyaXgoMS4wIDAuMCAwLjAgMS4wIDY1Ljg1IC0yNC4yNCkiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgNDMuOTIpIj48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAxIDAgNDUuMzMpIj48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAtMSAwIDApIj48Zm9yZWlnbm9iamVjdCBoZWlnaHQ9IjkuMSIgb3ZlcmZsb3c9InZpc2libGUiIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgMTYuNikiIHdpZHRoPSIyMC42MSI+PG1hdGggYWx0dGV4dD0ieF97dCsxfSIgZGlzcGxheT0iaW5saW5lIiBpZD0iUzEuRjEuc2YxLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEiPjxzZW1hbnRpY3MgaWQ9IlMxLkYxLnNmMS5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xYSI+PG1zdWIgaWQ9IlMxLkYxLnNmMS5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuY21tbCI+PG1pIGlkPSJTMS5GMS5zZjEucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMi5jbW1sIj54PC9taT48bXJvdyBpZD0iUzEuRjEuc2YxLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zIiB4cmVmPSJTMS5GMS5zZjEucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuY21tbCI+PG1pIGlkPSJTMS5GMS5zZjEucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMiIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjIuY21tbCI+dDwvbWk+PG1vIGlkPSJTMS5GMS5zZjEucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMSIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjEuY21tbCI+KzwvbW8+PG1uIGlkPSJTMS5GMS5zZjEucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMyIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjMuY21tbCI+MTwvbW4+PC9tcm93PjwvbXN1Yj48YW5ub3RhdGlvbi14bWwgZW5jb2Rpbmc9Ik1hdGhNTC1Db250ZW50IiBpZD0iUzEuRjEuc2YxLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjFiIj48YXBwbHkgaWQ9IlMxLkYxLnNmMS5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuY21tbCIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMSI+PGNzeW1ib2wgY2Q9ImFtYmlndW91cyIgaWQ9IlMxLkYxLnNmMS5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xIj5zdWJzY3JpcHQ8L2NzeW1ib2w+PGNpIGlkPSJTMS5GMS5zZjEucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIuY21tbCIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4yIj7wnZGlPC9jaT48YXBwbHkgaWQ9IlMxLkYxLnNmMS5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMiPjxwbHVzIGlkPSJTMS5GMS5zZjEucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMSI+PC9wbHVzPjxjaSBpZD0iUzEuRjEuc2YxLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjIuY21tbCIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjIiPvCdkaE8L2NpPjxjbiBpZD0iUzEuRjEuc2YxLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjMuY21tbCIgdHlwZT0iaW50ZWdlciIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjMiPjE8L2NuPjwvYXBwbHk+PC9hcHBseT48L2Fubm90YXRpb24teG1sPjxhbm5vdGF0aW9uIGVuY29kaW5nPSJhcHBsaWNhdGlvbi94LXRleCIgaWQ9IlMxLkYxLnNmMS5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xYyI+eF97dCsxfTwvYW5ub3RhdGlvbj48L3NlbWFudGljcz48L21hdGg+PC9mb3JlaWdub2JqZWN0PjwvZz48L2c+PC9nPjwvZz48cGF0aCBkPSJNIDcxLjU0IDczLjc1IGggOS4yMiB2IDQ4LjU5IGggLTkuMjIgWiIgc3R5bGU9ImZpbGw6bm9uZSIgLz48cGF0aCBkPSJNIDcxLjU0IDE2Ny4yNSBoIDkuMjIgdiA0OC41OSBoIC05LjIyIFoiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PGcgZmlsbD0iIzAwMDAwMCIgc3Ryb2tlPSIjMDAwMDAwIiB0cmFuc2Zvcm09Im1hdHJpeCgxLjAgMC4wIDAuMCAxLjAgNjYuMTcgMjY1LjM2KSI+PGcgdHJhbnNmb3JtPSJtYXRyaXgoMSAwIDAgLTEgMCA0My45MikiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIDEgMCA0NS4zMykiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgMCkiPjxmb3JlaWdub2JqZWN0IGhlaWdodD0iOS4xIiBvdmVyZmxvdz0idmlzaWJsZSIgdHJhbnNmb3JtPSJtYXRyaXgoMSAwIDAgLTEgMCAxNi42KSIgd2lkdGg9IjE5Ljk4Ij48bWF0aCBhbHR0ZXh0PSJ5X3t0KzF9IiBkaXNwbGF5PSJpbmxpbmUiIGlkPSJTMS5GMS5zZjEucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMSI+PHNlbWFudGljcyBpZD0iUzEuRjEuc2YxLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjFhIj48bXN1YiBpZD0iUzEuRjEuc2YxLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMSIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS5jbW1sIj48bWkgaWQ9IlMxLkYxLnNmMS5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMiIgeHJlZj0iUzEuRjEuc2YxLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4yLmNtbWwiPnk8L21pPjxtcm93IGlkPSJTMS5GMS5zZjEucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy5jbW1sIj48bWkgaWQ9IlMxLkYxLnNmMS5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4yIiB4cmVmPSJTMS5GMS5zZjEucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMi5jbW1sIj50PC9taT48bW8gaWQ9IlMxLkYxLnNmMS5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4xIiB4cmVmPSJTMS5GMS5zZjEucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMS5jbW1sIj4rPC9tbz48bW4gaWQ9IlMxLkYxLnNmMS5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4zIiB4cmVmPSJTMS5GMS5zZjEucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMy5jbW1sIj4xPC9tbj48L21yb3c+PC9tc3ViPjxhbm5vdGF0aW9uLXhtbCBlbmNvZGluZz0iTWF0aE1MLUNvbnRlbnQiIGlkPSJTMS5GMS5zZjEucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMWIiPjxhcHBseSBpZD0iUzEuRjEuc2YxLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xIj48Y3N5bWJvbCBjZD0iYW1iaWd1b3VzIiBpZD0iUzEuRjEuc2YxLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4xLmNtbWwiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEiPnN1YnNjcmlwdDwvY3N5bWJvbD48Y2kgaWQ9IlMxLkYxLnNmMS5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMi5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIiPvCdkaY8L2NpPjxhcHBseSBpZD0iUzEuRjEuc2YxLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLmNtbWwiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMyI+PHBsdXMgaWQ9IlMxLkYxLnNmMS5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4xLmNtbWwiIHhyZWY9IlMxLkYxLnNmMS5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4xIj48L3BsdXM+PGNpIGlkPSJTMS5GMS5zZjEucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMi5jbW1sIiB4cmVmPSJTMS5GMS5zZjEucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMiI+8J2RoTwvY2k+PGNuIGlkPSJTMS5GMS5zZjEucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMy5jbW1sIiB0eXBlPSJpbnRlZ2VyIiB4cmVmPSJTMS5GMS5zZjEucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMyI+MTwvY24+PC9hcHBseT48L2FwcGx5PjwvYW5ub3RhdGlvbi14bWw+PGFubm90YXRpb24gZW5jb2Rpbmc9ImFwcGxpY2F0aW9uL3gtdGV4IiBpZD0iUzEuRjEuc2YxLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjFjIj55X3t0KzF9PC9hbm5vdGF0aW9uPjwvc2VtYW50aWNzPjwvbWF0aD48L2ZvcmVpZ25vYmplY3Q+PC9nPjwvZz48L2c+PC9nPjxnIHN0cm9rZT0iIzAwMDBGRiI+PGcgc3Ryb2tlLXdpZHRoPSIxLjZwdCI+PHBhdGggZD0iTSAtNzQuNDMgMzEuMjkgTCAtNzQuNDMgNjguOTkiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjxnIHN0cm9rZS1kYXNoYXJyYXk9Im5vbmUiIHN0cm9rZS1kYXNob2Zmc2V0PSIwLjBwdCIgc3Ryb2tlLWxpbmVjYXA9InJvdW5kIiBzdHJva2UtbGluZWpvaW49InJvdW5kIiBzdHJva2Utd2lkdGg9IjEuMjhwdCIgdHJhbnNmb3JtPSJtYXRyaXgoMC4wIDEuMCAtMS4wIDAuMCAtNzQuNDMgNjguOTkpIj48cGF0aCBkPSJNIC0zLjE1IDQuMjEgQyAtMi44OSAyLjYzIDAgMC4yNiAwLjc5IDAgQyAwIC0wLjI2IC0yLjg5IC0yLjYzIC0zLjE1IC00LjIxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48L2c+PGcgc3Ryb2tlPSIjRkY4MDAwIj48ZyBzdHJva2Utd2lkdGg9IjEuNnB0Ij48cGF0aCBkPSJNIDAgMTcuNjIgTCAwIDU1LjMyIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48ZyBzdHJva2UtZGFzaGFycmF5PSJub25lIiBzdHJva2UtZGFzaG9mZnNldD0iMC4wcHQiIHN0cm9rZS1saW5lY2FwPSJyb3VuZCIgc3Ryb2tlLWxpbmVqb2luPSJyb3VuZCIgc3Ryb2tlLXdpZHRoPSIxLjI4cHQiIHRyYW5zZm9ybT0ibWF0cml4KDAuMCAxLjAgLTEuMCAwLjAgMCA1NS4zMikiPjxwYXRoIGQ9Ik0gLTMuMTUgNC4yMSBDIC0yLjg5IDIuNjMgMCAwLjI2IDAuNzkgMCBDIDAgLTAuMjYgLTIuODkgLTIuNjMgLTMuMTUgLTQuMjEiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjwvZz48ZyBzdHJva2U9IiM4MDgwODAiPjxnIHN0cm9rZS13aWR0aD0iMS42cHQiPjxwYXRoIGQ9Ik0gNzYuMTYgMzEuNjEgTCA3Ni4xNiA2OS4zMSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0ibm9uZSIgc3Ryb2tlLWRhc2hvZmZzZXQ9IjAuMHB0IiBzdHJva2UtbGluZWNhcD0icm91bmQiIHN0cm9rZS1saW5lam9pbj0icm91bmQiIHN0cm9rZS13aWR0aD0iMS4yOHB0IiB0cmFuc2Zvcm09Im1hdHJpeCgwLjAgMS4wIC0xLjAgMC4wIDc2LjE2IDY5LjMxKSI+PHBhdGggZD0iTSAtMy4xNSA0LjIxIEMgLTIuODkgMi42MyAwIDAuMjYgMC43OSAwIEMgMCAtMC4yNiAtMi44OSAtMi42MyAtMy4xNSAtNC4yMSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PC9nPjxnIHN0cm9rZT0iIzAwRkYwMCI+PGcgc3Ryb2tlLXdpZHRoPSIxLjZwdCI+PHBhdGggZD0iTSAtNzQuNDMgMTI0Ljc5IEwgLTc0LjQzIDE2Mi40OSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0ibm9uZSIgc3Ryb2tlLWRhc2hvZmZzZXQ9IjAuMHB0IiBzdHJva2UtbGluZWNhcD0icm91bmQiIHN0cm9rZS1saW5lam9pbj0icm91bmQiIHN0cm9rZS13aWR0aD0iMS4yOHB0IiB0cmFuc2Zvcm09Im1hdHJpeCgwLjAgMS4wIC0xLjAgMC4wIC03NC40MyAxNjIuNDkpIj48cGF0aCBkPSJNIC0zLjE1IDQuMjEgQyAtMi44OSAyLjYzIDAgMC4yNiAwLjc5IDAgQyAwIC0wLjI2IC0yLjg5IC0yLjYzIC0zLjE1IC00LjIxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48L2c+PGcgc3Ryb2tlPSIjQkYwMDQwIj48ZyBzdHJva2Utd2lkdGg9IjEuNnB0Ij48cGF0aCBkPSJNIDAgMTExLjEyIEwgMCAxNDguODIiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjxnIHN0cm9rZS1kYXNoYXJyYXk9Im5vbmUiIHN0cm9rZS1kYXNob2Zmc2V0PSIwLjBwdCIgc3Ryb2tlLWxpbmVjYXA9InJvdW5kIiBzdHJva2UtbGluZWpvaW49InJvdW5kIiBzdHJva2Utd2lkdGg9IjEuMjhwdCIgdHJhbnNmb3JtPSJtYXRyaXgoMC4wIDEuMCAtMS4wIDAuMCAwIDE0OC44MikiPjxwYXRoIGQ9Ik0gLTMuMTUgNC4yMSBDIC0yLjg5IDIuNjMgMCAwLjI2IDAuNzkgMCBDIDAgLTAuMjYgLTIuODkgLTIuNjMgLTMuMTUgLTQuMjEiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjwvZz48ZyBzdHJva2U9IiNGRkZGMDAiPjxnIHN0cm9rZS13aWR0aD0iMS42cHQiPjxwYXRoIGQ9Ik0gNzYuMTYgMTI1LjExIEwgNzYuMTYgMTYyLjgxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48ZyBzdHJva2UtZGFzaGFycmF5PSJub25lIiBzdHJva2UtZGFzaG9mZnNldD0iMC4wcHQiIHN0cm9rZS1saW5lY2FwPSJyb3VuZCIgc3Ryb2tlLWxpbmVqb2luPSJyb3VuZCIgc3Ryb2tlLXdpZHRoPSIxLjI4cHQiIHRyYW5zZm9ybT0ibWF0cml4KDAuMCAxLjAgLTEuMCAwLjAgNzYuMTYgMTYyLjgxKSI+PHBhdGggZD0iTSAtMy4xNSA0LjIxIEMgLTIuODkgMi42MyAwIDAuMjYgMC43OSAwIEMgMCAtMC4yNiAtMi44OSAtMi42MyAtMy4xNSAtNC4yMSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PC9nPjxnIHN0cm9rZT0iI0ZGMDAwMCI+PGcgc3Ryb2tlLXdpZHRoPSIxLjZwdCI+PHBhdGggZD0iTSAtNzQuNDMgMjE4LjI5IEwgLTc0LjQzIDI1NS45OCIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0ibm9uZSIgc3Ryb2tlLWRhc2hvZmZzZXQ9IjAuMHB0IiBzdHJva2UtbGluZWNhcD0icm91bmQiIHN0cm9rZS1saW5lam9pbj0icm91bmQiIHN0cm9rZS13aWR0aD0iMS4yOHB0IiB0cmFuc2Zvcm09Im1hdHJpeCgwLjAgMS4wIC0xLjAgMC4wIC03NC40MyAyNTUuOTgpIj48cGF0aCBkPSJNIC0zLjE1IDQuMjEgQyAtMi44OSAyLjYzIDAgMC4yNiAwLjc5IDAgQyAwIC0wLjI2IC0yLjg5IC0yLjYzIC0zLjE1IC00LjIxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48L2c+PGcgc3Ryb2tlPSIjMDBGRkZGIj48ZyBzdHJva2Utd2lkdGg9IjEuNnB0Ij48cGF0aCBkPSJNIDAgMjA0LjYyIEwgMCAyNDIuMzIiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjxnIHN0cm9rZS1kYXNoYXJyYXk9Im5vbmUiIHN0cm9rZS1kYXNob2Zmc2V0PSIwLjBwdCIgc3Ryb2tlLWxpbmVjYXA9InJvdW5kIiBzdHJva2UtbGluZWpvaW49InJvdW5kIiBzdHJva2Utd2lkdGg9IjEuMjhwdCIgdHJhbnNmb3JtPSJtYXRyaXgoMC4wIDEuMCAtMS4wIDAuMCAwIDI0Mi4zMikiPjxwYXRoIGQ9Ik0gLTMuMTUgNC4yMSBDIC0yLjg5IDIuNjMgMCAwLjI2IDAuNzkgMCBDIDAgLTAuMjYgLTIuODkgLTIuNjMgLTMuMTUgLTQuMjEiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjwvZz48ZyBzdHJva2U9IiNGRjAwRkYiPjxnIHN0cm9rZS13aWR0aD0iMS42cHQiPjxwYXRoIGQ9Ik0gNzYuMTYgMjE4LjYxIEwgNzYuMTYgMjU2LjMxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48ZyBzdHJva2UtZGFzaGFycmF5PSJub25lIiBzdHJva2UtZGFzaG9mZnNldD0iMC4wcHQiIHN0cm9rZS1saW5lY2FwPSJyb3VuZCIgc3Ryb2tlLWxpbmVqb2luPSJyb3VuZCIgc3Ryb2tlLXdpZHRoPSIxLjI4cHQiIHRyYW5zZm9ybT0ibWF0cml4KDAuMCAxLjAgLTEuMCAwLjAgNzYuMTYgMjU2LjMxKSI+PHBhdGggZD0iTSAtMy4xNSA0LjIxIEMgLTIuODkgMi42MyAwIDAuMjYgMC43OSAwIEMgMCAtMC4yNiAtMi44OSAtMi42MyAtMy4xNSAtNC4yMSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PC9nPjxnIHN0cm9rZS1kYXNoYXJyYXk9IjMuMHB0LDMuMHB0IiBzdHJva2UtZGFzaG9mZnNldD0iMC4wcHQiPjxwYXRoIGQ9Ik0gLTEyMS4xOCA5Ny43MyBMIC04Mi40NSA5Ny43MyIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0ibm9uZSIgc3Ryb2tlLWRhc2hvZmZzZXQ9IjAuMHB0IiBzdHJva2UtbGluZWNhcD0icm91bmQiIHN0cm9rZS1saW5lam9pbj0icm91bmQiIHN0cm9rZS13aWR0aD0iMC4zMnB0IiB0cmFuc2Zvcm09Im1hdHJpeCgxLjAgMC4wIDAuMCAxLjAgLTgyLjQ1IDk3LjczKSI+PHBhdGggZD0iTSAtMS42NiAyLjIxIEMgLTEuNTIgMS4zOCAwIDAuMTQgMC40MiAwIEMgMCAtMC4xNCAtMS41MiAtMS4zOCAtMS42NiAtMi4yMSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0iMy4wcHQsMy4wcHQiIHN0cm9rZS1kYXNob2Zmc2V0PSIwLjBwdCI+PHBhdGggZD0iTSAtNjcuMDUgOTYuMzcgTCAtOC4wMSA4NS41MyIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0ibm9uZSIgc3Ryb2tlLWRhc2hvZmZzZXQ9IjAuMHB0IiBzdHJva2UtbGluZWNhcD0icm91bmQiIHN0cm9rZS1saW5lam9pbj0icm91bmQiIHN0cm9rZS13aWR0aD0iMC4zMnB0IiB0cmFuc2Zvcm09Im1hdHJpeCgwLjk4MzU1IC0wLjE4MDYzIDAuMTgwNjMgMC45ODM1NSAtOC4wMSA4NS41MykiPjxwYXRoIGQ9Ik0gLTEuNjYgMi4yMSBDIC0xLjUyIDEuMzggMCAwLjE0IDAuNDIgMCBDIDAgLTAuMTQgLTEuNTIgLTEuMzggLTEuNjYgLTIuMjEiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjxnIHN0cm9rZS1kYXNoYXJyYXk9IjMuMHB0LDMuMHB0IiBzdHJva2UtZGFzaG9mZnNldD0iMC4wcHQiPjxwYXRoIGQ9Ik0gNy4zOCA4NS40MSBMIDY4LjE1IDk2LjU4IiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48ZyBzdHJva2UtZGFzaGFycmF5PSJub25lIiBzdHJva2UtZGFzaG9mZnNldD0iMC4wcHQiIHN0cm9rZS1saW5lY2FwPSJyb3VuZCIgc3Ryb2tlLWxpbmVqb2luPSJyb3VuZCIgc3Ryb2tlLXdpZHRoPSIwLjMycHQiIHRyYW5zZm9ybT0ibWF0cml4KDAuOTgzNTQgMC4xODA3MyAtMC4xODA3MyAwLjk4MzU0IDY4LjE1IDk2LjU4KSI+PHBhdGggZD0iTSAtMS42NiAyLjIxIEMgLTEuNTIgMS4zOCAwIDAuMTQgMC40MiAwIEMgMCAtMC4xNCAtMS41MiAtMS4zOCAtMS42NiAtMi4yMSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0iMy4wcHQsMy4wcHQiIHN0cm9rZS1kYXNob2Zmc2V0PSIwLjBwdCI+PHBhdGggZD0iTSA4My41MyA5OC4wNSBMIDEyMi4yNyA5OC4wNSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0ibm9uZSIgc3Ryb2tlLWRhc2hvZmZzZXQ9IjAuMHB0IiBzdHJva2UtbGluZWNhcD0icm91bmQiIHN0cm9rZS1saW5lam9pbj0icm91bmQiIHN0cm9rZS13aWR0aD0iMC4zMnB0IiB0cmFuc2Zvcm09Im1hdHJpeCgxLjAgMC4wIDAuMCAxLjAgMTIyLjI3IDk4LjA1KSI+PHBhdGggZD0iTSAtMS42NiAyLjIxIEMgLTEuNTIgMS4zOCAwIDAuMTQgMC40MiAwIEMgMCAtMC4xNCAtMS41MiAtMS4zOCAtMS42NiAtMi4yMSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0iMy4wcHQsMy4wcHQiIHN0cm9rZS1kYXNob2Zmc2V0PSIwLjBwdCI+PHBhdGggZD0iTSAtMTIxLjE4IDE5MS4yMiBMIC04Mi40NSAxOTEuMjIiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjxnIHN0cm9rZS1kYXNoYXJyYXk9Im5vbmUiIHN0cm9rZS1kYXNob2Zmc2V0PSIwLjBwdCIgc3Ryb2tlLWxpbmVjYXA9InJvdW5kIiBzdHJva2UtbGluZWpvaW49InJvdW5kIiBzdHJva2Utd2lkdGg9IjAuMzJwdCIgdHJhbnNmb3JtPSJtYXRyaXgoMS4wIDAuMCAwLjAgMS4wIC04Mi40NSAxOTEuMjIpIj48cGF0aCBkPSJNIC0xLjY2IDIuMjEgQyAtMS41MiAxLjM4IDAgMC4xNCAwLjQyIDAgQyAwIC0wLjE0IC0xLjUyIC0xLjM4IC0xLjY2IC0yLjIxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48ZyBzdHJva2UtZGFzaGFycmF5PSIzLjBwdCwzLjBwdCIgc3Ryb2tlLWRhc2hvZmZzZXQ9IjAuMHB0Ij48cGF0aCBkPSJNIC02Ny4wNSAxODkuODcgTCAtOC4wMSAxNzkuMDMiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjxnIHN0cm9rZS1kYXNoYXJyYXk9Im5vbmUiIHN0cm9rZS1kYXNob2Zmc2V0PSIwLjBwdCIgc3Ryb2tlLWxpbmVjYXA9InJvdW5kIiBzdHJva2UtbGluZWpvaW49InJvdW5kIiBzdHJva2Utd2lkdGg9IjAuMzJwdCIgdHJhbnNmb3JtPSJtYXRyaXgoMC45ODM1NSAtMC4xODA2MyAwLjE4MDYzIDAuOTgzNTUgLTguMDEgMTc5LjAzKSI+PHBhdGggZD0iTSAtMS42NiAyLjIxIEMgLTEuNTIgMS4zOCAwIDAuMTQgMC40MiAwIEMgMCAtMC4xNCAtMS41MiAtMS4zOCAtMS42NiAtMi4yMSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0iMy4wcHQsMy4wcHQiIHN0cm9rZS1kYXNob2Zmc2V0PSIwLjBwdCI+PHBhdGggZD0iTSA3LjM4IDE3OC45MSBMIDY4LjE1IDE5MC4wOCIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0ibm9uZSIgc3Ryb2tlLWRhc2hvZmZzZXQ9IjAuMHB0IiBzdHJva2UtbGluZWNhcD0icm91bmQiIHN0cm9rZS1saW5lam9pbj0icm91bmQiIHN0cm9rZS13aWR0aD0iMC4zMnB0IiB0cmFuc2Zvcm09Im1hdHJpeCgwLjk4MzU0IDAuMTgwNzMgLTAuMTgwNzMgMC45ODM1NCA2OC4xNSAxOTAuMDgpIj48cGF0aCBkPSJNIC0xLjY2IDIuMjEgQyAtMS41MiAxLjM4IDAgMC4xNCAwLjQyIDAgQyAwIC0wLjE0IC0xLjUyIC0xLjM4IC0xLjY2IC0yLjIxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48ZyBzdHJva2UtZGFzaGFycmF5PSIzLjBwdCwzLjBwdCIgc3Ryb2tlLWRhc2hvZmZzZXQ9IjAuMHB0Ij48cGF0aCBkPSJNIDgzLjUzIDE5MS41NSBMIDEyMi4yNyAxOTEuNTUiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjwvZz48ZyBzdHJva2UtZGFzaGFycmF5PSJub25lIiBzdHJva2UtZGFzaG9mZnNldD0iMC4wcHQiIHN0cm9rZS1saW5lY2FwPSJyb3VuZCIgc3Ryb2tlLWxpbmVqb2luPSJyb3VuZCIgc3Ryb2tlLXdpZHRoPSIwLjMycHQiIHRyYW5zZm9ybT0ibWF0cml4KDEuMCAwLjAgMC4wIDEuMCAxMjIuMjcgMTkxLjU1KSI+PHBhdGggZD0iTSAtMS42NiAyLjIxIEMgLTEuNTIgMS4zOCAwIDAuMTQgMC40MiAwIEMgMCAtMC4xNCAtMS41MiAtMS4zOCAtMS42NiAtMi4yMSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PC9nPjwvc3ZnPg==]]

[[File:data:image/svg+xml;base64,PHN2ZyBoZWlnaHQ9IjM0Ny4yOSIgaWQ9IlMxLkYxLnNmMi5waWMxIiBvdmVyZmxvdz0idmlzaWJsZSIgdmVyc2lvbj0iMS4xIiB3aWR0aD0iMjYzLjA5Ij48ZyBmaWxsPSIjMDAwMDAwIiBzdHJva2U9IiMwMDAwMDAiIHN0cm9rZS13aWR0aD0iMC40cHQiIHRyYW5zZm9ybT0idHJhbnNsYXRlKDAsMzQ3LjI5KSBtYXRyaXgoMSAwIDAgLTEgMCAwKSB0cmFuc2xhdGUoMTMwLjY4LDApIHRyYW5zbGF0ZSgwLDI4Ljg1KSI+PGcgZmlsbD0iIzAwMDAwMCIgc3Ryb2tlPSIjMDAwMDAwIiB0cmFuc2Zvcm09Im1hdHJpeCgxLjAgMC4wIDAuMCAxLjAgLTExLjcyIC0xMC4yNCkiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgMTYuMzIpIj48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAxIDAgOS40NikiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgMCkiPjxmb3JlaWdub2JqZWN0IGhlaWdodD0iMTIuMTUiIG92ZXJmbG93PSJ2aXNpYmxlIiB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAtMSAwIDE2LjYpIiB3aWR0aD0iMjMuNDUiPlxwZ2ZtYXRocmVzdWx0cHQ8L2ZvcmVpZ25vYmplY3Q+PC9nPjwvZz48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAxIDAgMTguMTEpIj48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAtMSA2LjM3IDApIj48Zm9yZWlnbm9iamVjdCBoZWlnaHQ9IjguMzQiIG92ZXJmbG93PSJ2aXNpYmxlIiB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAtMSAwIDE2LjYpIiB3aWR0aD0iMTAuNzEiPjxtYXRoIGFsdHRleHQ9Inhfe3R9IiBkaXNwbGF5PSJpbmxpbmUiIGlkPSJTMS5GMS5zZjIucGljMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMSI+PHNlbWFudGljcyBpZD0iUzEuRjEuc2YyLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjFhIj48bXN1YiBpZD0iUzEuRjEuc2YyLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMSIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS5jbW1sIj48bWkgaWQ9IlMxLkYxLnNmMi5waWMxLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMiIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4yLmNtbWwiPng8L21pPjxtaSBpZD0iUzEuRjEuc2YyLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zIiB4cmVmPSJTMS5GMS5zZjIucGljMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuY21tbCI+dDwvbWk+PC9tc3ViPjxhbm5vdGF0aW9uLXhtbCBlbmNvZGluZz0iTWF0aE1MLUNvbnRlbnQiIGlkPSJTMS5GMS5zZjIucGljMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMWIiPjxhcHBseSBpZD0iUzEuRjEuc2YyLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xIj48Y3N5bWJvbCBjZD0iYW1iaWd1b3VzIiBpZD0iUzEuRjEuc2YyLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4xLmNtbWwiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEiPnN1YnNjcmlwdDwvY3N5bWJvbD48Y2kgaWQ9IlMxLkYxLnNmMi5waWMxLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMi5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIiPvCdkaU8L2NpPjxjaSBpZD0iUzEuRjEuc2YyLnBpYzEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLmNtbWwiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMyI+8J2RoTwvY2k+PC9hcHBseT48L2Fubm90YXRpb24teG1sPjxhbm5vdGF0aW9uIGVuY29kaW5nPSJhcHBsaWNhdGlvbi94LXRleCIgaWQ9IlMxLkYxLnNmMi5waWMxLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xYyI+eF97dH08L2Fubm90YXRpb24+PC9zZW1hbnRpY3M+PC9tYXRoPjwvZm9yZWlnbm9iamVjdD48L2c+PC9nPjwvZz48L2c+PHBhdGggZD0iTSAtNC42MSA1OS43NiBoIDkuMjIgdiA0OC41OSBoIC05LjIyIFoiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PHBhdGggZD0iTSAtNC42MSAxNTMuMjYgaCA5LjIyIHYgNDguNTkgaCAtOS4yMiBaIiBzdHlsZT0iZmlsbDpub25lIiAvPjxnIGZpbGw9IiMwMDAwMDAiIHN0cm9rZT0iIzAwMDAwMCIgdHJhbnNmb3JtPSJtYXRyaXgoMS4wIDAuMCAwLjAgMS4wIC01LjA0IDI1MS4zNykiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgNDMuNjk1KSI+PGcgdHJhbnNmb3JtPSJtYXRyaXgoMSAwIDAgMSAwIDQ1LjMzKSI+PGcgdHJhbnNmb3JtPSJtYXRyaXgoMSAwIDAgLTEgMCAwKSI+PGZvcmVpZ25vYmplY3QgaGVpZ2h0PSI4LjY1IiBvdmVyZmxvdz0idmlzaWJsZSIgdHJhbnNmb3JtPSJtYXRyaXgoMSAwIDAgLTEgMCAxNi42KSIgd2lkdGg9IjEwLjA4Ij48bWF0aCBhbHR0ZXh0PSJ5X3t0fSIgZGlzcGxheT0iaW5saW5lIiBpZD0iUzEuRjEuc2YyLnBpYzEuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEiPjxzZW1hbnRpY3MgaWQ9IlMxLkYxLnNmMi5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xYSI+PG1zdWIgaWQ9IlMxLkYxLnNmMi5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuY21tbCI+PG1pIGlkPSJTMS5GMS5zZjIucGljMS4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMi5jbW1sIj55PC9taT48bWkgaWQ9IlMxLkYxLnNmMi5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMyIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLmNtbWwiPnQ8L21pPjwvbXN1Yj48YW5ub3RhdGlvbi14bWwgZW5jb2Rpbmc9Ik1hdGhNTC1Db250ZW50IiBpZD0iUzEuRjEuc2YyLnBpYzEuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjFiIj48YXBwbHkgaWQ9IlMxLkYxLnNmMi5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuY21tbCIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMSI+PGNzeW1ib2wgY2Q9ImFtYmlndW91cyIgaWQ9IlMxLkYxLnNmMi5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xIj5zdWJzY3JpcHQ8L2NzeW1ib2w+PGNpIGlkPSJTMS5GMS5zZjIucGljMS4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIuY21tbCIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4yIj7wnZGmPC9jaT48Y2kgaWQ9IlMxLkYxLnNmMi5waWMxLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4yLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMiPvCdkaE8L2NpPjwvYXBwbHk+PC9hbm5vdGF0aW9uLXhtbD48YW5ub3RhdGlvbiBlbmNvZGluZz0iYXBwbGljYXRpb24veC10ZXgiIGlkPSJTMS5GMS5zZjIucGljMS4yLjIuMi4yLjIuMi4yLjIuMi4yLjIuMi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMWMiPnlfe3R9PC9hbm5vdGF0aW9uPjwvc2VtYW50aWNzPjwvbWF0aD48L2ZvcmVpZ25vYmplY3Q+PC9nPjwvZz48L2c+PC9nPjxnIGZpbGw9IiMwMDAwMDAiIHN0cm9rZT0iIzAwMDAwMCIgdHJhbnNmb3JtPSJtYXRyaXgoMS4wIDAuMCAwLjAgMS4wIC04My4wMiAtMjMuOTEpIj48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAtMSAwIDQzLjU5NSkiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIDEgMCA0NS4zMykiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgMCkiPjxmb3JlaWdub2JqZWN0IGhlaWdodD0iOC40NSIgb3ZlcmZsb3c9InZpc2libGUiIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgMTYuNikiIHdpZHRoPSIxNy4xNiI+PG1hdGggYWx0dGV4dD0ieF97dC0xfSIgZGlzcGxheT0iaW5saW5lIiBpZD0iUzEuRjEuc2YyLnBpYzEuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEiPjxzZW1hbnRpY3MgaWQ9IlMxLkYxLnNmMi5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xYSI+PG1zdWIgaWQ9IlMxLkYxLnNmMi5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuY21tbCI+PG1pIGlkPSJTMS5GMS5zZjIucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMi5jbW1sIj54PC9taT48bXJvdyBpZD0iUzEuRjEuc2YyLnBpYzEuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zIiB4cmVmPSJTMS5GMS5zZjIucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuY21tbCI+PG1pIGlkPSJTMS5GMS5zZjIucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMiIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjIuY21tbCI+dDwvbWk+PG1vIGlkPSJTMS5GMS5zZjIucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMSIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjEuY21tbCI+4oiSPC9tbz48bW4gaWQ9IlMxLkYxLnNmMi5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4zIiB4cmVmPSJTMS5GMS5zZjIucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMy5jbW1sIj4xPC9tbj48L21yb3c+PC9tc3ViPjxhbm5vdGF0aW9uLXhtbCBlbmNvZGluZz0iTWF0aE1MLUNvbnRlbnQiIGlkPSJTMS5GMS5zZjIucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMWIiPjxhcHBseSBpZD0iUzEuRjEuc2YyLnBpYzEuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xIj48Y3N5bWJvbCBjZD0iYW1iaWd1b3VzIiBpZD0iUzEuRjEuc2YyLnBpYzEuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4xLmNtbWwiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEiPnN1YnNjcmlwdDwvY3N5bWJvbD48Y2kgaWQ9IlMxLkYxLnNmMi5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMi5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIiPvCdkaU8L2NpPjxhcHBseSBpZD0iUzEuRjEuc2YyLnBpYzEuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLmNtbWwiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMyI+PG1pbnVzIGlkPSJTMS5GMS5zZjIucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMSI+PC9taW51cz48Y2kgaWQ9IlMxLkYxLnNmMi5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4yLmNtbWwiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4yIj7wnZGhPC9jaT48Y24gaWQ9IlMxLkYxLnNmMi5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4zLmNtbWwiIHR5cGU9ImludGVnZXIiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4zLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4zIj4xPC9jbj48L2FwcGx5PjwvYXBwbHk+PC9hbm5vdGF0aW9uLXhtbD48YW5ub3RhdGlvbiBlbmNvZGluZz0iYXBwbGljYXRpb24veC10ZXgiIGlkPSJTMS5GMS5zZjIucGljMS4zLjMuMy4zLjMuMy4zLjMuMy4zLjMuMy4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMWMiPnhfe3QtMX08L2Fubm90YXRpb24+PC9zZW1hbnRpY3M+PC9tYXRoPjwvZm9yZWlnbm9iamVjdD48L2c+PC9nPjwvZz48L2c+PHBhdGggZD0iTSAtNzkuMDUgNzMuNDMgaCA5LjIyIHYgNDguNTkgaCAtOS4yMiBaIiBzdHlsZT0iZmlsbDpub25lIiAvPjxwYXRoIGQ9Ik0gLTc5LjA1IDE2Ni45MyBoIDkuMjIgdiA0OC41OSBoIC05LjIyIFoiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PGcgZmlsbD0iIzAwMDAwMCIgc3Ryb2tlPSIjMDAwMDAwIiB0cmFuc2Zvcm09Im1hdHJpeCgxLjAgMC4wIDAuMCAxLjAgLTgyLjcgMjY1LjA0KSI+PGcgdHJhbnNmb3JtPSJtYXRyaXgoMSAwIDAgLTEgMCA0My42OTUpIj48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAxIDAgNDUuMzMpIj48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAtMSAwIDApIj48Zm9yZWlnbm9iamVjdCBoZWlnaHQ9IjguNjUiIG92ZXJmbG93PSJ2aXNpYmxlIiB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAtMSAwIDE2LjYpIiB3aWR0aD0iMTYuNTQiPjxtYXRoIGFsdHRleHQ9Inlfe3QtMX0iIGRpc3BsYXk9ImlubGluZSIgaWQ9IlMxLkYxLnNmMi5waWMxLjQuNC40LjQuNC40LjQuNC40LjQuNC40LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xIj48c2VtYW50aWNzIGlkPSJTMS5GMS5zZjIucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMWEiPjxtc3ViIGlkPSJTMS5GMS5zZjIucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xIiB4cmVmPSJTMS5GMS5zZjIucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLmNtbWwiPjxtaSBpZD0iUzEuRjEuc2YyLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4yIiB4cmVmPSJTMS5GMS5zZjIucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIuY21tbCI+eTwvbWk+PG1yb3cgaWQ9IlMxLkYxLnNmMi5waWMxLjQuNC40LjQuNC40LjQuNC40LjQuNC40LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMyIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLmNtbWwiPjxtaSBpZD0iUzEuRjEuc2YyLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjIiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjQuNC40LjQuNC40LjQuNC40LjQuNC40LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4yLmNtbWwiPnQ8L21pPjxtbyBpZD0iUzEuRjEuc2YyLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjEiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjQuNC40LjQuNC40LjQuNC40LjQuNC40LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4xLmNtbWwiPuKIkjwvbW8+PG1uIGlkPSJTMS5GMS5zZjIucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMyIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjMuY21tbCI+MTwvbW4+PC9tcm93PjwvbXN1Yj48YW5ub3RhdGlvbi14bWwgZW5jb2Rpbmc9Ik1hdGhNTC1Db250ZW50IiBpZD0iUzEuRjEuc2YyLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjFiIj48YXBwbHkgaWQ9IlMxLkYxLnNmMi5waWMxLjQuNC40LjQuNC40LjQuNC40LjQuNC40LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuY21tbCIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMSI+PGNzeW1ib2wgY2Q9ImFtYmlndW91cyIgaWQ9IlMxLkYxLnNmMi5waWMxLjQuNC40LjQuNC40LjQuNC40LjQuNC40LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xIj5zdWJzY3JpcHQ8L2NzeW1ib2w+PGNpIGlkPSJTMS5GMS5zZjIucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIuY21tbCIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4yIj7wnZGmPC9jaT48YXBwbHkgaWQ9IlMxLkYxLnNmMi5waWMxLjQuNC40LjQuNC40LjQuNC40LjQuNC40LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMiPjxtaW51cyBpZD0iUzEuRjEuc2YyLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjEuY21tbCIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjEiPjwvbWludXM+PGNpIGlkPSJTMS5GMS5zZjIucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMi5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMiI+8J2RoTwvY2k+PGNuIGlkPSJTMS5GMS5zZjIucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMy5jbW1sIiB0eXBlPSJpbnRlZ2VyIiB4cmVmPSJTMS5GMS5zZjIucGljMS40LjQuNC40LjQuNC40LjQuNC40LjQuNC4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMyI+MTwvY24+PC9hcHBseT48L2FwcGx5PjwvYW5ub3RhdGlvbi14bWw+PGFubm90YXRpb24gZW5jb2Rpbmc9ImFwcGxpY2F0aW9uL3gtdGV4IiBpZD0iUzEuRjEuc2YyLnBpYzEuNC40LjQuNC40LjQuNC40LjQuNC40LjQuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjFjIj55X3t0LTF9PC9hbm5vdGF0aW9uPjwvc2VtYW50aWNzPjwvbWF0aD48L2ZvcmVpZ25vYmplY3Q+PC9nPjwvZz48L2c+PC9nPjxnIGZpbGw9IiMwMDAwMDAiIHN0cm9rZT0iIzAwMDAwMCIgdHJhbnNmb3JtPSJtYXRyaXgoMS4wIDAuMCAwLjAgMS4wIDY1Ljg1IC0yNC4yNCkiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgNDMuOTIpIj48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAxIDAgNDUuMzMpIj48ZyB0cmFuc2Zvcm09Im1hdHJpeCgxIDAgMCAtMSAwIDApIj48Zm9yZWlnbm9iamVjdCBoZWlnaHQ9IjkuMSIgb3ZlcmZsb3c9InZpc2libGUiIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgMTYuNikiIHdpZHRoPSIyMC42MSI+PG1hdGggYWx0dGV4dD0ieF97dCsxfSIgZGlzcGxheT0iaW5saW5lIiBpZD0iUzEuRjEuc2YyLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEiPjxzZW1hbnRpY3MgaWQ9IlMxLkYxLnNmMi5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xYSI+PG1zdWIgaWQ9IlMxLkYxLnNmMi5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuY21tbCI+PG1pIGlkPSJTMS5GMS5zZjIucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMi5jbW1sIj54PC9taT48bXJvdyBpZD0iUzEuRjEuc2YyLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zIiB4cmVmPSJTMS5GMS5zZjIucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuY21tbCI+PG1pIGlkPSJTMS5GMS5zZjIucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMiIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjIuY21tbCI+dDwvbWk+PG1vIGlkPSJTMS5GMS5zZjIucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMSIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjEuY21tbCI+KzwvbW8+PG1uIGlkPSJTMS5GMS5zZjIucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMyIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjMuY21tbCI+MTwvbW4+PC9tcm93PjwvbXN1Yj48YW5ub3RhdGlvbi14bWwgZW5jb2Rpbmc9Ik1hdGhNTC1Db250ZW50IiBpZD0iUzEuRjEuc2YyLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjFiIj48YXBwbHkgaWQ9IlMxLkYxLnNmMi5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuY21tbCIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMSI+PGNzeW1ib2wgY2Q9ImFtYmlndW91cyIgaWQ9IlMxLkYxLnNmMi5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xIj5zdWJzY3JpcHQ8L2NzeW1ib2w+PGNpIGlkPSJTMS5GMS5zZjIucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIuY21tbCIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4yIj7wnZGlPC9jaT48YXBwbHkgaWQ9IlMxLkYxLnNmMi5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMiPjxwbHVzIGlkPSJTMS5GMS5zZjIucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS41LjUuNS41LjUuNS41LjUuNS41LjUuNS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMSI+PC9wbHVzPjxjaSBpZD0iUzEuRjEuc2YyLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjIuY21tbCIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjIiPvCdkaE8L2NpPjxjbiBpZD0iUzEuRjEuc2YyLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjMuY21tbCIgdHlwZT0iaW50ZWdlciIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuNS41LjUuNS41LjUuNS41LjUuNS41LjUuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLjMiPjE8L2NuPjwvYXBwbHk+PC9hcHBseT48L2Fubm90YXRpb24teG1sPjxhbm5vdGF0aW9uIGVuY29kaW5nPSJhcHBsaWNhdGlvbi94LXRleCIgaWQ9IlMxLkYxLnNmMi5waWMxLjUuNS41LjUuNS41LjUuNS41LjUuNS41LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xYyI+eF97dCsxfTwvYW5ub3RhdGlvbj48L3NlbWFudGljcz48L21hdGg+PC9mb3JlaWdub2JqZWN0PjwvZz48L2c+PC9nPjwvZz48cGF0aCBkPSJNIDcxLjU0IDczLjc1IGggOS4yMiB2IDQ4LjU5IGggLTkuMjIgWiIgc3R5bGU9ImZpbGw6bm9uZSIgLz48cGF0aCBkPSJNIDcxLjU0IDE2Ny4yNSBoIDkuMjIgdiA0OC41OSBoIC05LjIyIFoiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PGcgZmlsbD0iIzAwMDAwMCIgc3Ryb2tlPSIjMDAwMDAwIiB0cmFuc2Zvcm09Im1hdHJpeCgxLjAgMC4wIDAuMCAxLjAgNjYuMTcgMjY1LjM2KSI+PGcgdHJhbnNmb3JtPSJtYXRyaXgoMSAwIDAgLTEgMCA0My45MikiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIDEgMCA0NS4zMykiPjxnIHRyYW5zZm9ybT0ibWF0cml4KDEgMCAwIC0xIDAgMCkiPjxmb3JlaWdub2JqZWN0IGhlaWdodD0iOS4xIiBvdmVyZmxvdz0idmlzaWJsZSIgdHJhbnNmb3JtPSJtYXRyaXgoMSAwIDAgLTEgMCAxNi42KSIgd2lkdGg9IjE5Ljk4Ij48bWF0aCBhbHR0ZXh0PSJ5X3t0KzF9IiBkaXNwbGF5PSJpbmxpbmUiIGlkPSJTMS5GMS5zZjIucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMSI+PHNlbWFudGljcyBpZD0iUzEuRjEuc2YyLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjFhIj48bXN1YiBpZD0iUzEuRjEuc2YyLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMSIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS5jbW1sIj48bWkgaWQ9IlMxLkYxLnNmMi5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMiIgeHJlZj0iUzEuRjEuc2YyLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4yLmNtbWwiPnk8L21pPjxtcm93IGlkPSJTMS5GMS5zZjIucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy5jbW1sIj48bWkgaWQ9IlMxLkYxLnNmMi5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4yIiB4cmVmPSJTMS5GMS5zZjIucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMi5jbW1sIj50PC9taT48bW8gaWQ9IlMxLkYxLnNmMi5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4xIiB4cmVmPSJTMS5GMS5zZjIucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMS5jbW1sIj4rPC9tbz48bW4gaWQ9IlMxLkYxLnNmMi5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4zIiB4cmVmPSJTMS5GMS5zZjIucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMy5jbW1sIj4xPC9tbj48L21yb3c+PC9tc3ViPjxhbm5vdGF0aW9uLXhtbCBlbmNvZGluZz0iTWF0aE1MLUNvbnRlbnQiIGlkPSJTMS5GMS5zZjIucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMWIiPjxhcHBseSBpZD0iUzEuRjEuc2YyLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xIj48Y3N5bWJvbCBjZD0iYW1iaWd1b3VzIiBpZD0iUzEuRjEuc2YyLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4xLmNtbWwiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEiPnN1YnNjcmlwdDwvY3N5bWJvbD48Y2kgaWQ9IlMxLkYxLnNmMi5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMi5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjIiPvCdkaY8L2NpPjxhcHBseSBpZD0iUzEuRjEuc2YyLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjEuMS4zLmNtbWwiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMyI+PHBsdXMgaWQ9IlMxLkYxLnNmMi5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4xLmNtbWwiIHhyZWY9IlMxLkYxLnNmMi5waWMxLjYuNi42LjYuNi42LjYuNi42LjYuNi42LjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS5tMS4xLjEuMy4xIj48L3BsdXM+PGNpIGlkPSJTMS5GMS5zZjIucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMi5jbW1sIiB4cmVmPSJTMS5GMS5zZjIucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMiI+8J2RoTwvY2k+PGNuIGlkPSJTMS5GMS5zZjIucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMy5jbW1sIiB0eXBlPSJpbnRlZ2VyIiB4cmVmPSJTMS5GMS5zZjIucGljMS42LjYuNi42LjYuNi42LjYuNi42LjYuNi4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEubTEuMS4xLjMuMyI+MTwvY24+PC9hcHBseT48L2FwcGx5PjwvYW5ub3RhdGlvbi14bWw+PGFubm90YXRpb24gZW5jb2Rpbmc9ImFwcGxpY2F0aW9uL3gtdGV4IiBpZD0iUzEuRjEuc2YyLnBpYzEuNi42LjYuNi42LjYuNi42LjYuNi42LjYuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLjEuMS4xLm0xLjFjIj55X3t0KzF9PC9hbm5vdGF0aW9uPjwvc2VtYW50aWNzPjwvbWF0aD48L2ZvcmVpZ25vYmplY3Q+PC9nPjwvZz48L2c+PC9nPjxnIHN0cm9rZT0iIzAwMDBGRiI+PGcgc3Ryb2tlLXdpZHRoPSIxLjZwdCI+PHBhdGggZD0iTSAtNzQuNDMgMzEuMjkgTCAtNzQuNDMgNjguOTkiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjxnIHN0cm9rZS1kYXNoYXJyYXk9Im5vbmUiIHN0cm9rZS1kYXNob2Zmc2V0PSIwLjBwdCIgc3Ryb2tlLWxpbmVjYXA9InJvdW5kIiBzdHJva2UtbGluZWpvaW49InJvdW5kIiBzdHJva2Utd2lkdGg9IjEuMjhwdCIgdHJhbnNmb3JtPSJtYXRyaXgoMC4wIDEuMCAtMS4wIDAuMCAtNzQuNDMgNjguOTkpIj48cGF0aCBkPSJNIC0zLjE1IDQuMjEgQyAtMi44OSAyLjYzIDAgMC4yNiAwLjc5IDAgQyAwIC0wLjI2IC0yLjg5IC0yLjYzIC0zLjE1IC00LjIxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48L2c+PGcgc3Ryb2tlPSIjMDAwMEZGIj48ZyBzdHJva2Utd2lkdGg9IjEuNnB0Ij48cGF0aCBkPSJNIDAgMTcuNjIgTCAwIDU1LjMyIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48ZyBzdHJva2UtZGFzaGFycmF5PSJub25lIiBzdHJva2UtZGFzaG9mZnNldD0iMC4wcHQiIHN0cm9rZS1saW5lY2FwPSJyb3VuZCIgc3Ryb2tlLWxpbmVqb2luPSJyb3VuZCIgc3Ryb2tlLXdpZHRoPSIxLjI4cHQiIHRyYW5zZm9ybT0ibWF0cml4KDAuMCAxLjAgLTEuMCAwLjAgMCA1NS4zMikiPjxwYXRoIGQ9Ik0gLTMuMTUgNC4yMSBDIC0yLjg5IDIuNjMgMCAwLjI2IDAuNzkgMCBDIDAgLTAuMjYgLTIuODkgLTIuNjMgLTMuMTUgLTQuMjEiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjwvZz48ZyBzdHJva2U9IiMwMDAwRkYiPjxnIHN0cm9rZS13aWR0aD0iMS42cHQiPjxwYXRoIGQ9Ik0gNzYuMTYgMzEuNjEgTCA3Ni4xNiA2OS4zMSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0ibm9uZSIgc3Ryb2tlLWRhc2hvZmZzZXQ9IjAuMHB0IiBzdHJva2UtbGluZWNhcD0icm91bmQiIHN0cm9rZS1saW5lam9pbj0icm91bmQiIHN0cm9rZS13aWR0aD0iMS4yOHB0IiB0cmFuc2Zvcm09Im1hdHJpeCgwLjAgMS4wIC0xLjAgMC4wIDc2LjE2IDY5LjMxKSI+PHBhdGggZD0iTSAtMy4xNSA0LjIxIEMgLTIuODkgMi42MyAwIDAuMjYgMC43OSAwIEMgMCAtMC4yNiAtMi44OSAtMi42MyAtMy4xNSAtNC4yMSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PC9nPjxnIHN0cm9rZT0iIzAwRkYwMCI+PGcgc3Ryb2tlLXdpZHRoPSIxLjZwdCI+PHBhdGggZD0iTSAtNzQuNDMgMTI0Ljc5IEwgLTc0LjQzIDE2Mi40OSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0ibm9uZSIgc3Ryb2tlLWRhc2hvZmZzZXQ9IjAuMHB0IiBzdHJva2UtbGluZWNhcD0icm91bmQiIHN0cm9rZS1saW5lam9pbj0icm91bmQiIHN0cm9rZS13aWR0aD0iMS4yOHB0IiB0cmFuc2Zvcm09Im1hdHJpeCgwLjAgMS4wIC0xLjAgMC4wIC03NC40MyAxNjIuNDkpIj48cGF0aCBkPSJNIC0zLjE1IDQuMjEgQyAtMi44OSAyLjYzIDAgMC4yNiAwLjc5IDAgQyAwIC0wLjI2IC0yLjg5IC0yLjYzIC0zLjE1IC00LjIxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48L2c+PGcgc3Ryb2tlPSIjMDBGRjAwIj48ZyBzdHJva2Utd2lkdGg9IjEuNnB0Ij48cGF0aCBkPSJNIDAgMTExLjEyIEwgMCAxNDguODIiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjxnIHN0cm9rZS1kYXNoYXJyYXk9Im5vbmUiIHN0cm9rZS1kYXNob2Zmc2V0PSIwLjBwdCIgc3Ryb2tlLWxpbmVjYXA9InJvdW5kIiBzdHJva2UtbGluZWpvaW49InJvdW5kIiBzdHJva2Utd2lkdGg9IjEuMjhwdCIgdHJhbnNmb3JtPSJtYXRyaXgoMC4wIDEuMCAtMS4wIDAuMCAwIDE0OC44MikiPjxwYXRoIGQ9Ik0gLTMuMTUgNC4yMSBDIC0yLjg5IDIuNjMgMCAwLjI2IDAuNzkgMCBDIDAgLTAuMjYgLTIuODkgLTIuNjMgLTMuMTUgLTQuMjEiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjwvZz48ZyBzdHJva2U9IiMwMEZGMDAiPjxnIHN0cm9rZS13aWR0aD0iMS42cHQiPjxwYXRoIGQ9Ik0gNzYuMTYgMTI1LjExIEwgNzYuMTYgMTYyLjgxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48ZyBzdHJva2UtZGFzaGFycmF5PSJub25lIiBzdHJva2UtZGFzaG9mZnNldD0iMC4wcHQiIHN0cm9rZS1saW5lY2FwPSJyb3VuZCIgc3Ryb2tlLWxpbmVqb2luPSJyb3VuZCIgc3Ryb2tlLXdpZHRoPSIxLjI4cHQiIHRyYW5zZm9ybT0ibWF0cml4KDAuMCAxLjAgLTEuMCAwLjAgNzYuMTYgMTYyLjgxKSI+PHBhdGggZD0iTSAtMy4xNSA0LjIxIEMgLTIuODkgMi42MyAwIDAuMjYgMC43OSAwIEMgMCAtMC4yNiAtMi44OSAtMi42MyAtMy4xNSAtNC4yMSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PC9nPjxnIHN0cm9rZT0iI0ZGMDAwMCI+PGcgc3Ryb2tlLXdpZHRoPSIxLjZwdCI+PHBhdGggZD0iTSAtNzQuNDMgMjE4LjI5IEwgLTc0LjQzIDI1NS45OCIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0ibm9uZSIgc3Ryb2tlLWRhc2hvZmZzZXQ9IjAuMHB0IiBzdHJva2UtbGluZWNhcD0icm91bmQiIHN0cm9rZS1saW5lam9pbj0icm91bmQiIHN0cm9rZS13aWR0aD0iMS4yOHB0IiB0cmFuc2Zvcm09Im1hdHJpeCgwLjAgMS4wIC0xLjAgMC4wIC03NC40MyAyNTUuOTgpIj48cGF0aCBkPSJNIC0zLjE1IDQuMjEgQyAtMi44OSAyLjYzIDAgMC4yNiAwLjc5IDAgQyAwIC0wLjI2IC0yLjg5IC0yLjYzIC0zLjE1IC00LjIxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48L2c+PGcgc3Ryb2tlPSIjRkYwMDAwIj48ZyBzdHJva2Utd2lkdGg9IjEuNnB0Ij48cGF0aCBkPSJNIDAgMjA0LjYyIEwgMCAyNDIuMzIiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjxnIHN0cm9rZS1kYXNoYXJyYXk9Im5vbmUiIHN0cm9rZS1kYXNob2Zmc2V0PSIwLjBwdCIgc3Ryb2tlLWxpbmVjYXA9InJvdW5kIiBzdHJva2UtbGluZWpvaW49InJvdW5kIiBzdHJva2Utd2lkdGg9IjEuMjhwdCIgdHJhbnNmb3JtPSJtYXRyaXgoMC4wIDEuMCAtMS4wIDAuMCAwIDI0Mi4zMikiPjxwYXRoIGQ9Ik0gLTMuMTUgNC4yMSBDIC0yLjg5IDIuNjMgMCAwLjI2IDAuNzkgMCBDIDAgLTAuMjYgLTIuODkgLTIuNjMgLTMuMTUgLTQuMjEiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjwvZz48ZyBzdHJva2U9IiNGRjAwMDAiPjxnIHN0cm9rZS13aWR0aD0iMS42cHQiPjxwYXRoIGQ9Ik0gNzYuMTYgMjE4LjYxIEwgNzYuMTYgMjU2LjMxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48ZyBzdHJva2UtZGFzaGFycmF5PSJub25lIiBzdHJva2UtZGFzaG9mZnNldD0iMC4wcHQiIHN0cm9rZS1saW5lY2FwPSJyb3VuZCIgc3Ryb2tlLWxpbmVqb2luPSJyb3VuZCIgc3Ryb2tlLXdpZHRoPSIxLjI4cHQiIHRyYW5zZm9ybT0ibWF0cml4KDAuMCAxLjAgLTEuMCAwLjAgNzYuMTYgMjU2LjMxKSI+PHBhdGggZD0iTSAtMy4xNSA0LjIxIEMgLTIuODkgMi42MyAwIDAuMjYgMC43OSAwIEMgMCAtMC4yNiAtMi44OSAtMi42MyAtMy4xNSAtNC4yMSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PC9nPjxnIHN0cm9rZT0iI0ZGODAwMCI+PGcgc3Ryb2tlLXdpZHRoPSIxLjZwdCI+PHBhdGggZD0iTSAtMTIxLjE4IDk3LjczIEwgLTgzLjQ5IDk3LjczIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48ZyBzdHJva2UtZGFzaGFycmF5PSJub25lIiBzdHJva2UtZGFzaG9mZnNldD0iMC4wcHQiIHN0cm9rZS1saW5lY2FwPSJyb3VuZCIgc3Ryb2tlLWxpbmVqb2luPSJyb3VuZCIgc3Ryb2tlLXdpZHRoPSIxLjI4cHQiIHRyYW5zZm9ybT0ibWF0cml4KDEuMCAwLjAgMC4wIDEuMCAtODMuNDkgOTcuNzMpIj48cGF0aCBkPSJNIC0zLjE1IDQuMjEgQyAtMi44OSAyLjYzIDAgMC4yNiAwLjc5IDAgQyAwIC0wLjI2IC0yLjg5IC0yLjYzIC0zLjE1IC00LjIxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48L2c+PGcgc3Ryb2tlPSIjRkY4MDAwIj48ZyBzdHJva2Utd2lkdGg9IjEuNnB0Ij48cGF0aCBkPSJNIC02Ny4wNSA5Ni4zNyBMIC05LjAzIDg1LjcxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48ZyBzdHJva2UtZGFzaGFycmF5PSJub25lIiBzdHJva2UtZGFzaG9mZnNldD0iMC4wcHQiIHN0cm9rZS1saW5lY2FwPSJyb3VuZCIgc3Ryb2tlLWxpbmVqb2luPSJyb3VuZCIgc3Ryb2tlLXdpZHRoPSIxLjI4cHQiIHRyYW5zZm9ybT0ibWF0cml4KDAuOTgzNTUgLTAuMTgwNjMgMC4xODA2MyAwLjk4MzU1IC05LjAzIDg1LjcxKSI+PHBhdGggZD0iTSAtMy4xNSA0LjIxIEMgLTIuODkgMi42MyAwIDAuMjYgMC43OSAwIEMgMCAtMC4yNiAtMi44OSAtMi42MyAtMy4xNSAtNC4yMSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PC9nPjxnIHN0cm9rZT0iI0ZGODAwMCI+PGcgc3Ryb2tlLXdpZHRoPSIxLjZwdCI+PHBhdGggZD0iTSA3LjM4IDg1LjQxIEwgNjcuMTMgOTYuMzkiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjxnIHN0cm9rZS1kYXNoYXJyYXk9Im5vbmUiIHN0cm9rZS1kYXNob2Zmc2V0PSIwLjBwdCIgc3Ryb2tlLWxpbmVjYXA9InJvdW5kIiBzdHJva2UtbGluZWpvaW49InJvdW5kIiBzdHJva2Utd2lkdGg9IjEuMjhwdCIgdHJhbnNmb3JtPSJtYXRyaXgoMC45ODM1NCAwLjE4MDczIC0wLjE4MDczIDAuOTgzNTQgNjcuMTMgOTYuMzkpIj48cGF0aCBkPSJNIC0zLjE1IDQuMjEgQyAtMi44OSAyLjYzIDAgMC4yNiAwLjc5IDAgQyAwIC0wLjI2IC0yLjg5IC0yLjYzIC0zLjE1IC00LjIxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48L2c+PGcgc3Ryb2tlPSIjRkY4MDAwIj48ZyBzdHJva2Utd2lkdGg9IjEuNnB0Ij48cGF0aCBkPSJNIDgzLjUzIDk4LjA1IEwgMTIxLjIzIDk4LjA1IiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48ZyBzdHJva2UtZGFzaGFycmF5PSJub25lIiBzdHJva2UtZGFzaG9mZnNldD0iMC4wcHQiIHN0cm9rZS1saW5lY2FwPSJyb3VuZCIgc3Ryb2tlLWxpbmVqb2luPSJyb3VuZCIgc3Ryb2tlLXdpZHRoPSIxLjI4cHQiIHRyYW5zZm9ybT0ibWF0cml4KDEuMCAwLjAgMC4wIDEuMCAxMjEuMjMgOTguMDUpIj48cGF0aCBkPSJNIC0zLjE1IDQuMjEgQyAtMi44OSAyLjYzIDAgMC4yNiAwLjc5IDAgQyAwIC0wLjI2IC0yLjg5IC0yLjYzIC0zLjE1IC00LjIxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48L2c+PGcgc3Ryb2tlPSIjQkYwMDQwIj48ZyBzdHJva2Utd2lkdGg9IjEuNnB0Ij48cGF0aCBkPSJNIC0xMjEuMTggMTkxLjIyIEwgLTgzLjQ5IDE5MS4yMiIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0ibm9uZSIgc3Ryb2tlLWRhc2hvZmZzZXQ9IjAuMHB0IiBzdHJva2UtbGluZWNhcD0icm91bmQiIHN0cm9rZS1saW5lam9pbj0icm91bmQiIHN0cm9rZS13aWR0aD0iMS4yOHB0IiB0cmFuc2Zvcm09Im1hdHJpeCgxLjAgMC4wIDAuMCAxLjAgLTgzLjQ5IDE5MS4yMikiPjxwYXRoIGQ9Ik0gLTMuMTUgNC4yMSBDIC0yLjg5IDIuNjMgMCAwLjI2IDAuNzkgMCBDIDAgLTAuMjYgLTIuODkgLTIuNjMgLTMuMTUgLTQuMjEiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjwvZz48ZyBzdHJva2U9IiNCRjAwNDAiPjxnIHN0cm9rZS13aWR0aD0iMS42cHQiPjxwYXRoIGQ9Ik0gLTY3LjA1IDE4OS44NyBMIC05LjAzIDE3OS4yMSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0ibm9uZSIgc3Ryb2tlLWRhc2hvZmZzZXQ9IjAuMHB0IiBzdHJva2UtbGluZWNhcD0icm91bmQiIHN0cm9rZS1saW5lam9pbj0icm91bmQiIHN0cm9rZS13aWR0aD0iMS4yOHB0IiB0cmFuc2Zvcm09Im1hdHJpeCgwLjk4MzU1IC0wLjE4MDYzIDAuMTgwNjMgMC45ODM1NSAtOS4wMyAxNzkuMjEpIj48cGF0aCBkPSJNIC0zLjE1IDQuMjEgQyAtMi44OSAyLjYzIDAgMC4yNiAwLjc5IDAgQyAwIC0wLjI2IC0yLjg5IC0yLjYzIC0zLjE1IC00LjIxIiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48L2c+PGcgc3Ryb2tlPSIjQkYwMDQwIj48ZyBzdHJva2Utd2lkdGg9IjEuNnB0Ij48cGF0aCBkPSJNIDcuMzggMTc4LjkxIEwgNjcuMTMgMTg5Ljg5IiBzdHlsZT0iZmlsbDpub25lIiAvPjwvZz48ZyBzdHJva2UtZGFzaGFycmF5PSJub25lIiBzdHJva2UtZGFzaG9mZnNldD0iMC4wcHQiIHN0cm9rZS1saW5lY2FwPSJyb3VuZCIgc3Ryb2tlLWxpbmVqb2luPSJyb3VuZCIgc3Ryb2tlLXdpZHRoPSIxLjI4cHQiIHRyYW5zZm9ybT0ibWF0cml4KDAuOTgzNTQgMC4xODA3MyAtMC4xODA3MyAwLjk4MzU0IDY3LjEzIDE4OS44OSkiPjxwYXRoIGQ9Ik0gLTMuMTUgNC4yMSBDIC0yLjg5IDIuNjMgMCAwLjI2IDAuNzkgMCBDIDAgLTAuMjYgLTIuODkgLTIuNjMgLTMuMTUgLTQuMjEiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjwvZz48ZyBzdHJva2U9IiNCRjAwNDAiPjxnIHN0cm9rZS13aWR0aD0iMS42cHQiPjxwYXRoIGQ9Ik0gODMuNTMgMTkxLjU1IEwgMTIxLjIzIDE5MS41NSIgc3R5bGU9ImZpbGw6bm9uZSIgLz48L2c+PGcgc3Ryb2tlLWRhc2hhcnJheT0ibm9uZSIgc3Ryb2tlLWRhc2hvZmZzZXQ9IjAuMHB0IiBzdHJva2UtbGluZWNhcD0icm91bmQiIHN0cm9rZS1saW5lam9pbj0icm91bmQiIHN0cm9rZS13aWR0aD0iMS4yOHB0IiB0cmFuc2Zvcm09Im1hdHJpeCgxLjAgMC4wIDAuMCAxLjAgMTIxLjIzIDE5MS41NSkiPjxwYXRoIGQ9Ik0gLTMuMTUgNC4yMSBDIC0yLjg5IDIuNjMgMCAwLjI2IDAuNzkgMCBDIDAgLTAuMjYgLTIuODkgLTIuNjMgLTMuMTUgLTQuMjEiIHN0eWxlPSJmaWxsOm5vbmUiIC8+PC9nPjwvZz48L2c+PC9zdmc+]]

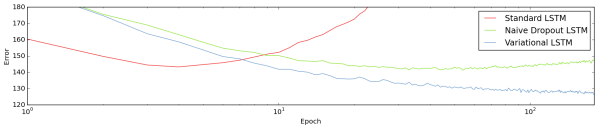

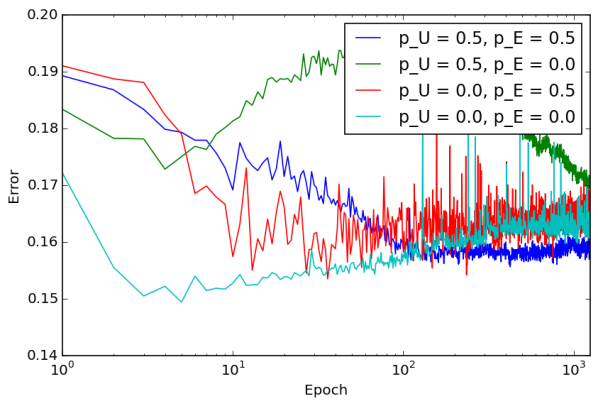

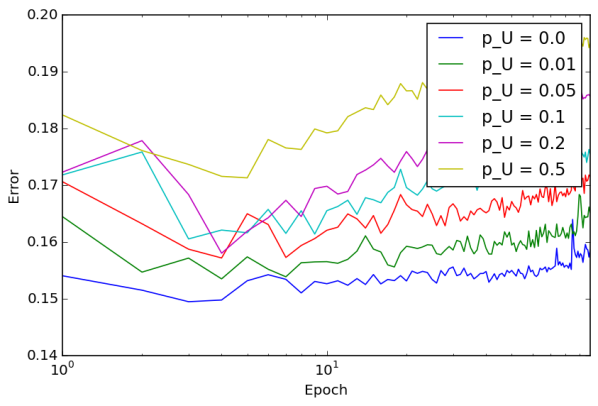

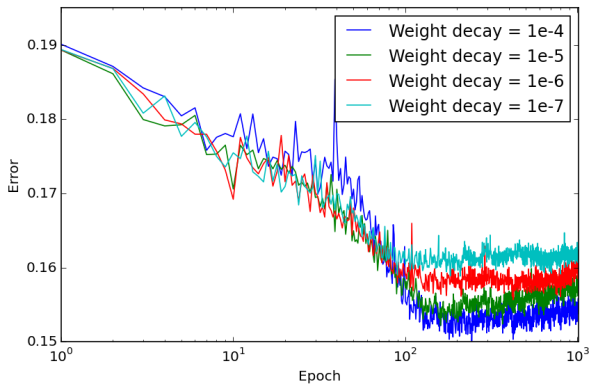

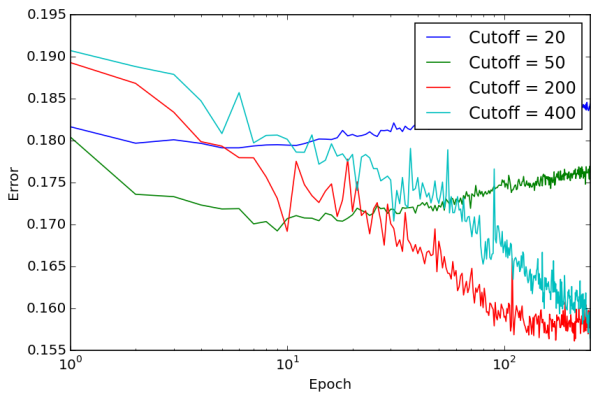

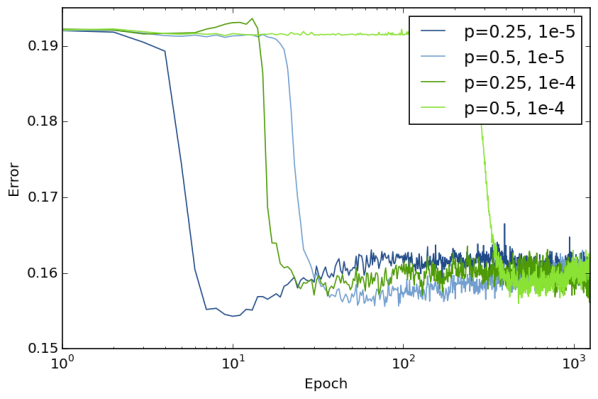

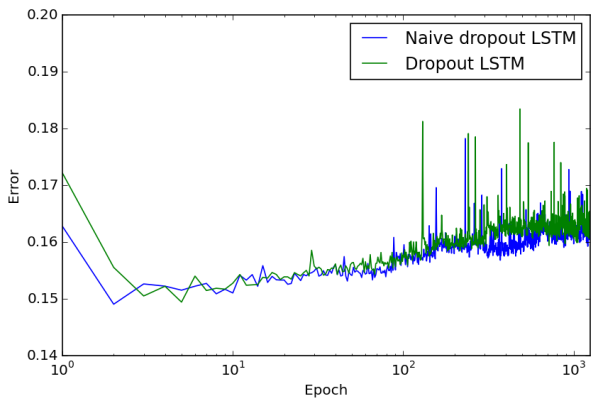

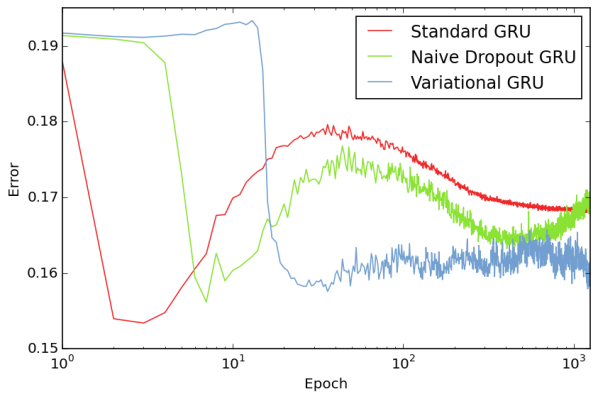

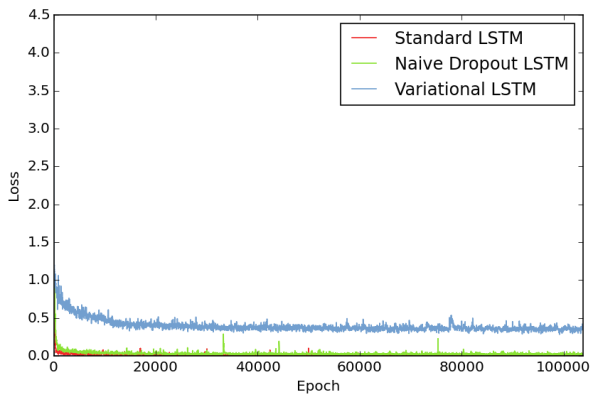

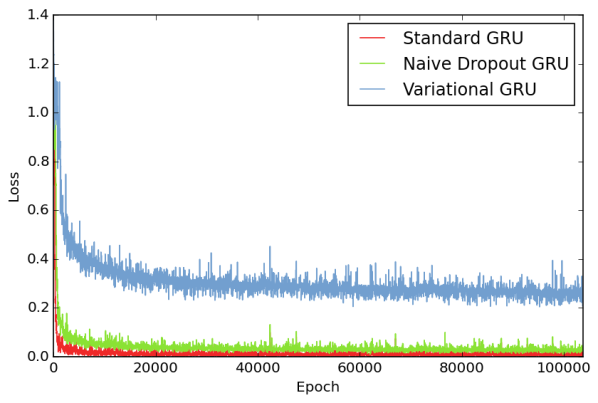

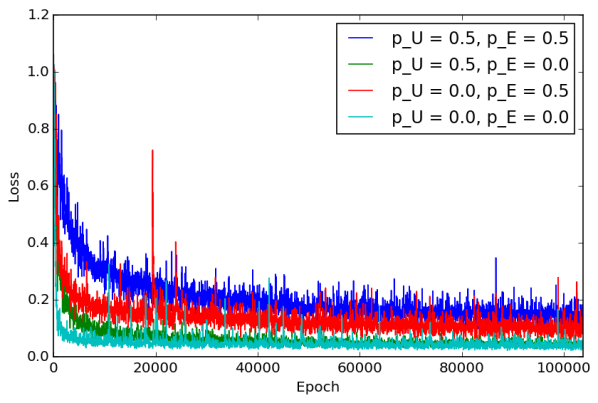

En la nueva variante del dropout, repetimos la misma máscara de dropout en cada paso temporal tanto para las entradas, las salidas como las capas recurrentes (eliminamos las mismas unidades de la red en cada paso temporal). Esto contrasta con las técnicas ad hoc existentes, en las que se muestrean máscaras de dropout distintas en cada paso temporal solo para las entradas y las salidas (no se aplica dropout a las conexiones recurrentes, ya que el uso de máscaras distintas en estas conexiones degrada el rendimiento). Nuestro método y su relación con las técnicas existentes se ilustran en la figura 1. Cuando se utiliza con entradas discretas (es decir, palabras), también colocamos una distribución sobre los embeddings de palabras. El dropout en el modelo basado en palabras se traduce entonces en eliminar al azar tipos de palabras en la oración, y puede interpretarse como una forma de obligar al modelo a no depender de palabras individuales para su tarea.

A continuación, repasamos la literatura relacionada y el material de referencia, y luego formalizamos nuestra inferencia aproximada para el Variational RNN, que da lugar a la variante del dropout propuesta arriba. Los resultados experimentales se presentan más adelante.

2 Trabajo relacionado

En los últimos años se ha acumulado una cantidad considerable de trabajos que demuestran los efectos negativos de una aplicación ingenua del dropout en las conexiones recurrentes de las RNN. Pachitariu y Sahani [7], trabajando con modelos de lenguaje, argumentan que el ruido añadido en las conexiones recurrentes de una RNN provoca inestabilidades del modelo y, en su lugar, añaden ruido únicamente a la parte de decodificación. Bayer et al. [8] aplican una aproximación determinista del dropout (fast dropout) en RNN. Argumentan que con dropout la dinámica de la RNN cambia drásticamente y que el dropout debería aplicarse a las partes no dinámicas del modelo: las conexiones que van de la capa oculta a la capa de salida. Pham et al. [9] evalúan el dropout en tareas de reconocimiento de escritura manuscrita. Concluyen que el dropout en las capas recurrentes perturba la capacidad de la RNN para modelar secuencias y que el dropout debería aplicarse solo a las conexiones feed-forward y no a las recurrentes. El trabajo de Zaremba, Sutskever y Vinyals [4] se desarrolló en paralelo al de Pham et al. [9]. Zaremba et al. [4] evalúan el rendimiento del dropout en RNN en una amplia variedad de tareas. Demuestran que aplicar dropout solo a las conexiones no recurrentes mejora el rendimiento, y proporcionan resultados en modelado de lenguaje en Penn Treebank que constituyen el estado del arte (aún no superado). Argumentan que sin dropout solo se utilizaban modelos pequeños para evitar el sobreajuste, mientras que con dropout pueden usarse modelos más grandes, lo que conduce a mejores resultados. Este trabajo se considera la implementación de referencia para muchos (y lo usamos como base de comparación más adelante). Bluche et al. [10] amplían este cuerpo de trabajo y realizan un análisis exploratorio del rendimiento del dropout antes, dentro y después de la unidad de la RNN. Sus resultados son mixtos y no muestran mejoras significativas frente a las técnicas existentes. Más recientemente, y en paralelo a este trabajo, Moon et al. [20] propusieron una nueva variante de dropout en RNN dentro de la comunidad de reconocimiento de voz. Eliminan al azar elementos de la celda interna de la LSTM $ {\textstyle \mathbf{c}_{t}} $ y utilizan la misma máscara en cada paso temporal. Esta es la propuesta más cercana a la nuestra (aunque fundamentalmente distinta del enfoque que sugerimos, explicado en §4.1), y la comparamos con esta variante también más adelante.

Los enfoques existentes se basan en una experimentación empírica con distintas variantes del dropout, siguiendo un proceso de prueba y error. Estos enfoques han llevado a muchos a creer que el dropout no puede extenderse a un gran número de parámetros dentro de las capas recurrentes, dejándolos sin regularización. En contraste con estas conclusiones, demostramos que es posible derivar una variante del dropout basada en inferencia variacional que regulariza con éxito tales parámetros, fundamentando nuestro enfoque en investigación teórica reciente.

3 Antecedentes

Repasamos los antecedentes necesarios sobre redes neuronales bayesianas e inferencia variacional aproximada. Sobre la base de estas ideas, en la siguiente sección proponemos inferencia aproximada en la RNN probabilística, lo que conducirá a una nueva variante del dropout.

3.1 Redes neuronales bayesianas

Dadas las entradas de entrenamiento $ {\textstyle \mathbf{X} = {\{\mathbf{x}_{1},\ldots,\mathbf{x}_{N}\}}} $ y sus correspondientes salidas $ {\textstyle \mathbf{Y} = {\{\mathbf{y}_{1},\ldots,\mathbf{y}_{N}\}}} $, en la regresión bayesiana (paramétrica) queremos inferir los parámetros $ {\textstyle \mathbf{ω}} $ de una función $ {\textstyle \mathbf{y} = {\mathbf{f}^{\mathbf{ω}}\hspace{0pt}{(\mathbf{x})}}} $ que probablemente hayan generado nuestras salidas. ¿Qué parámetros son los más probables de haber generado nuestros datos? Siguiendo el enfoque bayesiano, colocaríamos algún prior sobre el espacio de parámetros, $ {\textstyle p\hspace{0pt}{({\mathbf{ω}})}} $. Esta distribución representa nuestra creencia a priori sobre qué parámetros han podido generar nuestros datos. También necesitamos definir una distribución de verosimilitud $ {\textstyle p\hspace{0pt}{(\left. \mathbf{y} \middle| {\mathbf{x},{\mathbf{ω}}} \right.)}} $. Para tareas de clasificación podemos suponer una verosimilitud softmax,

| $ {\textstyle {p\hspace{0pt}\left( {y = \left. d \middle| {\mathbf{x},{\mathbf{ω}}} \right.} \right)} = {\text{Categorical}\hspace{0pt}\left( {{\exp{({f_{d}^{\mathbf{ω}}\hspace{0pt}{(\mathbf{x})}})}}/{\sum\limits_{d^{\prime}}{\exp{({f_{d^{\prime}}^{\mathbf{ω}}\hspace{0pt}{(\mathbf{x})}})}}}} \right)}} $ |

o una verosimilitud gaussiana para regresión. Dado un conjunto de datos $ {\textstyle \mathbf{X},\mathbf{Y}} $, buscamos entonces la distribución posterior sobre el espacio de parámetros: $ {\textstyle p\hspace{0pt}{(\left. {\mathbf{ω}} \middle| {\mathbf{X},\mathbf{Y}} \right.)}} $. Esta distribución captura cuán probables son los distintos parámetros de la función dados los datos observados. Con ella podemos predecir una salida para un nuevo punto de entrada $ {\textstyle \mathbf{x}^{\ast}} $ integrando

| $ {\textstyle {{p\hspace{0pt}{(\left. \mathbf{y}^{\ast} \middle| {\mathbf{x}^{\ast},\mathbf{X},\mathbf{Y}} \right.)}} = {\int{p\hspace{0pt}{(\left. \mathbf{y}^{\ast} \middle| {\mathbf{x}^{\ast},{\mathbf{ω}}} \right.)}\hspace{0pt}p\hspace{0pt}{(\left. {\mathbf{ω}} \middle| {\mathbf{X},\mathbf{Y}} \right.)}\hspace{0pt}{\text{d}{\mathbf{ω}}}}}}.} $ | (1) |

Una forma de definir una distribución sobre un conjunto paramétrico de funciones es colocar una distribución a priori sobre los pesos de una red neuronal, dando lugar a una NN bayesiana [21, 22]. Dadas las matrices de pesos $ {\textstyle \mathbf{W}_{i}} $ y los vectores de sesgo $ {\textstyle \mathbf{b}_{i}} $ para la capa $ {\textstyle i} $, solemos colocar distribuciones gaussianas matriciales estándar como prior sobre las matrices de pesos, $ {\textstyle {p\hspace{0pt}{(\mathbf{W}_{i})}} = {\mathcal{N}\hspace{0pt}{(\mathbf{0},\mathbf{I})}}} $ y, por simplicidad, asumimos una estimación puntual para los vectores de sesgo.

3.2 Inferencia variacional aproximada en redes neuronales bayesianas

Nos interesa encontrar la distribución de las matrices de pesos (que parametrizan nuestras funciones) que han generado nuestros datos. Este es el posterior sobre los pesos dadas nuestras observaciones $ {\textstyle \mathbf{X},\mathbf{Y}} $: $ {\textstyle p\hspace{0pt}{(\left. {\mathbf{ω}} \middle| {\mathbf{X},\mathbf{Y}} \right.)}} $. Este posterior no es tratable en general y podemos usar inferencia variacional para aproximarlo (como se hizo en [23, 24, 25, 12]). Necesitamos definir una distribución variacional aproximante $ {\textstyle q\hspace{0pt}{({\mathbf{ω}})}} $ y minimizar la divergencia KL entre la distribución aproximante y el posterior completo:

| $ {\textstyle \text{KL}\left( q{({\mathbf{ω}})}||p{({\mathbf{ω}}|\mathbf{X},\mathbf{Y})} \right)} $ | $ {\textstyle \propto - \int q{({\mathbf{ω}})}\log p{(\mathbf{Y}|\mathbf{X},{\mathbf{ω}})}{\text{d}{\mathbf{ω}}} + \text{KL}{(q{({\mathbf{ω}})}||p{({\mathbf{ω}})})}} $ | |||

| $ {\textstyle = - \sum\limits_{i = 1}^{N}\int q{({\mathbf{ω}})}\log p{(\mathbf{y}_{i}|\mathbf{f}^{\mathbf{ω}}{(\mathbf{x}_{i})})}{\text{d}{\mathbf{ω}}} + \text{KL}{(q{({\mathbf{ω}})}||p{({\mathbf{ω}})})}.} $ | (2) |